ANALISIS PERBANDINGAN

NEURAL NETWORK BACKPROPAGATION

DENGAN

SIMPLE PERCEPTRON

DALAM MENGENALI

IMAGE

DAUN

TESIS

Oleh

OMMI ALFINA

097038016/TINF

PROGRAM STUDI MAGISTER (S2) TEKNIK INFORMATIKA

FAKULTAS MATEMATIKA DAN ILMU PENEGETAHUAN ALAM

UNIVERSITAS SUMATERA UTARA

M E D A N

ANALISIS PERBANDINGAN

NEURAL NETWORK BACKPROPAGATION

DENGAN

SIMPLE PERCEPTRON

DALAM MENGENALI

IMAGE

DAUN

TESIS

Diajukan sebagai salah satu syarat untuk memperoleh gelar

Magister Komputer dalam Program Studi Magister

Teknik Informatika Program Pascasarjana

Fakultas MIPA Universitas Sumatera Utara

Oleh

OMMI ALFINA

097038016/TINF

PROGRAM STUDI MAGISTER (S2) TEKNIK INFORMATIKA

FAKULTAS MATEMATIKA DAN ILMU PENEGETAHUAN ALAM

UNIVERSITAS SUMATERA UTARA

M E D A N

PENGESAHAN TESIS

Judul Tesis : ANALISIS PERBANDINGAN NEURAL NETWORK

BACKPROPAGATION DENGAN SIMPLE PERCEPTRON

DALAM MENGENALI IMAGE DAUN

Nama Mahasiswa : Ommi Alfina

Nomor Induk Mahasiswa : 097038016

Program studi : Magister (S2) Teknik Informatika

Fakultas : Matematika dan Ilmu Pengetahuan Alam

Universitas Sumatera Utara

Menyetujui Komisi Pembimbing

M. Andri Budiman,ST, M.Comp.Sc,MEM

Anggota

Ketua

Prof. Dr. Opim Salim Sitompul

Ketua Program Studi,

Dekan FMIPA USU,

Prof. Dr. Muhammad Zarlis

NIP. 195707011986011003

NIP. 196310261991031001

PERNYATAAN ORISINALITAS

ANALISIS PERBANDINGAN

NEURAL NETWORK BACKPROPAGATION

DENGAN

SIMPLE PERCEPTRON

DALAM MENGENALI

IMAGE

DAUN

T E S I S

Dengan ini saya nyatakan bahwa saya mengakui semua karya tesis ini adalah hasil kerja saya sendiri kecuali kutipan dan ringkasan yang tiap bagiannya telah dijelaskan sumbernya dengan benar.

Medan, 10 Januari 2012

PERNYATAAN PERSETUJUAN PUBLIKASI

KARYA ILMIAH UNTUK KEPENTINGAN

AKADEMIS

Sebagai sivitas akademika Universitas Sumatera Utara, saya yang telah bertandatangan dibawah ini :

Nama : Ommi Alfina

NIM : 097038016

Program Studi : Magister Teknik Informatika Jenis Karya Ilmiah : Tesis

Demi pengembangan ilmu pengetahuan, menyetujui untuk memberikan kepada Universitas Sumatera Utara Hak Bebas Royalti Non-Ekslusif (Non-Exclusive Royalty Free Right) atas tesis saya yang berjudul :

Analisis Perbandingan Neural Network Backpropagation dengan Simple Perceptron dalam Mengenali Image Daun

Beserta perangkat yang ada (jika diperlukan). Dengan Hak Bebas Royalti Non-Ekslusif ini, Universitas Sumatera Utara berhak menyimpan, mengalih media, memformat, mengelola dalam bentuk data-base, merawat dan mempublikasikan Tesis saya tanpa meminta izin dari saya selama tetap mencantumkan nama saya sebagai penulis dan sebagai pemegang dan atau sebagai pemilik hak cipta.

Demikian pernyataan ini dibuat dengan sebenarnya.

Medan, Januari 2012

Telah diuji pada

Tanggal : 15 Januari 2012

PANITIA PENGUJI TESIS

Ketua : Prof. Dr. Opim Sitompul

Anggota : 1. M. Andri Budiman,ST,M.Comp.Sc, MEM

RIWAYAT HIDUP

DATA PRIBADI

Nama Lengkap Berikut Gelar : Ommi Alfina, S.Kom Tempat dan Tanggal Lahir : Medan, 26 Juni 1983

Alamat Rumah : Jl. Kl Yos Sudarso Km 13,8 No 71 Medan

Telepon/Faks/HP : 085358775458

Instansi Tempat Bekerja : STMIK POTENSI UTAMA Alamat Kantor : Jl. KL. Yos Sudarso

Telepon/Faks/HP : 061-6854659

DATA PENDIDIKAN

SD : Alwasliyah No.29, Medan Tamat : 1995

SMP : Harapan I, Medan Tamat : 1998

SMA : SMA Negeri 3, Medan Tamat : 2001

Diploma-1 : STMIK Potensi Utama, Medan Tamat : 2002

KATA PENGANTAR

Bismillahirrahmanirrahim. Alhamdulillah, Puji dan syukur penulis panjatkan kehadirat Allah SWT, yang telah melimpahkan rahmat dan hidayahNya, sehingga Tesis ini dapat diselesaikan tepat pada waktunya. Dengan selesainya tesis ini, perkernankanlah penulis mengucapkan terimakasih yang sebesar-besarnya kepada:

Rektor Universitas Sumatera Utara, Bapak Prof. Dr. dr. Syahril Pasaribu, DTM&H, M.Sc (CTM), Sp. A(K) atas kesempatan yang diberikan kepada penyusun mengikuti dan menyelesaikan pendidikan Program Magister.

Dekan Fakultas MIPA Universitas Sumatera Utara, Bapak Dr. Sutarman, M.Sc atas kesempatan menjadi mahasiswa Program Magister pada Program Pascasarjana FMIPA Universitas Sumatera Utara.

Ketua Program Studi Magister Teknik Informatika, Bapak Prof. Dr. Muhammad Zarlis. Sekretaris Program Studi Magister Teknik Informatika, Bapak M. Andri Budiman, ST, M.Comp. Sc, MEM. beserta seluruh Staf Pengajar Program Studi Magister Teknik Informatika Program Pascasarjana Fakultas MIPA Universitas Sumatera Utara.

Terimakasih yang tak terhingga dan penghargaan setinggi-tingginya atas bimbingan, pengarahan dan dorongan yang telah diberikan selama penyusunan tesis ini kepada Bapak Prof. Dr. Opim Sitompul selaku Promotor/Pembimbing Utama, demikian juga kepada Bapak M. Andri Budiman, ST, M.Comp. Sc, MEM selaku Co. Promotor/Pembimbing yang dengan penuh kesabaran menuntun dan membimbing penulis hingga selesainya tesis ini dengan baik.

Terimakasih yang tak terhingga dan penghargaan setinggi-tingginya penulis ucapkan kepada Bapak Prof. Dr. Muhammad Zarlis, Bapak Dr. Zakarias Situmorang, dan Bapak Syahril Efendi, S.Si, MIT sebagai pembanding yang telah memberikan saran dan masukan serta arahan yang baik demi penyelesaian tesis ini.

Suami tercinta Ferdinand Aroen, ST dan buah hati kami tersayang Kiran Syahira Aroen atas segala dorongan semangat, doa dan bantuan serta pengorbanan yang telah diberikan kepada penulis selama ini.

Rekan mahasiswa/I angkatan pertama (2011) pada Program Pascasarjana Fakultas FMIPA Universitas Sumatera, Yudhi, Tesa, Rosita, dan Nurdin serta para Dosen yang telah banyak membantu penulis selama mengikuti perkuliahan.

Dan seluruh pihak yang tidak dapat penulis sebutkan satu persatu dalam tesis ini, terimakasih atas segala bantuan dan doa yang telah diberikan.

Dengan penuh kesadaran dan rendah hati, penulis menyadari bahwa penelitian ini masih jauh dari kesempurnaan, hal ini karena keterbatasan kemampuan dan pengetahuan penulis. Harapan penulis semoga penelitian ini bermanfaat bagi penulis khususnya dan pembaca pada umumnya. Sekali lagi penulis mengucapkan terimakasih. Semoga kiranya Tuhan membalas segala bantuan dan kebaikan yang telah kalian berikan.

Medan, 15 Januari 2012 Penulis,

ANALISIS PERBANDINGAN NEURAL NETWORK BACKPROPAGATION

DENGAN SIMPLE PERCEPTRON DALAM MENGENALI

IMAGE DAUN

ABSTRAK

Dewasa ini jaringan saraf tiruan (JST) sebagai salah satu sistem pengolah informasi yang

memiliki karakteristik kinerja menyerupai jaringan saraf biologis berkembang sangat pesat. Salah satu penerapan jaringan saraf tiruan ini adalah di bidang biologi yaitu dalam pengenalan jenis tanaman. Untuk mengenalkan jenis tanaman tersebut, ada yang melihat dari segi bunga ada pula dari daunnya. Pada riset ini peneliti akan melakukan pelatihan dan pengenalan terhadap daun, dengan menerapkan metode jaringan saraf tiruan

yaitu backpropagation dan simple perceptron. Berdasarkan permasalahan tersebut, maka diperlukan suatu aplikasi pengenalan daun dengan gambar daun sebagai input data dan

feature extraction untuk memroses gambar tersebut. Penelitian ini dimaksudkan untuk membandingkan tingkat akurasi kedua metode tersebut dalam pengenalan image daun. Dari pengujian pada beberapa daun jarak dan bukan jarak, hasil pengenalan pada daun untuk metode perceptron dan backpropagation adalah sama. Tetapi dari tingkat kecepatan untuk pelatihan, pada learning rate(α) = 0.2, 0.5 dan 1, metode perceptron lebih cepat dibandingkan metode backpropagation.

Kata kunci:

COMPARATIVE ANALYSIS OF BACKPROPAGATION NEURAL NETWORK WITH SIMPLE PERCEPTRON TO IDENTIFY

IMAGE LEAVES

ABSTRACT

As one of the information processing systems, artificial neural networks (ANN) which resembles biological neural networks has grown rapidly. One application of artificial neural networks is in the field of biology which to categorize plant species. In order to determine the species of a plant, one usually looks at its flowers or its leaves. In this research, two artificial neural networks (ANN) methods which are backpropagation and simple perceptron are applied separately in order to evaluate whether a single leaf. A recognition with leaf images as input data is built. Then, the application will do feature extraction whose result will be trained further with both backpropagation and simple perceptron. This study aimed to compare the accuracy of both methods is the introduction of the leaf image. From testing to the

some “jarak” and not “jarak” leaves, the result of recognition on the leaves for the perceptron and the backpropagation method is the same. But the rate of speed for training, the learning rate (α)= 0.2, 0.5 and 1, the perceptron method is faster than the backpropagation method.

Key words:

DAFTAR ISI

... Halaman

KATA PENGANTAR ... i

ABSTRAK ... iii

ABSTRACT ... iv

DAFTAR ISI ... v

DAFTAR TABEL ... vii

DAFTAR GAMBAR ... viii

BAB I PENDAHULUAN I.1 Latar Belakang ... 1

I.2 Perumusan Masalah ... 3

I.3 Tujuan Penelitian ... 3

I.4 Manfaat Penelitian ... 3

I.5 Batasan Masalah ... 4

BAB II TINJAUAN PUSTAKA 2.1 Jaringan Saraf Tiruan (JST) ... 5

2.2 Karakteristik JST ... 6

2.3 Pemrosesan Informasi dalam JST ... 7

2.4 Arsitektur Jaringan ... 8

2.5 Pembelajaran/Training dan Testing ... 9

2.6 Metode Pengenalan Pola dengan JST ... 10

2.7 Learning Rate (α) ... 11

2.8 Jaringan Saraf Tiruan Perceptron ... 11

2.9 Jaringan Saraf Tiruan Backpropagation ... 14

2.10 Digital Image Processing ... 18

2.10 Riset-Riset Terkait ... 20

BAB IIIMETODOLOGI PENELITIAN 3.1 Analisis Sistem metode perceptron dan backpropagation ... 22

3.2 Arsitektur Jaringan Metode Perceptron dan Backpropagation ... 23

3.5 Flowchart Recognition Perceptron dan Backpropagation ... 33

3.6 Perencanaan User Interface ... 35

BAB IVANALISIS DAN PEMBAHASAN 4.1 Inisialisasi untuk Metode Perceptron dan Backpropagation ... 38

4.2 Pelatihan (Training) Perceptron pada daun ... 45

4.3 Pelatihan (Training) Backpropagation pada daun ... 50

4.4 Hasil Evaluasi ... 63

4.5 Pengenalan Perceptron dan Backpropagation pada daun ... 67

4.6 Uji Coba Data yang Dilatihkan ... 67

BAB VANALISIS DAN PEMBAHASAN 5.1 Kesimpulan ... 69

5.2 Saran ... 70

DAFTAR TABEL

Nomor Judul Halaman

4.1 Hasil input dari daun 42

4.2 Hasil target menggunakan operasi OR dari input 44 4.3 Hasil pembelajaran perceptron sampai Epoh ke-2 48 4.4 Hasil pembelajaran backpropagation sampai Epoh ke-41 57 4.5 Tabel hasil training perceptron dengan learning rate (α)= 0.2 64 4.6 Tabel hasil training Backpropagation dengan learning rate (α)= 0.2 64 4.7 Tabel hasil training perceptron dengan learning rate (α)= 0.5 65 4.8 Tabel hasil training Backpropagation dengan learning rate (α)= 0.5 65 4.9 Tabel hasil training Backpropagation dengan learning rate (α)= 1 66 4.10 Tabel hasil training Backpropagation dengan learning rate (α)= 1 66 4.11 Tabel hasil recognition daun training perceptron dan backpropagation 67 4.12 Tabel hasil recognition daun non-training perceptron dan

DAFTAR GAMBAR

Nomor Judul Halaman

2.1 JST dengan n input dan satu elemen pemroses 7 2.2 JST dengan n input dan j elemen pemroses 7

2.3 Arsitektur jaringan lapisan tunggal 8

2.4 Arsitektur jaringan banyak lapisan 8

2.5 Arsitektur Jaringan Perceptron 2.6

11 Arsitektur Jaringan Backpropagation

2.7 Boundary Enhancement 20

14

3.1 Arsitektur jaringan metode perceptron 23

3.2 Arsitektur jaringan metode backpropagation 24 3.3 Flowchart garis besar sistem

3.4

25

Flowchart untuk proses gambar 26

3.5 Flowchart untuk proses grayscale 27

3.6 Flowchart proses mengubah gambar menjadi binary image 28

3.7 Flowchart proses Boundary Enhancement 29

3.8 Flowchart pelatihan daun (training) perceptron 30 3.9 Flowchart pelatihan daun (training) backpropagation 32 3.10 Flowchart untuk pengenalan daun (recognition) perceptron 33

3.12

3.11 Flowchart untuk pengenalan daun (recognition) backpropagation 34

Rencana Interface Form Menu 35

3.13 Rencana Interface Form Pelatihan (Training) 36 3.14 Rencana Interface Form Pengenalan (Recognition) 37

4.1 Tampilan Menu Utama 38

4.2 Tampilan Sub Menu Pilihan 39

4.3 Tampilan form training perceptron 39

4.4 Tampilan daun matriks 100 x 100 40

4.5 Tampilan penyederhanaa daun matriks 100 x 100 41

4.6 Tampilan daun matriks 10 x 10 41

4.8 Tampilan form training Backpropagation 51 4.9 Grafik penurunan Mean Square Error sampai epoh ke-41 62

4.10 Daun yang akan dilatih (training) 63

4.11 Daun yang tidak dilatih (non training) 63

ANALISIS PERBANDINGAN NEURAL NETWORK BACKPROPAGATION

DENGAN SIMPLE PERCEPTRON DALAM MENGENALI

IMAGE DAUN

ABSTRAK

Dewasa ini jaringan saraf tiruan (JST) sebagai salah satu sistem pengolah informasi yang

memiliki karakteristik kinerja menyerupai jaringan saraf biologis berkembang sangat pesat. Salah satu penerapan jaringan saraf tiruan ini adalah di bidang biologi yaitu dalam pengenalan jenis tanaman. Untuk mengenalkan jenis tanaman tersebut, ada yang melihat dari segi bunga ada pula dari daunnya. Pada riset ini peneliti akan melakukan pelatihan dan pengenalan terhadap daun, dengan menerapkan metode jaringan saraf tiruan

yaitu backpropagation dan simple perceptron. Berdasarkan permasalahan tersebut, maka diperlukan suatu aplikasi pengenalan daun dengan gambar daun sebagai input data dan

feature extraction untuk memroses gambar tersebut. Penelitian ini dimaksudkan untuk membandingkan tingkat akurasi kedua metode tersebut dalam pengenalan image daun. Dari pengujian pada beberapa daun jarak dan bukan jarak, hasil pengenalan pada daun untuk metode perceptron dan backpropagation adalah sama. Tetapi dari tingkat kecepatan untuk pelatihan, pada learning rate(α) = 0.2, 0.5 dan 1, metode perceptron lebih cepat dibandingkan metode backpropagation.

Kata kunci:

COMPARATIVE ANALYSIS OF BACKPROPAGATION NEURAL NETWORK WITH SIMPLE PERCEPTRON TO IDENTIFY

IMAGE LEAVES

ABSTRACT

As one of the information processing systems, artificial neural networks (ANN) which resembles biological neural networks has grown rapidly. One application of artificial neural networks is in the field of biology which to categorize plant species. In order to determine the species of a plant, one usually looks at its flowers or its leaves. In this research, two artificial neural networks (ANN) methods which are backpropagation and simple perceptron are applied separately in order to evaluate whether a single leaf. A recognition with leaf images as input data is built. Then, the application will do feature extraction whose result will be trained further with both backpropagation and simple perceptron. This study aimed to compare the accuracy of both methods is the introduction of the leaf image. From testing to the

some “jarak” and not “jarak” leaves, the result of recognition on the leaves for the perceptron and the backpropagation method is the same. But the rate of speed for training, the learning rate (α)= 0.2, 0.5 and 1, the perceptron method is faster than the backpropagation method.

Key words:

BAB 1

PENDAHULUAN

1.1. LATAR BELAKANG MASALAH

Dewasa ini jaringan saraf tiruan (JST) sebagai salah satu sistem pengolah informasi yang memiliki karakteristik kinerja menyerupai jaringan saraf biologis berkembang sangat pesat. Perkembangan ini seiring dengan munculnya berbagai masalah yang tidak dapat diselesaikan dengan efisien oleh proses komputasi konvensional, karena algoritma yang ada tidak dapat diformulasikan secara eksplisit dan membutuhkan informasi dalam jumlah yang besar. Jaringan saraf tiruan, selama ini banyak diterapkan dalam menyelesaikan permasalahan-permasalahan tentang pengenalan pola (pattern recognition), signal processing dan peramalan, menurut Purnomo (2001). .

nilai bobot-bobotnya dalam dua arah yaitu arah mundur (backward) dan perambatan maju (forward propagation), ini memungkinkan pembentukan jaringan lebih baik dari metode yang lain. Terlebih setelah berhasil ditemukannya berbagai aplikasi yang dapat diselesaikan dengan menggunakan jaringan saraf tiruan backpropagation (Shihab, 2006). Misalnya, Sholahuddin (2002), Wahab (2004), Khan & Sharma (2008), Handayani (2008), Yulianto (2010), Tahmasebi & Hezarkhani (2010).

Salah satu penerapan jaringan saraf tiruan ini adalah di bidang biologi yaitu dalam pengenalan jenis tanaman. Untuk mengenalkan jenis tanaman tersebut, ada yang melihat dari segi bunga ada pula dari daunnya. Dari penelitian sebelumnya, Babu & Srinivasa (2004) telah membahas tentang pengenalan jenis daun menggunakan image processing untuk pengendalian hama dan penyakit pada tanaman. Sistem yang dibuat dengan menggunakan metode backpropagation ini bertujuan untuk melihat daun yang terinfeksi hama dan penyakit pada daun yang nantinya bisa didapatkan solusi untuk penanganannya.

Berdasarkan riset yang pernah diteliti sebelumnya, maka dalam penelitian ini, peneliti ingin melakukan analisa lebih lanjut terhadap daun, dimana daun yang diuji untuk dikenali jenisnya akan menggunakan 2 metode yaitu backpropagation dan simple perceptron, yang didesain untuk operasi pada JST dalam hal pengenalan pola.

Adapun langkah pertama, gambar (image) daun yang didapat terlebih dahulu diproses dengan pemrosesan citra digital seperti pengubahan ke grayscale, konversi ke biner, serta boundary enhancement. Kemudian dilakukan feature extraction untuk mendapatkan ciri-ciri yang dapat mewakili fitur dari

masing-masing daun yang diuji cobakan. Hasil dari feature extraction ini nantinya akan digunakan sebagai input terhadap metode backpropagation dan simple perceptron, kemudian akan diuji dalam sebuah sistem yang dapat melakukan

Berdasarkan latar belakang masalah diatas, maka penulis tertarik untuk meneliti bidang ini dengan mengambil judul “Analisis Perbandingan Neural Network Backpropagation dengan Simple Perceptron dalam Mengenali Image

daun”.

1.2.

Metode Backpropagation telah banyak digunakan sebelumnya oleh para peneliti untuk diaplikasikan ke berbagai objek, seperti pengenalan pola huruf abjad, pengenalan hama dan penyakit pada daun, tes psikologi, identifikasi bentuk rancang bangun gambar 2D, dan yang lainnya. Yang menjadi rumusan masalah dalam penelitian ini adalah metode backpropagation dan simple perceptron akan digunakan untuk melakukan pelatihan dan pengenalan terhadap daun, hal ini dimaksudkan untuk membandingkan tingkat akurasi kedua metode tersebut dalam pengenalan daun.

PERUMUSAN MASALAH

1.3. TUJUAN PENELITIAN

Tujuan dari penelitian ini adalah menganalisis dan membandingkan tingkat keberhasilan metode backpropagation dan metode simple perceptron dalam mengenali pola image daun.

1.4. MANFAAT PENELITIAN

Manfaat yang diharapkan dalam penelitian ini adalah:

1. Hasil penelitian dan program aplikasi ini dibuat untuk mengetahui kelebihan dan kekurangan dari metode perceptron dan backpropagation dalam mengenali image daun.

1.5. BATASAN MASALAH

Batasan masalah dalam penelitian ini adalah : 1.

2.

Metode Jaringan Saraf Tiruan yang digunakan yaitu metode backpropagation dan simple perceptron untuk training dan

recognition.

•

Daun yang digunakan untuk training dan recognation adalah :

•

Daun dewasa, dikarenakan bentuk dan ciri daun tersebut tidak akan berubah.

•

Jumlah daun yang diujikan adalah 1 jenis daun, yaitu daun jarak.

•

Kondisi daun yang dikondisikan sebagai input data adalah daun utuh, rusak sebahagian dan layu.

•

Input neural network adalah hasil ekstraksi fitur dari gambar daun.

BAB II

TINJAUAN PUSTAKA

2.1. Jaringan Saraf Tiruan (JST)

Jaringan saraf tiruan pertama kali secara sederhana diperkenalkan oleh McCulloch dan Pitts pada tahun 1943. McCulloch dan Pitts menyimpulkan bahwa kombinasi beberapa neuron sederhana menjadi sebuah sistem neural akan meningkatkan kemampuan komputasinya. Bobot dalam jaringan yang diusulkan oleh McCulloch dan Pitts diatur untuk melakukan fungsi logika sederhana. Fungsi aktivasi yang dipakai adalah fungsi threshold.

Artificial Neural Network atau Jaringan Saraf Tiruan (JST) adalah salah

satu cabang dari Artificial Intelligence. JST merupakan suatu sistem pemrosesan informasi yang memiliki karakteristik-karakteristik menyerupai jaringan saraf biologi (Fauset, 1994). Hal yang sama diutarakan oleh Simon Haykin, yang menyatakan bahwa JST adalah sebuah mesin yang dirancang untuk memodelkan cara otak manusia mengerjakan fungsi atau tugas-tugas tertentu. Mesin ini memiliki kemampuan menyimpan pengetahuan berdasarkan pengalaman dan menjadikan simpanan pengetahuan yang dimiliki menjadi bermanfaat (Haykin, 2008).

JST dibentuk sebagai generalisasi model matematika dari jaringan saraf biologi, dengan asumsi bahwa :

1. Pengolahan informasi terdiri dari elemen-elemen sederhana yang disebut neuron. Neuron dalam jaringan saraf tiruan sering diganti dengan istilah simpul.

3. Tiap hubungan koneksi mempunyai nilai bobot sendiri. Nilai bobot ini menyediakan informasi yang akan digunakan oleh jaringan untuk memecahkan masalah.

4. Tiap simpul mempergunakan fungsi aktivasi terhadap input yang diterimanya untuk menentukan sinyal keluaran.

2.2. Karakteristrik JST

Karakteristik JST ditentukan oleh 3 hal yaitu:

1. Pola hubungan antar neuron disebut arsiktektur jaringan.

2. Metode untuk menentukan nilai bobot tiap hubungan disebut training/pembelajaran.

3. Fungsi aktivasi (Fungsi Transfer). Fungsi aktivasi dipakai untuk menentukan keluaran suatu neuron. Argumen fungsi aktivasi adalah net masukan (kombinasi linier masukan dan bobotnya). Jika net= ∑xiwi, maka fungsi aktivasinya adalah f(net)=f(∑x iwi

a. Fungsi treshold (batas ambang)

). Beberapa fungsi aktivasi yang sering dipakai adalah sebagai berikut:

f(x) = jikax a

a x jika

≥

≤

1

0

b.Fungsi Sigmoid

f(x) = x e− + 1

1

Fungsi sigmoid sering dipakai karena nilai fungsinya yang terletak antara 0 dan 1 dan dapat diturunkan dengan mudah.

f’(x) = f(x) (1-f(x)) c.Fungsi Identitas

f(x) = x.

2.3. Pemrosesan Informasi dalam JST

Aliran informasi yang diproses disesuaikan dengan arsitektur jaringan. Beberapa konsep utama yang berhubungan dengan proses adalah:

1. Input (masukan), setiap input bersesuaian dengan suatu atribut tunggal. Serangkaian input pada JST diasumsikan sebagai vektor X yang bersesuaian dengan sinyal-sinyal yang masuk ke dalam sinapsis neuron biologis.

2. Output (keluaran), output dari jaringan adalah penyelesaian masalah. Tujuan akhir pembelajaran terhadap variabel masukan X adalah menghasilkan nilai keluaran Y (output) sedekat mungkin dengan nilai keluaran d yang ditargetkan (beda nilai antara keluaran terhadap masukan disebut nilai kesalahan atau error value)

3. Weight (bobot), mengekspresikan kekuatan relatif (atau nilai matematis) dari input data awal atau bermacam-macam hubungan yang mentransfer data dari layer ke layer.

4. Fungsi Penjumlahan, menggandakan setiap nilai input xi dengan bobot

wi dan menjumlahkannya bersama-sama untuk memperoleh suatu

output Y. Fungsi penjumlahan ini bersesuaian dengan badan sel biologis (soma). Untuk n input terhadap satu elemen pemroses (node) terlihat pada gambar 2.1:

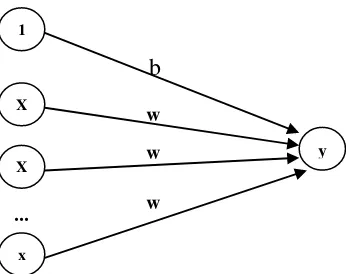

Gambar 2.1. JST dengan n input dan satu elemen pemroses(Fausett, 1994) (2.1)

(2.2)

Untuk n input terhadap beberapa (j) elemen pemroses terlihat pada gambar 2.2:

Gambar 2.2. JST dengan n input dan j elemen pemroses (Fausett, 1994)

2.4. Arsitektur Jaringan

Arsitektur jaringan saraf tiruan digolongkan menjadi 2 model: 1. Jaringan dengan lapisan tunggal (single layer net)

Dalam jaringan ini, sekumpulan input neuron dihubungkan langsung dengan sekumpulan output-nya, seperti gambar 2.3 :

Gambar 2.3. Arsitektur jaringan lapisan tunggal (Siang, 2005)

(2.4)

(2.5)

2. Jaringan dengan banyak lapisan (multilayer net)

Jaringan ini merupakan perluasan dari lapisan tunggal. Dalam jaringan ini, selain unit input dan output, ada unit-unit lain yang sering disebut lapisan tersembunyi. Lapisan tersembunyi ini bisa saja lebih dari satu, seperti gambar 2.4 :

Gambar 2.4. Arsitektur jaringan banyak lapisan(Siang, 2005)

2.5. Pembelajaran / Training dan Testing

Proses pembelajaran suatu JST melibatkan tiga pekerjaan, sebagai berikut: 1. Menghitung output.

2. Membandingkan output dengan target yang diiinginkan. 3. Menyesuaikan bobot dan mengulangi proses

Proses training dimulai dengan men-set bobot dengan aturan tertentu atau random. Perbedaan output aktual (Y atau YT) dan output yang diinginkan disebut

delta. Tujuan yang sebenarnya adalah meminimalkan error. Dalam proses testing ini diberikan input data yang disimpan dalam disk (file testing). JST yang telah dilatih akan mengambil data tersebut dan memberikan output yang merupakan “Hasil Prediksi JST”. JST memberikan output berdasarkan bobot yang disimpan dalam proses training.

2.6. Metode Pengenalan Pola (Recognition) dengan Jaringan Saraf Tiruan

Metode pengenalan pola dengan JST ini dilatih dengan seperangkat data untuk bisa mengenal dan mengidentifikasi pola data atau kurva. Proses pelatihan ini sering disebut tahap belajar (learning process). Sehingga learning process ini menjadi bagian yang penting juga dalam metode ini. Pemilihan algoritma dan parameter yang bersesuaian dan penentuan berapa banyak perangkat data yang dibutuhkan dalam learning process ini sangat penting untuk menentukan akurasi dari peramalan yang dihasilkan (Hagan, 1996).

Pada saat awal neural network diset secara acak, kemudian perangkat data dimasukkan ke jaringan saraf untuk pembelajaran atau pelatihan. Ketika data dimasukkan, jaringan saraf akan belajar dengan mengubah parameter-parameternya sehingga semakin mendekati atau semakin sesuai dengan pola data masukan tersebut. Ketika semua data latih sudah dimasukkan, jaringan saraf dianggap sudah dapat mengenal dan mengidentifikasi pola data tersebut sehingga telah siap digunakan untuk menghasilkan keluaran. Hasil keluarannya dengan demikian akan sesuai dengan pola data yang telah diidentifikasi oleh neural network.

Pada prinsipnya ada dua cara untuk melatih neural network yaitu dengan supervised learning dan unsupervised learning. Pada unsupervised learning,

neural network hanya diberi data masukan saja tapi bagaimana outputnya tidak

ditentukan. Ketika data yang dimasukkan bertambah, neural network akan mengkategorikan atau mengelompokkan data masukan tersebut. Pada supervised learning, neural network diberi sepasang data latih yang terdiri dari data masukan

dan target. Jadi ketika data yang dimasukan bertambah neural network akan mengubah karakteristik internalnya agar sebisa mungkin menghasilkan keluaran seperti targetnya. Maka dengan demikian cara learning yang bisa dipakai untuk pengenalan pola adalah yang supervised learning karena data yang harus dilatihkan adalah berupa pasangan data input dan target (Hagan, 1996).

Neural network yang dilatih dengan supervised learning ada banyak

adaptive linear neuron (ADALINE), backpropagation, Gradient Type Network,

Linear Associative Memory (Hagan, 1996).

2.7. Learning Rate(α)

Learning rate merupakan salah satu parameter training untuk menghitung nilai

koreksi bobot pada waktu proses training. Nilai α ini berada pada range nol (0) sampai (1). Semakin besar nilai learning rate, maka proses training akan berjalan semakin cepat. Namun apabila nilai learning rate relatif terlalu besar, pada umumnya proses training dapat melampaui keadaan optimal yaitu pada saat dicapai nilai error yang paling minimal. Dengan kata lain, learning rate mempengaruhi ketelitian jaringan suatu sistem. Semakin besar learning rate, maka ketelitian jaringan akan semakin berkurang, tetapi berlaku sebaliknya, apabila learning rate-nya semakin kecil, maka ketelitian jaringan akan semakin besar atau

bertambah dengan konsekuensi proses training akan memakan waktu yang semakin lama (Skapura, 1991, pp.104)

2.8. Jaringan Saraf Tiruan Perceptron

Model jaringan perceptron ditemukan oleh Rosenblatt (1962) dan Minsky-Papert

(1969)

Gambar 2.5.Arsitektur Jaringan Perceptron (Du et al, 2006)

Jaringan terdiri dari beberapa unit masukan (ditambah sebuah bias), dan memiliki sebuah unit keluaran. Hanya saja fungsi aktivasi bukan merupakan fungsi biner (atau bipolar), tetapi memiliki kemungkinan nilai -1, 0 atau 1.

Untuk suatu harga treshold θ yang ditentukan:

f (net) =

Secara geometris, fungsi aktivasi membentuk 2 garis sekaligus, masing-masing dengan persamaan :

w1x1 + w2x2 + ... + wnxn

w

+ b = θ, dan 1x1 + w2x2 + ... + wnxn + b = -θ

2.8.1. Algoritma perceptron Misalkan

s adalah vektor masukan dan t adalah target keluaran α adalah laju pemahaman (learning rate) yang ditentukan θ adalah threshold yang ditentukan

Algoritma pelatihan perceptron adalah sebagai berikut:

1

X

X

x

y

b

w

w

w ...

{

1 0 -1Jika net > θ Jika –θ≤ net ≤θ

Jika net <- θ

(2.7)

1. Inisialisasi semua bobot dan bias (umumnya wi

Set learning rate :

α

(0<α

≤ 1). Untuk penyederhanaan, biasanya α diberi nilai=1= b = 0)

2. Selama kondisi berhenti bernilai false, lakukan langkah-langkah berikut: a. Set aktivasi unit masukan xi = si

b. Hitung respon unit keluaran : y_in =

(i = 1, ..., n)

∑

+i i

iw b

x

y=f (net) =

c. Perbaiki bobot dan bias jika terjadi error: Jika y ≠ t maka :

wi (baru) = wi (lama) +α t x

b (baru) = b (lama) + α t

i

Jika tidak maka : wi (baru) = wi

b (baru) = b (lama) (lama)

3. Tes kondisi berhenti : jika terjadi perubahan bobot pada (i) maka kondisi berhenti TRUE, namun jika masih terjadi perubahan maka kondisi berhenti FALSE.

2.8.2. Delta Rule

Widrow dan Hoff (1960) mengembangkan perceptron dengan memperkenalkan aturan pelatihan jaringan, yang dikenal sebagai aturan delta (atau sering disebut kuadrat rata-rata terkecil). Aturan ini akan mengubah bobot perceptron apabila keluaran yang dihasilkan tidak sesuai dengan target yang diinginkan. Pada delta rule akan mengubah bobot yang menghubungkan antara jaringan input ke unit

input (y_in) dengan nilai target (t). Hal ini dilakukan untuk meminimalkan error

{

1 0 -1Jika y_in > θ

selama pelatihan pola. Delta rule untuk memperbaiki bobot ke-i (untuk setiap pola) adalah :

∆wi=α(t-y_in) x

dengan :

i

x = vektor input

y_in = input jaringan ke unit output Y y_in =

∑

=

n

i i

iw

x

1

t = target (output)

Nilai w baru diperoleh dari nilai w lama ditambah dengan ∆w, wi = wi+∆wi

2.9. Jaringan Saraf Tiruan Backpropagation

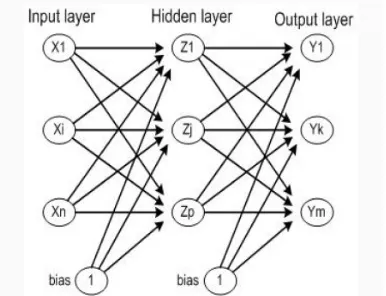

Jaringan Saraf Tiruan Propagasi Balik (Backpropagation) merupakan jaringan saraf tiruan yang populer digunakan untuk memecahkan masalah. Model Propagasi Balik pertama kali ditemukan oleh Paul Werbos pada tahun 1974, kemudian dikembangkan secara terpisah oleh Rumelhart, yang memungkinkan jaringan diproses melalui beberapa layer. Sejak dikembangkan oleh Rumelhart, model Propagasi Balik sangat diminati untuk digunakan sebagai algoritma pembelajaran pada JST multilayer. Hal ini disebabkan karena model Propagasi Balik dapat menangulangi kelemahan pada JST single layer dalam pengenalan pola. Kelemahan ini dapat ditanggulangi dengan menambahkan satu atau beberapa lapisan tersembunyi (hidden layer) diantara lapisan masukan dan keluaran. Gambar 2.6 merupakan arsitektur model backpropagation yang memiliki beberapa unit yang ada dalam satu atau lebih lapisan tersembunyi.

(2.9)

(2.10)

Gambar 2.6.Arsitektur Model Backpropagation (Du et al, 2006)

JST propagasi balik adalah JST dengan topologi multilayer dengan satu layer masukan (lapis X), satu atau lebih lapis hidden atau tersembunyi (lapis Z) dan satu layer keluaran (lapis Y). Setiap lapis memiliki neuron-neuron (unit-unit) yang dimodelkan dengan lingkaran (Gambar 2.6). Di antara neuron pada satu layer dengan neuron pada layer berikutnya dihubungkan dengan model koneksi

yang memiliki bobot-bobot (weights), w dan v. Lapis tersembunyi dapat memiliki bias

Pelatihan dengan backpropagation sama halnya seperti pelatihan pada jaringan saraf yang lain. Pada jaringan feedfoward (umpan maju), pelatihan dilakukan dalam rangka perhitungan bobot sehingga pada akhir pelatihan akan diperoleh bobot-bobot yang baik. Selama proses pelatihan, bobot-bobot diatur secara iteratif untuk meminimumkan error (kesalahan) yang terjadi. Kesalahan dihitung berdasarkan rata-rata kuadrat kesalahan (MSE). Rata-rata kuadrat kesalahan juga dijadikan dasar perhitungan unjuk kerja fungsi aktivasi.

, yang memiliki bobot sama dengan satu (Dhaneswara et al, 2004).

Ada 3 fase Pelatihan backpropagation antara lain : 1. Fase 1, yaitu propagasi maju.

Dalam propagasi maju, setiap sinyal masukan dipropagasi (dihitung maju) ke layer tersembunyi hingga layer keluaran dengan menggunakan fungsi aktivasi

2. Fase 2, yaitu propagasi mundur.

Kesalahan (selisih antara keluaran jaringan dengan target yang diinginkan) yang terjadi dipropagasi mundur mulai dari garis yang berhubungan langsung dengan unit-unit di layar keluaran.

3. Fase 3, yaitu perubahan bobot.

Pada fase ini dilakukan modifikasi bobot untuk menurunkan kesalahan yang terjadi. Ketiga fase tersebut diulang-ulang terus hingga kondisi penghentian dipenuhi.

2.9.1. Algoritma backpropagation:

o Inisialisasi bobot (ambil bobot awal dengan nilai random yang cukup kecil). o Kerjakan langkah-langkah berikut selama kondisi bernilai FALSE :

1. Untuk tiap-tiap pasangan elemen yang akan dilakukan pembelajaran, kerjakan:

Feedforward:

a. Tiap-tiap unit input (Xi, i=1,2,3,...,n) menerima sinyal xi

b. Tiap-tiap unit tersembunyi (Z

dan meneruskan sinyal tersebut ke semua unit pada lapisan yang ada diatasnya (lapisan tersembunyi).

i

z_in

, j=1,2,3,...,p) menjumlahkan sinyal-sinyal input terbobot :

j= v0 j

∑

= n i ij iv x 1 +

gunakan fungsi aktivasi untuk menghitung sinyal output-nya : zj = f(z_inj

dan kirimkan sinyal tersebut ke semua unit di layer atasnya (unit-unit output)

)

c. Tiap-tiap unit output (Yk

y_in

, k=1,2,3,...,m) menjumlahkan sinyal-sinyal input terbobot.

k= w0 k

∑

gunakan fungsi aktivasi untuk menghitung sinyal outputnya : yk = f(y_ink

dan kirimkan sinyal tersebut ke semua unit di lapisan atasnya (unit-unit output).

)

Backpropagation:

d. Tiap-tiap unit output (Yk

δ

, k=1,2,3,...,m) menerima target pola yang berhubungan dengan pola input pembelajaran, hitung informasi error-nya:

k= (tk-yk) f’(y_ink

kemudian hitung koreksi bobot (yang nantinya akan digunakan untuk memperbaiki nilai w

)

jk

∆w

) :

jk=α δk zj

hitung juga koreksi bias (yang nantinya akan digunakan untuk memperbaiki nilai w0k

∆w ):

0k=α δk

kirimkan ini ke unit-unit yang ada layer bawahnya. e. Tiap-tiap unit tersembunyi (Zj

δ_in

, j=1,2,3,...,p) menjumlahkan delta input-nya (dari unit-unit yang berada pada lapisan di atasinput-nya):

j

∑

= m k jk kw 1 δ =kalikan nilai ini dengan turunan dari fungsi aktivasinya untuk menghitung informasi error :

δj = δ_ in j f’(z_inj

kemudian hitung koreksi bias (yang nantinya akan digunakan untuk memperbaiki nilai v

)

ij

∆v ) :

jk=α δj x

hitung juga koreksi bias (yang nantinya akan digunakan untuk memperbaiki nilai v

i

∆v0j=α δ

f. Tiap-tiap unit output (Y

j

k

w

, k=1,2,3,...,m) memperbaiki bias dan bobotnya (j=0,1,2,...,p):

jk(baru)=wjk(lama)+ ∆w

tiap-tiap unit tersembunyi (Z

jk

j

v

, j=1,2,3,...,p) memperbaiki bias dan bobtnya (i=0,1,2,...,n):

ij(baru)= vij (lama)+ ∆ vij

2. Tes kondisi berhenti.

2.10. Digital Image Processing

Gonzales (2002) mendefenisikan image processing adalah suatu metode yang digunakan untuk mengolah atau memanipulasi gambar dalam bentuk 2 dimensi. Image Processing dapat juga dikatakan segala operasi untuk memperbaiki,

menganalisa, atau mengubah suatu gambar. Konsep dasar pemrosesan gambar digital menggunakan image processing diambil dari kemampuan indera manusia yang selanjutnya dihubungkan dengan kemampuan otak manusia untuk melakukan proses atau pengolahan terhadap gambar digital tersebut.

Pada umumnya objektivitas dari image processing adalah melakukan transformasi atau analisa suatu gambar sehingga informasi baru tentang gambar dibuat lebih jelas.

2.10.1.Grayscaling

Grayscaling adalah proses perubahan nilai pixel dari warna (RGB) menjadi

gray-level (Gonzalez, 2002). Pada dasarnya proses ini dilakukan dengan meratakan

Gray= 0.2989 * R + 0.5870 * G + 0.1140 * B

Keterangan: R = merah(red) G = hijau(G) B = biru(B)

2.10.2.Thresholding

(Wu, 2007), Gambar hitam putih relatif lebih mudah dianalisa dibandingkan dengan gambar berwarna Karena itu sebelum dianalisa, gambar dikonversikan terlebih dahulu menjadi binary image. Proses konversi ini disebut thresholding. Dalam proses thresholding, warna yang ada dikelompokkan menjadi 0 (hitam) dan 1 (putih). Pengelompokannya berdasarkan pada suatu konstanta ambang batas (level). Jika nilai pixel lebih besar sama dengan level, maka nilai output-nya adalah 1, dan sebaliknya, jika nilai pixel lebih kecil dari level, maka nilai output-nya 0. Jika f(n,m) adalah pixel pada gambar awal, dan g(n,m) adalah picel gambar yang sudah melalui proses thresholding, maka:

g(n,m) = 0 jika f(n,m) < level g(n,m) = 1 jika f(n,m) ≥ level

2.10.3.Boundary Enhancement

(Wu, 2007), Boundary dari sebuah region adalah kumpulan dari semua pixel yang terdapat pada region tersebut yang memiliki paling sedikit satu tetangga pixel yang tidak terdapat di dalam region tersebut. Boundary Enhancement digunakan untuk menentukan margin dari daun. Pada bagian ini, untuk menentukan margin suatu objek menggunakan Laplacian Filter dengan 3x3 spatial mask, seperti Gambar 2.7:

Gambar 2.7. Boundary Enhancement (Wu, 2007)

Laplacian adalah sebuah ukuran isotropic 2-D dari turunan spatial kedua dari

sebuah image. Laplacian Filter menyoroti area gambar dengan mengubah intensitas secara cepat dan biasanya digunakan untuk mendeteksi garis.

2.11. Riset-riset terkait

Terdapat beberapa riset yang telah dilakukan oleh banyak peneliti berkaitan dengan metode backpropagation dan simple perceptron seperti yang akan dijelaskan di bawah ini.

Sholahuddin (2002), dalam risetnya menjelaskan bahwa neural network dengan menggunakan metode backpropagation telah diaplikasikan dengan sukses untuk pengenalan pola huruf abjad. Untuk mencobanya dibuat software yang di-training untuk mengenali pola huruf setelah itu dicoba untuk mengenali huruf

yang dimasukkan, ternyata software tersebut mengenalinya bahkan dicoba huruf-huruf tersebut diberi noise, tapi dalam batas-batas tertentu tetap masih mengenali huruf-huruf tersebut. Dari metode tersebut bisa dikembangkan lebih jauh lagi, misalnya pengenalan pola wajah, pengenalan pola tanda tangan dan lain-lain.

Wahab (2004), dalam risetnya menjelaskan bahwa aplikasi jaringan saraf tiruan berupa perceptron dengan algoritma supervised learning, yaitu metode backpropagation dan dikenal sebagai backpropagation multi layer perceptron

atau BMLP. Jaringan BMLP ini menggunakan fungsi integrasi linier dan fungsi aktivasi sigmoid unipolar dengan λ=1. Jaringan BMLP ini akan digunakan untuk mengidentifikasi persamaan dinamika sistem. Pada kasus pertama, digunakan dinamika sistem berupa persamaan matematika non-linier sederhana, yang memiliki karakteristik dinamika sistem satu masukan dan satu keluaran. Jaringan

BMLP yang digunakan terdiri dari dua lapis, lapis tersembunyi pertama dengan 8 simpul dan lapis kedua merupakan layer keluaran. Proses belajar jaringan akan menggunakan aturan belajar backpropagation dengan konstanta belajar η=1. Identifikasi menggunakan sejumlah data yang diperoleh dari pasangan masukan-keluaran sistem yang akan dibangkitkan dari sistem tersebut sehingga hasil identifikasi dapat dibandingkan langsung. Pada kasus kedua, jaringan BMLP digunakan untuk mengidentifikasi dinamika sistem kiln semen, yang merupakan sistem nonlinier multivariabel. BMLP terdiri dari 8 masukan dan 20 neuron pada layer tersembunyi pertama, 10 neuron pada layer tersembunyi kedua dan 5 keluaran, digunakan untuk mengidentifikasi dinamika sistem kiln semen berdasarkan data masukan dan keluaran sistem yang diperoleh langsung dari akuisisi data di suatu pabrik semen di dalam negeri. Hasil riset menunjukkan ketelitian identifikasi tergantung kepada jumlah epoch yang digunakan dalam melatih JST tersebut.

Yulianto (2010), dalam risetnya menjelaskan bahwa di dunia teknologi, media layar sentuh atau smartboard sebagai langkah kemajuan dibidang media pembelajaran. Sedang dari layar sentuh atau smartboard yang dijadikan dalam penelitian ini adalah bagaimana layar sentuh atau smartboard tersebut bisa mengidentifikasi bentuk rancang bangun gambar 2D menjadi output sesuai dengan target yang diinginkan. Neural Network adalah salah satu cabang dari Artificial Intelligent. Salah satu metode dalam Neural Network adalah

Backpropagation. Aplikasi Neural Network diantaranya : untuk prediksi, pengenalan pola, identifikasi dan simulasi. Proses identifikasi rancang bangun memerlukan image processing agar dapat digunakan sebagai masukan pada Neural Network. Dalam paper ini, Neural Network dengan menggunakan metode

BAB 3

METODOLOGI PENELITIAN

3.1 Analisis Sistem metode perceptron dan backpropagation

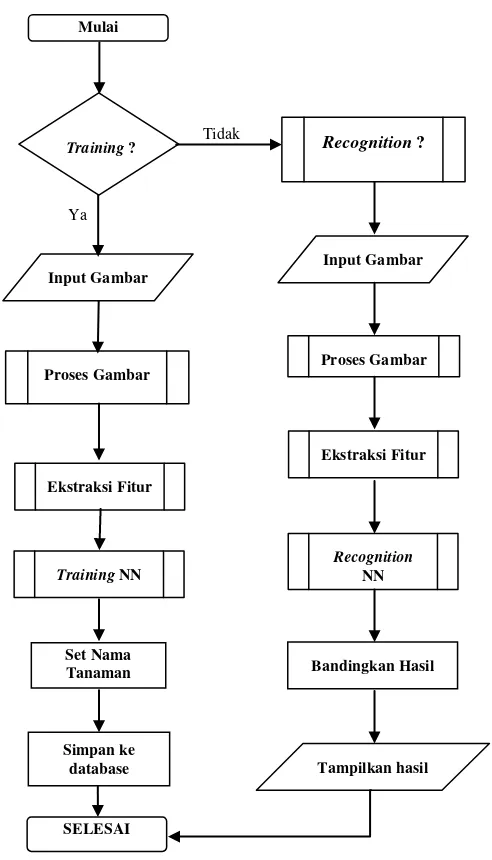

Tahapan analisis terhadap suatu sistem dilakukan sebelum tahapan perancangan dilakukan. Sistem pengenalan pola pada penelitian ini adalah neural network dengan backpropagation dan perceptron sebagai metode pelatihan untuk memperoleh bobot neural network sebagai aplikasi pengenalan daun. Gambar yang akan digunakan sebagai data pelatihan maupun data pengujian terlebih dahulu diolah menggunakan image processing sehingga dapat digunakan sebagai masukan neural network. Data gambar berwarna diubah menjadi manjadi data gambar grayscale sehingga diperoleh dimensi data yang lebih kecil. Proses selanjutnya adalah proses thresholding yaitu proses mengubah gambar yang memiliki tingkat warna abu-abu menjadi gambar biner berdasarkan suatu nilai tertentu yang menjadi tolak ukurnya yaitu nilai antara 0 (hitam) 255 (putih).

Salah satu unsur pokok yang harus dipertimbangkan dalam tahapan analisis sistem ini yaitu masalah perangkat lunak, karena perangkat lunak yang digunakan haruslah sesuai dengan masalah yang akan diselesaikan. Software yang dipakai untuk perancangan perangkat lunak adalah Microsoft Visual Basic 6.0. Software ini dipilih karena tampilan dan penggunaan tools-nya yang user friendly.

Untuk memudahkan perancangan perangkat lunak tersebut, maka dibutuhkan arsitektur jaringan dari metode perceptron dan backpropagation serta flowchart dari setiap mekanisme yang ada. Alasan penggunaan arsitektur jaringan dan flowchart adalah supaya dapat digambarkan secara jelas alur dari proses, struktur

pada sistem. Setelah arsitektur jaringan dan flowchart terbentuk, barulah dilakukan proses pembentukan sistem yang sebenarnya.

3.2 Arsitektur Jaringan Metode Perceptron dan Backpropagation

Arsitektur jaringan untuk metode perceptron yang akan diterapkan pada sistem dalam penelitian ini yaitu terdapat 2 input (x1 dan x2) dengan 1 output (target t).

Arsitektur jaringan terdiri dari 1 lapisan input dan 1 lapisan output. Hanya ada 1 neuron pada lapisan output, karena target yang diharapkan berbentuk biner, maka fungsi aktivasi yang digunakan adalah fungsi hard limit, dirumuskan sebagai:

y=

Arsitektur jaringan untuk metode perceptron seperti yang ditunjukkan pada gambar 3.1:

Gambar 3.1.Arsitektur jaringan metode perceptron

{

1, 0,Jika x ≤ 0

Jika x > 0

x2

x1

∑xw

w2

F(y_in) y_in

w1

Untuk metode backpropagation seperti yang ditunjukkan pada gambar 3.2, akan dibentuk jaringan saraf untuk operasi XOR. Ada 2 input (x1 dan x2

• Lapisan input, Bobot awal yang menguhubungkan neuron-neuron pada lapisan input dan lapisan tersembunyi (v

) dengan 1 output (target t). Arsitektur jaringan terdiri dari:

11, v12, v21, v22) dan bobot bias v01

dan v02 dipilih secara acak. Demikian pula bobot awal yang menghubungkan

neuron-neuron pada lapisan tersembunyi dan lapisan output (w1,w2) dan

bobot bias w0

• Lapisan tersembunyi dengan 4 neuron, fungsi aktivasi yang digunakan pada setiap neuron pada lapisan ini adalah fungsi sigmoid : z=

juga dipilih secara acak.

in z e _ 1 1 − +

• Lapisan output dengan 1 neuron, fungsi aktivasi yang digunakan pada neuron di lapisan ini adalah fungsi sigmoid: y= y in

e _ 1

1

−

[image:42.595.113.558.442.707.2]+

Gambar 3.2.Arsitektur jaringan metode backpropagation z1

y x1

V01+

∑

= 2 1 1 i i iv

x z_in1

z2 V02+

∑

= 2 1 2 i i iv

x z_in2

z3 V03+

∑

= 2 1 3 i i iv

x z_in3

z4 V04+

∑

= 2 1 4 i i iv

x z_in4

x2

1

w0+

∑

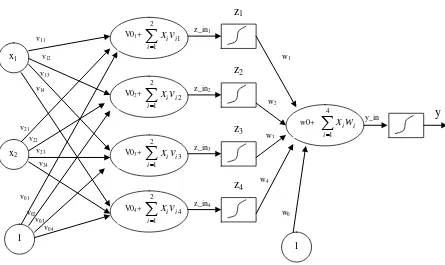

3.3 Flowchart Sistem

[image:43.595.194.440.278.708.2]Pada sub bab ini, akan membahas flowchart dari sistem secara keseluruhan menggunakan metode backpropagation dan simple perceptron. Secara garis besar, sistem aplikasi ini dibagi menjadi 2 bagian utama, yaitu pelatihan (training) daun, dan pengenalan (recognition) daun. Flowchart dari sistem akan ditunjukkan pada gambar 3.3:

Gambar 3.3.

Ya

Flowchart garis besar sistem Mulai

Training ?

Input Gambar

Proses Gambar

Ekstraksi Fitur

Recognition

NN

Bandingkan Hasil Input Gambar

Proses Gambar

Ekstraksi Fitur

Set Nama Tanaman

Training NN

SELESAI

Tidak

Simpan ke database

Recognition ?

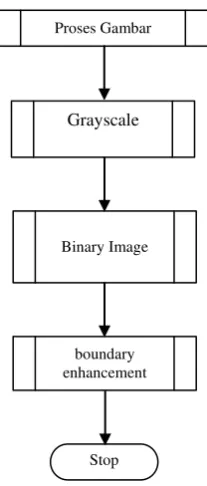

Pada proses gambar merupakan proses yang menunjukkan pendahuluan gambar untuk mendapatkan ekstraksi fitur pada daun. Proses ini mengubah gambar RGB menjadi grayscale. Kemudian dari grayscale diproses menjadi gambar biner (image binary), yang biasanya disebut dengan proses thresholding. Untuk mencari tepi daun yang biasanya disebut margin, menggunakan boundary enhancement. Flowchart ini dapat dilihat pada gambar 3.4:

Gambar 3.4.Flowchart untuk proses gambar

Proses Gambar

Grayscale

Binary Image

boundary enhancement

Berikut ini adalah penjelasan lebih detail dari flowchart di atas:

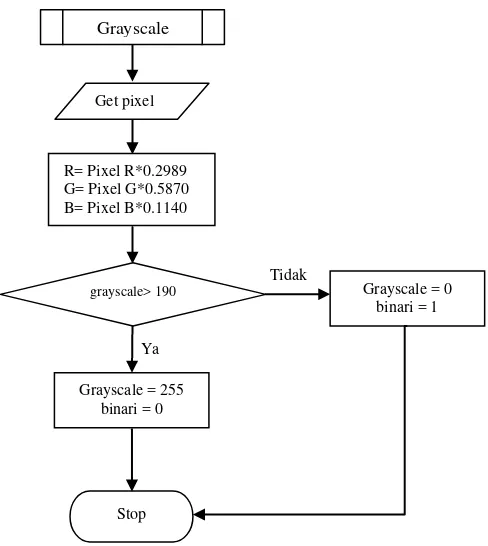

3.3.1 Grayscale

Pada proses grayscale, mengambil nilai dari tiap-tiap pixel gambar, dimana nilai pixel R dikalikan dengan 0.2989, nilai pixel G dikalikan dengan 0.5870, dan nilai

pixel B dikalikan dengan 0.1140. Gambar 3.5 berikut ini adalah flowchart dari

[image:45.595.191.435.296.569.2]proses grayscale:

Gambar 3.5.Flowchart untuk proses grayscale

Grayscale

Get pixel

R= Pixel R*0.2989 G= Pixel G*0.5870 B= Pixel B*0.1140

Stop Grayscale = 255

binari = 0

grayscale> 190

Ya

Tidak

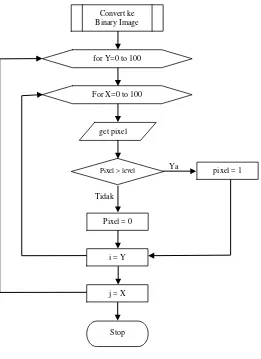

3.3.2 Convert ke Binary Image

[image:46.595.196.457.221.580.2]Pada proses ini mengubah gambar dari grayscale menjadi gambar binary (hitam-putih) dengan batasan level tertentu. Gambar 3.6 berikut ini adalah flowchart dari proses convert ke binary image :

Gambar 3.6.Flowchart untuk proses mengubah gambar menjadi binary

Convert ke Binary Image

for Y=0 to 100

For X=0 to 100

get pixel

Pixel = 0

Stop

Pixel > level Ya pixel = 1

Tidak

i = Y

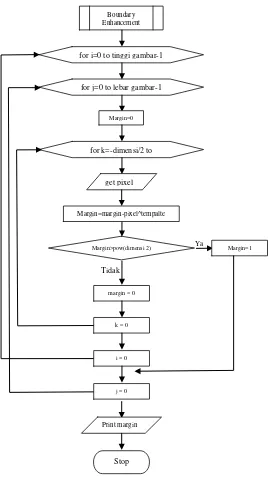

3.3.3 Boundary Enhancement

[image:47.595.191.461.202.685.2]Pada proses ini terjadi proses untuk mencari margin dengan menggunakan laplacian filter, dimana laplacian filter sebagai template, seperti Gambar 3.7:

Gambar 3.7.Flowchart untuk boundary enhancement

Boundary Enhancement

for i=0 to tinggi gambar-1

for j=0 to lebar gambar-1

get pixel

margin = 0

Stop

Margin>pow(dimensi 2) Ya Margin=1

Tidak

Margin=0

for k=-dimensi/2 to

Margin=margin-pixel^tempalte

Print margin

k = 0

i = 0

3.4 Flowchart Training Perceptron dan Backpropagation

Pada bagian ini, input training adalah geometri dasar daun dari proses ekstraksi fitur. Kemudian dilakukan inisialisasi bobot awal (set weight) dengan data transpose dari input training. Kemudian masuk ke dalam proses pembelajaran

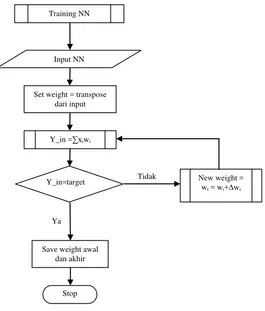

[image:48.595.237.502.310.621.2]atau training untuk mendapatkan bobot (weight) yang sesuai. Proses akhir menyimpan bobot awal dan bobot akhir yang akan digunakan untuk proses pengenalan. Flowchart untuk training perceptron ini dapat dilihat pada gambar 3.8:

Gambar 3.8.Flowchart pelatihan daun (training) perceptron

Training NN

Input NN

Set weight = transpose dari input

Y_in =∑xiwi

Stop Save weight awal

dan akhir Y_in=target

Ya

Tidak New weight =

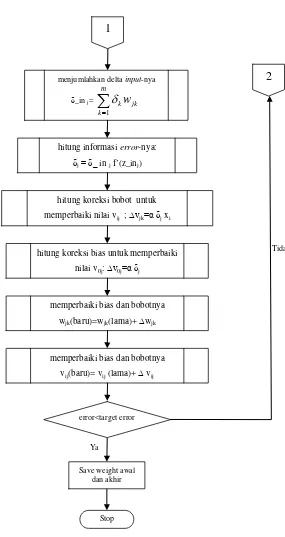

Sedangkan 3.9:

untuk training backpropagation ditunjukkan pada flowchart gambar

Training NN

Input NN

Set weight = transpose dari input

Y_in =∑xiwi

z_in j= v0 j+

∑

=

n

i ij iv

x

1

fungsi aktivasi untuk menghitung sinyal output-nya: zj = f(z_inj)

y_in k= w0 k+

∑

=

p

i

jk

iw

z

1

fungsi aktivasi untuk menghitung sinyal output-nya= yk = f(y_ink)

hitung informasi error-nya:

δk= (tk-yk) f’(y_ink)

hitung koreksi bobot untuk memperbaiki nilai wjk ; ∆wjk=α δk zj

hitung koreksi bias untuk memperbaiki nilai w0k: ∆w0k=α δk

Gambar 3.9.Flowchart pelatihan daun (training) backpropagation

Stop error<target error

Save weight awal dan akhir menjumlahkan delta input-nya

δ_in j=

∑

=

m

k

jk

kw

1

δ

hitung informasi error-nya:

δj= δ_ in j f’(z_inj)

hitung koreksi bobot untuk memperbaiki nilai vij ; ∆vjk=α δj xi

hitung koreksi bias untuk memperbaiki nilai v0j: ∆v0j=α δj

memperbaiki bias dan bobotnya wjk(baru)=wjk(lama)+ ∆wjk

memperbaiki bias dan bobotnya vij(baru)= vij (lama)+ ∆ vij

Ya

Tidak

1

3.5 Flowchart Recognition Perceptron dan Backpropagation

[image:51.595.250.374.344.702.2]Proses pertama yang dilakukan adalah mengambil (load) dan menentukan target pelatihan (training) yang disimpan dari database. Input NN diperoleh dari ekstraksi geometri dasar daun. Kemudian mengambil (load) data bobot (weight) awal dan akhir database dan memasukkan nilai bobot ke dalam variabel bobot untuk proses pengenalan (recognition). Setelah mendapatkan nilai aktivasinya, dicari hasil output (find output) dan dibandingkan hasilnya dengan membandingkan target yang sudah disimpan di dalam database. Flowchart untuk recognition perceptron ini disajikan pada gambar 3.10:

Gambar 3.10. Flowchart untuk pengenalan daun (recognition) perceptron

Recognition NN

Input NN

Load & Set weight

Y_in =∑xiwi

Stop

Compare output dengan data yang menjadi target

Display result

Load & set target

Sedangkan flowchart untuk recognition backpropagation ditunjukkan pada gambar 3.11:

Gambar 3.8.Flowchart untuk pengenalan daun (recognition) backpropagation

Recognition NN

Input NN

Load & Set weight

Stop

Compare output dengan data yang menjadi target

Display result

Load & set target

Find Output z_in j= v0 j+

∑

=

n

i ij iv

x

1

fungsi aktivasi untuk menghitung sinyal output-nya= zj = f(z_inj)

y_in k= w0 k+

∑

=

p

i

jk

iw

z

1

3.6 Perencanaan User Interface

Pada aplikasi ini terdapat lima user interface utama yang digunakan untuk mendukung penampilan dari aplikasi, yaitu perencanaan form menu, perencanaan form pelatihan (training) untuk metode perceptron, perencanaan form pelatihan (training) untuk metode backpropagation, perencanaan form pengenalan untuk metode perceptron, dan perencanaan form pengenalan untuk metode backpropagation.

3.5.1 Perencanaan Desain Form Menu

Perencanaan desain form menu ini, terdapat menu pilihan yang menghubungkan ke form lainnya. Tampilan desain form menu dapat dilihat pada gambar 3.12 :

Gambar 3.12.Rencana Interface Form Menu

Menu bar pilihan untuk training atau recognition metode perceptron dan backpropagation

Tombol : Keluar Label : Judul Program

3.5.2 Perencanaan Desain Form Pelatihan (Training)

Gambar 3.13.Rencana Interface Form Pelatihan (Training)

Tampilan perencanaan form pelatihan (training) pada gambar 3.13, digunakan untuk metode perceptron dan backpropagation. Terdapat tombol untuk menampilkan gambar yang akan dibuka (open file), dan tombol untuk memproses gambar (Proses Image), pada saat gambar daun yang dimasukkan diproses, maka pada bagian 1 akan muncul ekstraksi fitur daun yang sudah dikonversikan ke dalam binary Image. Sedangkan hasil dari ekstraksi fitur akan dijadikan input yang ditampilakan pada bagian 2. Tombol training digunakan untuk melakukan pelatihan (training), yang hasilnya akan ditampilkan di bagian 3.

Tombol : Open File

1

[image:54.595.107.540.139.462.2]PictureBox : Gambar daun

Tombol Proses Image

Tombol : Training

Tombol : Save

Label Nomor

Label Nama

TextBox: Isi Nomor

TextBox: Isi Nama

Tombol : Keluar

DataGrid

2

3

3.5.3 Perencanaan Desain Form Pengenalan (Recognition)

Gambar 3.14.Rencana Interface Form Pengenalan (Recognition)

Perencanaan desain form pengenalan pada gambar 3.14, terdapat tombol untuk menampilkan gambar yang akan dibuka (open file), dan tombol untuk memproses gambar (Proses Image), sedangkan hasil proses gambar sebelum pengenalan dan hasil proses pengenalan akan ditampilkan pada canvas bagian 1. Tombol kenali berfungsi untuk melakukan pengenalan (recognition). Kemudian hasil pengenalan akan ditampilkan pada kotak nama daun beserta persen(%) pengenalannya.

Tombol : Open File

1

[image:55.595.118.502.153.437.2]PictureBox : Gambar daun

Tombol Proses Image

Tombol : Kenali

Label Nama Daun

Label % Pengenalan TextBox: Nama daun

TextBox: % Pengenalan

BAB IV

ANALISIS DAN PEMBAHASAN

Pada bab ini akan membahas tentang pengujian dari sistem yang dibuat. Pengujian ini dilakukan dengan tujuan untuk mengetahui kelebihan dan kekurangan dari aplikasi ini.

4.1 Inisialisasi untuk Metode Perceptron dan Backpropagation

Proses ini diawali dengan memilih menu yang ada pada tampilan utama saat aplikasi dijalankan. Form tampilan menu utama ditunjukkan pada gambar 4.1:

Gambar 4.1. Tampilan Menu Utama

Gambar 4.2. Tampilan Sub Menu Pilihan

Setelah itu akan masuk ke form training seperti yang ditunjukkan pada gambar 4.3. Untuk training, langkah awal yang harus dilakukan adalah masuk ke tahap image processing yaitu memilih jenis daun dalam bentuk *.bmp atau *.jpg

melalui tombol open file untuk diproses sehingga dapat dipakai pada proses pelatihan dan pengenalan.

Gambar 4.3. Tampilan form training

[image:57.595.137.491.380.590.2]Binary image dari gambar daun akan diubah menjadi matriks biner 100 x 100,

[image:58.595.131.496.290.719.2]dimana warna putih direpresentasikan dengan nilai 1, dan warna hitam dengan nilai 0. Berikut ini adalah hasil gambar yang sudah dikonversikan ke dalam bentuk matriks biner.

Untuk menyederhanakan perhitungan, matriks 100x100 diubah menjadi matriks 10x10 dengan cara menjumlahkan setiap matriks 10x10 seperti yang ditunjukkan pada potongan gambar 4.5:

Gambar 4.5. Tampilan penyederhanaa daun matriks 100 x 100

Cara ini berguna untuk mencari tepi daun yang biasanya disebut margin, menggunakan boundary enhancement. Apabila hasil penjumlahan matriks 10x10=100, maka matriks hasilnya diberi nilai 0, jika antara 1-99, maka matriks hasilnya diberi nilai 1. Tampilan daun matriks 10x10 disajikan pada gambar 4.6:

0 0 0 0 1 1 0 0 0 0

0 0 1 1 1 1 1 1 0 0

0 0 1 1 1 1 1 1 0 0

0 1 1 1 1 1 1 1 1 0 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1

0 1 1 1 1 1 1 1 1 0

0 0 0 0 1 1 0 0 0 0

0 0 1 1 0 0 1 1 0 0

0 0 1 0 0 0 0 1 0 0

0 1 1 0 0 0 0 0 1 0 1 1 0 0 0 0 0 0 0 1 1 0 0 0 0 0 0 0 0 1 1 0 0 0 0 0 0 0 0 1 1 0 0 0 0 0 0 0 0 1 1 1 0 0 1 1 0 0 0 1

0 1 1 1 1 1 1 1 1 0

Setiap matriks 10 x 2 yang pertama ditransformasikan menjadi matriks 2x10, kemudian matriks 10x2 yang kedua ditransformasikan menjadi matriks 2x10 dan ditempatkan di bawah matriks 2x10 yang sebelumnya seperti tabel 4.1:

Tabel 4.1. Hasil Input dari daun

No

Input

x1 x2

1 0 0

2 0 0

3 0 1

4 0 1

5 1 0

6 1 0

7 0 1

8 0 1

9 0 0

10 0 0

11 0 0

12 0 1

13 1 1

14 0 0

15 0 0

16 0 0

17 0 0

18 1 0

19 0 1

20 0 0

21 1 1

22 1 0

23 0 0

24 0 0

25 0 0

26 0 0

27 0 0

28 0 0

29 0 0

31 1 1

32 0 0

33 0 0

34 0 0

35 0 0

36 0 0

37 0 0

38 0 0

39 0 0

40 1 1

41 1 0

42 1 1

43 0 1

44 0 1

45 1 1

46 1 1

47 0 1

48 0 1

49 0 1

50 1 0

Tabel 4.2. Hasil target menggunakan operasi OR dari input

No

Input Target (t)

x1 x2 x1 OR x2

1 0 0 0

2 0 0 0

3 0 1 1

4 0 1 1

5 1 0 1

6 1 0 1

7 0 1 1

8 0 1 1

9 0 0 0

10 0 0 0

11 0 0 0

12 0 1 1

13 1 1 1

14 0 0 0

15 0 0 0

16 0 0 0

17 0 0 0

18 1 0 1

19 0 1 1

20 0 0 0

21 1 1 1

22 1 0 1

23 0 0 0

24 0 0 0

25 0 0 0

26 0 0 0

27 0 0 0

28 0 0 0

29 0 0 0

30 1 1 1

31 1 1 1

33 0 0 0

34 0 0 0

35 0 0 0

36 0 0 0

37 0 0 0

38 0 0 0

39 0 0 0

40 1 1 1

41 1 0 1

42 1 1 1

43 0 1 1

44 0 1 1

45 1 1 1

46 1 1 1

47 0 1 1

48 0 1 1

49 0 1 1

50 1 0 1

4.2 Pelatihan (Training) Perceptron Pada Daun

Setelah proses ekstraksi fitur dari daun dilakukan, dan telah didapat inisialisasi 2 input (x1 dan x2) dengan 1 target (t), maka tahap selanjutnya adalah melakukan

training pada daun. Set nilai acak, dengan nilai threshold θ=0,5. Learning rate yang digunakan adalah α=0,2. Bobot awal yang dipilih w1=0,1 dan w2=0,1.

Gambar 4.7. Tampilan form training Perceptron

Pada epoh pertama: Data ke-1:

x11= 0; x21=0; t1

Bobot awal, w =0

1= 0,1 dan w2

Hasil aktivasi : a

=0,1

11= x11w1+x21w2

Output : y

=0*0,1+0*0,1=0

11= 0, karena a11

Nilai error : δ

=0≤0,5

11= t1-y11

Bobot akhir:

=0-0=0

w1= w1+α*x11* δ11

w

=0,1+0,2*0*0=0,1

2= w2+α*x21* δ11

Nilai bobot akhir ini akan menjadi nilai bobot awal pada data ke-2. =0,1+0,2*0*0=0,1

Data ke-2: x12= 0; x22=0; t2

w

=0

1= 0,1 dan w2

a

=0,1

12= x12w1+x22w2

y

=0*0,1+1*0,1=0

δ12= t2-y12

w

=0-0=0

1= w1+α*x12* δ12

w

=0,1+0,2*0*0=0,1

2= w2+α*x22* δ12=0,1+0,2*1*1=0,1

Data ke-3: x13= 0; x23=1; t3

w

=1

1=0,1 dan w2

a

=0,1

13= x13w1+x23w2

y

=0*0,1+1*0,1=0,1

13=0, karena a13

δ

=0,1≤0,5

13= t3-y13

w

=1-0=1

1= w1+α*x13* δ13

w

=0,1+0,2*0*1=0,1

2= w2+α*x23* δ13=0,1+0,2*1*1=0,3

Demikian seterusnya sampai Data ke-50. Training pada daun jarak di atas, untuk Epoh pertama masih didapatkan nilai error=6. Maka training akan dilanjutkan pada epoh kedua:

Pada Epoh kedua: Data ke-1:

x11=0; x12=0; t1

w

=0

1=0,7 dan w2

a

=0,7

21=x11w1+x12w2

y

=0*0,7+0*0,7=0

21=0, karena a21

δ

=0≤0,5

21=t1-y21

w

=0-0=0

1=w1+α*x11* δ21

w

=0,7+0,2*0*0=0,7

2=w2+α*x12* δ21=0,7+0,2*0*0=0,7

Tabel 4.3. Hasil pembelajaran perceptron sampai Epoh ke-2

Epoh Data ke-

Input Target Bobot 1

a y error

Bobot 2

x1 x2 t w1 w2 w1 w2

Epoh Ke 1

1 0 0 0 0,1 0,1 0 0 0 0,1 0,1

2 0 0 0 0,1 0,1 0 0 0 0,1 0,1

3 0 1 1 0,1 0,1 0,1 0 1 0,1 0,3

4 0 1 1 0,1 0,3 0,3 0 1 0,1 0,5

5 1 0 1 0,1 0,5 0,1 0 1 0,3 0,5

6 1 0 1 0,3 0,5 0,3 0 1 0,5 0,5

7 0 1