LAPORAN KEMAJUAN

PENELITIAN UNGGULAN ITS

DANA ITS 2020

Pengembangan Model Traveling Salesman Problem & Vehicle Routing

Problem dan Algoritma Generik Berbasis Hyper-heuristics Untuk

Menyelesaikan Permasalahan Optimasi Operasi dan Penjadwalan Public

Transport di Kota Surabaya dalam Kerangka Kerja Intelligent Transport

Systems

Tim Peneliti :

Ahmad Muklason, S.Kom., M.Sc., Ph.D. (Departemen Sistem Informasi/FT-EIC/ITS)

Dra. Nuri Wahyuningsih, M.Kes. (Departemen Sains Aktuaria/FSAD/ITS)

Raras Tyasnurita, S.Kom., M.BA, Ph.D. (Departemen Sistem Informasi/FT-EIC/ITS)

Retno Aulia Vinarti, S.Kom., M.Kom, Ph.D. (Departemen Sistem Informasi/FT-EIC/ITS)

DIREKTORAT RISET DAN PENGABDIAN KEPADA MASYARAKAT

Daftar Isi

Contents

Daftar Isi ... i

Daftar Tabel ... ii

Daftar Gambar ... iv

Daftar Lampiran ... v

BAB I RINGKASAN ... 1

BAB II HASIL PENELITIAN ... 2

BAB VI HASIL DAN PEMBAHASAN ... 2

4.1

Data Uji Coba ... 2

4.2

Lingkungan Uji Coba ... 2

4.3

Hasil Solusi Awal... 3

4.4 Hasil Uji Coba Algoritma Artificial Bee Colony ... 11

4.4.1. Uji Coba Parameter Limit ... 12

4.4.2. Uji Coba Parameter FoodSource ... 13

4.4.2. Uji Coba Jumlah Iterasi ... 15

4.4.3. Uji Coba Low Level Heuristik ... 16

4.4.3. Hasil Solusi Akhir ... 17

4.5

Performa Algoritma Artificial Bee Colony ... 26

4.5.1 Perbandingan dengan Solusi Awal

... 26

4.5.2 Perbandingan dengan Algoritma Nearest Neighbour ... 27

4.5.3 Perbandingan dengan Algoritma Genetik ... 28

4.5.4 Perbandingan dengan Algoritma Simulated Annealing ... 31

BAB III STATUS LUARAN ... 36

BAB IV KENDALA PELAKSANAAN PENELITIAN ... 38

BAB V RENCANA TAHAPAN SELANJUTNYA ... 39

BAB VI DAFTAR PUSTAKA ... 40

BAB VII LAMPIRAN ... 41

Tabel 4.1 Spesifikasi Perangkat Keras ... 2

Tabel 4.2 Spesifikasi Perangkat Lunak ... 2

Tabel 3 Status Luaran ... 36

BAB I RINGKASAN

Kemacetan lalu lintas adalah masalah umum di kota-kota besar di seluruh kota besar. Selain dengan

penyediaan moda transportasi masal yang bagus, untuk mengatasi masalah kemacetan diperlukan

sistem manajemen transportasi yang bagus juga. Penelitian ini bertujuan untuk mengembangkan

model Traveling Salesman Problem (TSP) dan Vehicle Routing Problem (VRP) untuk memodelkan

permasalahan manajemen transportasi di kota Surabaya, khususnya yang berkaitan dengan optimasi

operasional dan penjadwalan moda transportasi umum masal terintegrasi yang direncanakan akan

dibangun di kota Surabaya. Selain pembuatan model, untuk menyelesaiakan model permasalahan,

dalam penelitian ini akan diusulkan algoritma generik dengan menggunakan pendekatan

hyper-heuristics. Dari sisi keilmuwan, kontribusi ilmiah yang diharapkan dari penelitian ini adalah

diperolehnya data set dan pengembangan model baru untuk TSP dan VRP yang telah dibuktikan

sebagai permasalahan yang Non-deterministic Polynomial (NP), i.e. NP-hard, dimana belum

diketahui adanya algoritma esak yang mempu menyelesaikan dalam waktu polynomial. Data set

dan model baru ini diharapkan dapat mendorong penelitian algoritma lebih lanjut oleh peneliti

lainya khususnya di bidang kecerdasan buatan dan riset operasi. Dari sisi manfaat praktis, luaran

dari penelitian ini diharapkan dapat menghasilkan piranti lunak cerdas yang dapat membantu dalam

manajemen transportasi masal terintegrasi dalam kerangka kerja Intelligent Transport System (ITS)

di kota-kota besar di Indonesia, khususnya di kota Surabaya.

Kata Kunci: Traveling Salesman Problem, Vehicle Routing Problem, Intelligent Transport

System, Hyper-heuristics

Ringkasan penelitian berisi latar belakang penelitian,tujuan dan tahapan metode

penelitian, luaran yang ditargetkan, kata kunci

BAB II HASIL PENELITIAN

BAB VI

HASIL DAN PEMBAHASAN

Pada bab ini akan menjelaskan mengenai hasil uji coba dan analisis terhadap hasil solusi yang

diperoleh dari implementasi Algoritma ABC dan perbandingannya dengan beberapa algoritma

lain seperti NN, GA dan SA.

4.1 Data Uji Coba

Data yang digunakan sebagai uji coba adalah dataset TSP dari Traveling Salesman Competition

(TSC) 2.0 yang digunakan langsung dalam penelitian tugas ini.

4.2 Lingkungan Uji Coba

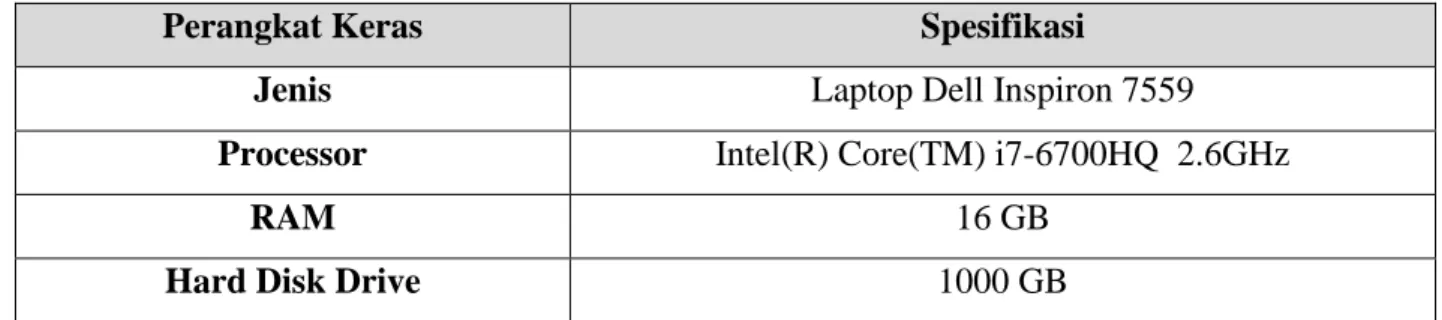

Pada subbab Lingkungan Uji Coba ini akan menjelaskan terkait lingkungan pengujian dalam

melakukan implementasi penelitian terkait optimasi rute rencana perjalanan dengan pesawat pada

studi kasus TSC 2.0. Spesifikasi perangkat keras yang digunakan dalam implementasi ditunjukkan

pada Tabel 4.1.

Tabel 4.1 Spesifikasi Perangkat Keras

Perangkat Keras

Spesifikasi

Jenis

Laptop Dell Inspiron 7559

Processor

Intel(R) Core(TM) i7-6700HQ 2.6GHz

RAM

16 GB

Hard Disk Drive

1000 GB

Untuk spesifikasi perangkat lunak yang digunakan dalam pengerjaan penelitian ini ditunjukkan

pada Tabel 4.2.

Tabel 4.2 Spesifikasi Perangkat Lunak

Perangkat Lunak

Fungsi

Windows 10 64 bit

Sistem Operasi

Netbeans 8.2

Implementasi Algoritma

Microsoft Excel 2016

Pengolahan Hasil Uji Coba

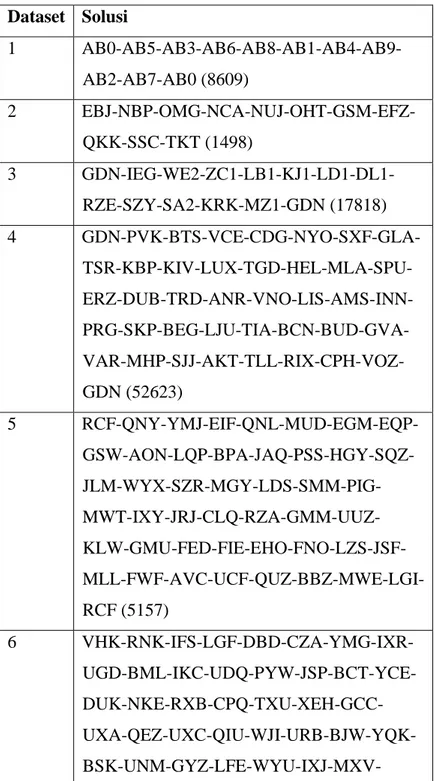

4.3 Hasil Solusi Awal

Pembuatan solusi awal dilakukan dengan cara menentukan secara acak urutan tur kota dari daftar

kota yang telah dilakukan seleksi sebelumnya. Jika ditemukan solusi yang tidak layak maka

urutan kota akan kembali diacak hingga ditemukan solusi yang layak. Tabel 4.3 menunjukan

solusi yang dihasilkan pada solusi awal beserta biaya yang dibutuhkan.

Tabel 4.3 Hasil Solusi Awal

Dataset Solusi

1

AB0-AB5-AB3-AB6-AB8-AB1-AB4-AB9-AB2-AB7-AB0 (8609)

2

EBJ-NBP-OMG-NCA-NUJ-OHT-GSM-EFZ-QKK-SSC-TKT (1498)

3

GDN-IEG-WE2-ZC1-LB1-KJ1-LD1-DL1-RZE-SZY-SA2-KRK-MZ1-GDN (17818)

4

GDN-PVK-BTS-VCE-CDG-NYO-SXF-GLA-

TSR-KBP-KIV-LUX-TGD-HEL-MLA-SPU-

ERZ-DUB-TRD-ANR-VNO-LIS-AMS-INN-

PRG-SKP-BEG-LJU-TIA-BCN-BUD-GVA-

VAR-MHP-SJJ-AKT-TLL-RIX-CPH-VOZ-GDN (52623)

5

RCF-QNY-YMJ-EIF-QNL-MUD-EGM-EQP-

GSW-AON-LQP-BPA-JAQ-PSS-HGY-SQZ-

JLM-WYX-SZR-MGY-LDS-SMM-PIG-

MWT-IXY-JRJ-CLQ-RZA-GMM-UUZ-

KLW-GMU-FED-FIE-EHO-FNO-LZS-JSF-

MLL-FWF-AVC-UCF-QUZ-BBZ-MWE-LGI-RCF (5157)

6

VHK-RNK-IFS-LGF-DBD-CZA-YMG-IXR-

UGD-BML-IKC-UDQ-PYW-JSP-BCT-YCE-

DUK-NKE-RXB-CPQ-TXU-XEH-GCC-Dataset Solusi

WBF-HPO-CJF-CTQ-UAX-ZML-QLA-ZVF-

NOZ-RSE-TPR-EFU-ZZY-PFG-UWL-BYT-

EUV-PJI-AFF-MUF-KIS-LNP-IXQ-IWR-

UHR-EXJ-VTQ-DQJ-KKE-ASN-LWM-NTJ-

UYZ-QXW-AJK-BHK-FPD-CCR-SAN-IEI-

OTN-CUV-XSR-RLV-AWR-RNS-FVJ-YHH-

UDY-LTN-CWC-WTV-VDG-YUT-ZVP-VKQ-GCX-LDS-VHK (12625)

7

AHG-FAY-FFF-GWN-FWO-COH-GUT-

DVS-FKV-GAR-DAU-DIZ-BBW-HFU-FDV-

EIH-BPW-EFY-BTY-GSL-DNK-EPQ-DDV-

HCP-BSP-BZT-ECE-CTU-BHB-BXV-CWC-

DWI-ETU-DKV-HAP-DIB-ERX-FCD-FOS-

ARO-AMR-BAQ-AZS-BKI-FRJ-BNK-GMM-

BWF-GRU-FIO-FJO-FRW-DPO-DHV-CRI-

HAF-BUF-BAJ-FJA-DER-BZH-FOE-FXP-

FHS-BRF-DSM-FMZ-EZG-ATB-AEN-AKZ-

GWJ-ALX-ALM-DUH-IVN-IDG-NIZ-JGW-

KLS-INT-HWB-KXF-KON-MYY-IBM-JHC-

MDX-IRN-HUV-MGM-MQY-JBB-JOQ-

JOO-IOM-IRE-HMD-KXI-LHG-KKA-LID-

JUZ-JQD-HID-LBK-IIH-LPA-KMH-MCH-

LUI-KPR-NFB-LSE-LYI-ITE-HXU-JWN-

MOR-KYK-MRT-LAL-HTJ-LIR-JLI-NCU-

MAS-LAA-HFX-KXN-MIJ-HRV-HVV-JUG-

MLJ-KXM-LZD-ICN-HGD-LJA-NFL-HON-

IWU-KLO-MED-JMP-NAD-MAZ-MON-LOU-AHG (89234)

8

AEW-HIX-QZU-WLL-ZZP-VNJ-WFU-ANZ-

WKK-MYZ-RUP-RLE-WPH-DSR-VVA-

GSC-VZK-WCD-BIN-YED-AOY-RLT-QHR-

INI-IVF-OPC-CUU-VFT-VXE-JZU-UJW-Dataset Solusi

JRX-RWM-EQV-PAV-TKC-GPI-JSR-AUJ-

BZR-PFI-VDU-RYJ-ETH-DWQ-RHQ-LAZ-

JQI-ASF-URK-DDZ-XMD-VDQ-LTI-ULD-

XGM-IHK-ECS-IID-IDB-LRL-JJY-NBR-

FWA-CJM-RJM-RRT-JIM-JBJ-JAH-KBN-

EHZ-JCY-TBS-CLA-XRW-NOR-BFZ-ZNG-

SED-LNC-GRH-LTF-XSY-PUW-DCY-XSF-

BJG-TQN-JRT-FGF-PRO-IUN-HMM-EBK-

XLT-UYS-MVV-EOG-OAE-CKW-AUO-

SXJ-CZJ-BCU-NVV-ROM-IPE-FYA-RAA-

WUL-PEU-BYB-MSW-ZNF-FMC-NZN-

PUG-QRL-PJS-LII-ZCX-EGV-WRL-CAA-

GKF-BGU-FCP-JBS-IYZ-OBE-DSN-HIN-

ILI-TRJ-AFH-NPF-JHO-BQL-EBY-MYR-

DNZ-DCB-EOW-KIC-BNL-FCJ-PDI-HTD-

LRU-QMS-MMN-JFU-AME-OOM-OTQ-

NRS-BAB-ALA-HNP-RWO-JQL-CHK-OVC-

JKB-MAE-OLQ-BKB-IHD-PCD-LKE-CGR-

OXH-HPZ-RAR-PNH-GHI-DRO-AKF-FAO-

EXV-LTP-KIW-BMD-QBR-PEP-BLJ-PDY-

QXU-MFT-PFU-FKP-NPT-MRE-OVD-EOB-EBC-BPY-DVQ-CSW-AEW (17434)

9

GVT-PFD-CPU-IQC-NRL-DLZ-AXR-FTC-

URP-IUH-PSE-WSO-KKO-DJT-MRH-JXA-

XXF-VMN-VIW-PWO-IMC-RGA-IUU-IRH-

WWJ-WSD-QGZ-AWV-KXR-KLB-SOX-

EYQ-DHJ-TQQ-OQL-RUK-XSQ-YRN-JDF-

QTU-PYJ-BSZ-YEK-OBM-LVV-NJX-BBM-

BNC-SEW-PSG-BLW-IZD-JNF-UHQ-DPL-

MZN-TKY-FNL-YSI-ODA-SPU-EGT-AEY-Dataset Solusi

JQS-WAZ-IML-IAM-FMI-ZID-MUL-NRE-

YDX-GER-YKY-LHE-ZHS-VEH-BQX-

OXU-JPK-KUL-WTB-LMK-SPH-SIY-ZEA-

MRO-ZUV-AHR-PSS-SZE-HPH-QJV-LOC-

WQP-AHC-TMZ-UZF-EYO-MVE-XXJ-EUJ-

DQF-LDA-XIW-FNQ-NDJ-UCN-CYU-QRP-

TSX-WMZ-NVG-ZWM-HHM-LSE-LSC-

ZNU-XPE-ALC-SWH-RDM-LBR-JVS-NTM-

XGD-ZLZ-NMF-VCI-GRI-PCH-TMW-FWU-

GPH-HAQ-VWB-UHZ-TXQ-ZZO-JAK-

OXE-UOY-UZH-UCQ-HAC-REH-VIQ-

MLK-BXV-TVP-XMH-IJS-JOF-PZZ-UDV-

IFZ-PAM-XIG-AEH-ERN-VVL-RBN-PQM-

XEJ-VSK-VAK-JXV-LUA-BYN-QNV-AXO-

NGB-HVC-HJJ-CEA-CAB-YQL-VGR-JLO-

NUO-RZK-DHD-XNA-PUN-RGB-MGK-JPI-

SGB-ZTN-JAV-JIV-JBA-BUC-MPH-OKB-

QNA-XOS-EJK-GSQ-AOL-UEI-PTC-BCI-

OLW-KKQ-STB-NZQ-RZB-QBQ-HDY-

RPW-JJD-FAK-RSX-EAG-JLS-ICU-NJH-

TAE-VLS-UCR-QBZ-BRA-VDX-HVP-HSZ-

JSU-VLV-VUC-JUJ-LJS-BRC-UMH-CAK-GVT

(290733)

10

ECB-OGF-FGT-DSH-SVY-JAP-EVX-UZO-

IFL-AAB-CUQ-JRK-DRM-NAP-RQS-QYW-

EWE-ZRU-THY-URM-LRY-OQY-SRK-IPX-

PWL-STD-LKC-MTV-EAK-NLU-JTU-ICJ-

IYX-DRK-LNF-PGR-XXY-BHJ-IVY-KPX-

MHI-OJE-SIV-XUA-YEO-XGY-SVT-KAM-

FSJ-ABP-JGZ-TUJ-ZDE-OEU-APJ-IWD-

LRJ-ZEV-TBG-NMV-AJI-EGP-TPR-DEN-Dataset Solusi

XJE-TRO-RYW-LBS-INX-FCD-FAB-MOM-

THP-CJU-GSW-XWU-ZVN-NVJ-KLG-SHI-

YOO-NWT-PZG-TGN-TNQ-URW-TIP-CSH-

BHR-SPH-FCV-BFP-EMG-GCP-CHH-ZZW-

VRY-WMZ-CHW-AKB-SCB-AGL-DSZ-

LTS-KNJ-UUG-BKB-YWI-UXZ-KFW-VBB-

DLU-ERR-AXT-QQA-FJQ-QPO-JKP-MFH-

VJP-LNS-SNZ-ETP-RAX-IUM-UPC-HMD-

YQZ-ISW-OLW-EVC-VON-URG-TIK-BCB-

ZJA-AQG-RFP-XGF-UYA-RXJ-ZAZ-CQJ-

ESC-EXW-GEH-IUK-LFN-RFS-JZK-ZUN-

JEH-CNB-KJC-NPL-BSS-JVK-BOT-LTO-

URO-KXM-LXL-CZK-NRS-GER-OQV-

HLC-DTO-GFW-YPU-AIN-VWD-CSW-

LMG-EJV-WCD-RVW-GLQ-JQC-TFG-

KCX-VKI-BUF-BQK-EBZ-NPJ-XPD-AYM-

ODK-VEE-VJR-HFK-ZCY-EIN-NTI-OTR-

PDB-OQC-NPM-LMY-KWU-EOL-UIA-

ASE-JCY-RMN-AHQ-BNO-BTQ-UZM-

KWE-IJZ-UJN-KCM-EDC-RWT-WRM-

XCA-GLV-QDZ-ZZZ-SPA-XFD-EPP-SLM-

UKX-FZB-OXB-YEC-IIK-YRB-DDD-JGU-

HZM-BOU-YMC-NHG-YJV-CCB-FJI-TKS-

KXQ-BHN-FXQ-EXJ-JDU-KNS-ZIS-WNB-

PHT-ACC-OLV-UYZ-QHU-AQO-HTF-

WFD-VUW-UVD-YME-QLI-GFY-YHM-

DEU-GFO-XOV-ICO-HDZ-WTU-QVC-

KOR-XRB-YOV-DDL-WGN-ZSZ-LME-ZIU-

QNP-YMJ-GJZ-VQC-LOR-STM-MRZ-ZXF-

LEL-QYH-MFM-SZR-ZBE-YMX-HFW-JIE-Dataset Solusi

11

LIJ-FOG-QWO-LVG-NUJ-EHR-ZQV-HLV-

UYV-MGY-FKW-NJQ-TSY-NOP-TNZ-YFT-

MYB-QZQ-JWL-KHM-YKW-PNA-HMT-

FWB-OIU-UJA-IZX-CPP-LMS-FIT-AEB-

WAC-FKQ-GAB-BEJ-SZD-HIE-THB-NMK-

LIR-JTA-XEX-JCP-OFQ-CJM-IWT-ZHV-

QAL-DIW-VRO-JOY-NTW-MBV-YYU-

NGN-LTQ-RMH-NRY-LRM-GAM-CUM-

OGM-LUF-RYP-MRN-KPI-FTD-JBN-HCI-

UHG-YLW-EOW-DGR-KYX-TXN-ZKG-

VYA-CAW-TTY-KRL-JNL-OYX-NQM-

HJQ-BXF-CIB-CHM-PTG-JFR-SRK-TAH-

NKW-LRU-JMS-ELA-VYK-AUD-ZTL-

QRB-TBR-BKY-NPJ-QSA-BPL-LGM-FTW-

DEE-VXG-IUM-BKR-MBQ-WHV-EKP-

QDL-EGG-IKX-CQT-QEX-KYF-KIB-NTG-

NFQ-DJI-RIK-CXO-EDC-DTD-MFB-IGC-

SVT-CLS-LQH-XBL-EIV-LOM-KIP-MWP-

PHY-NDU-LSW-PKP-SXJ-GGK-DPA-BLH-JZN-QDG-SPS-BUC-PND-LIJ (94610)

12

PJE-YMP-ABC-DFY-NIK-SKJ-AVL-OLX-

MYC-GPQ-XIA-NCM-KPQ-UMJ-NUU-

LNP-BCC-TZF-ADH-TPT-OYK-GUI-FDO-

NXV-TOT-PLU-LRD-MQY-NPB-XGF-GHP-

RRM-XPW-RNM-MKS-ULP-GDP-KWC-

KBN-MPH-RFV-FQA-KGS-CDF-QNT-

MTH-YRE-RLV-CNF-RWG-HKN-HZT-JTJ-

SUN-JCH-GRI-ODY-QRB-QIP-OXT-FNT-

WVR-HBC-KQX-YBA-BFK-GOF-WMT-

WQT-IHU-OWP-NTP-UBM-FLG-HUU-JOY-

ARK-FWL-ZHE-HPQ-SKB-PJV-JTO-VRQ-

TLJ-MYZ-MNJ-OQD-JLG-NZM-FSR-LKD-Dataset Solusi

CZB-OUH-LEX-KYY-TAR-DKL-QPQ-YRT-

FXQ-RHH-ZLQ-VKQ-LVK-NIU-KLC-IWJ-

JEQ-OHN-BAP-AXD-BPA-NSB-SBF-XZK-

RDI-OZM-ISX-SFS-WGV-LNJ-KNP-MXX-

NFZ-XPH-JJR-DUF-NXG-VNU-PFI-SWO-

MFA-VSR-GYD-AVW-MXC-UHU-KEF-

MCD-BQP-JPR-OAM-QTI-EFD-ILA-HQT-

HER-XJI-DMM-SCI-DID-LTM-LZB-JOK-

AWL-MUP-ZNO-NVC-HQK-SXO-AEF-

OMN-GJY-GYX-FBT-RAG-TBX-MIS-BPT-

IWP-EDL-CKH-JOX-EZN-SDL-TTB-NHH-

DUV-FKK-GQE-PIL-HJC-FDM-GSF-UTP-

EKV-ISQ-RCF-MWL-NSX-ASV-NEJ-KSN-OPN-KIB-DFV-IGO-KFV-EVS-PJE (147314)

13

GKU-KZA-YWT-GXK-YTF-LQC-BDZ-

DCO-YNN-UDG-UHC-THJ-IZY-TGW-

KQA-TLG-RVW-DLH-ITH-ZPU-LLY-EMY-

HFS-OEE-UTM-OXW-TVO-SQP-OCL-SEF-

RXQ-BYN-IZA-IUF-IKD-FFA-XMH-LGT-

GOH-WPW-AVW-WJL-NTW-PLE-AMW-

YXE-DAH-AOJ-DIY-BEB-ONM-CFT-SAN-

MGJ-FIO-ACC-VMY-AWP-TDN-PLK-DFV-

KFW-BYM-UXF-IZT-WPR-OEH-WHN-

SAU-SOL-RZM-ZIB-IQS-SBY-WDX-VMW-

VZY-PNF-WBE-QUE-TBP-TPX-XMX-

NUY-VCP-SHN-NOI-EPN-PYX-MOE-RFW-

DOO-GRX-UOW-GDN-SRS-RZS-FSI-EUV-

OOK-HIA-GSM-PEF-FFX-IUB-SYL-UKA-

CJZ-XME-WOS-INI-CSO-YWL-HGS-BQF-

YGY-MYF-GKJ-PEG-FCA-PUT-UOU-OFL-Dataset Solusi

YWH-QRD-CTG-NEO-LXH-PGC-OTS-SXE-

JCC-OGV-BSH-UQP-BMD-IVS-SHH-VKU-

EPV-LIS-AON-AHQ-NYB-DUX-BJT-JCJ-

GAR-TIP-NLU-SSF-TWD-KSY-KPN-RYO-

WTP-AHE-OUQ-TUU-NYM-NZH-GSI-

GCB-NCV-ACA-AEL-NLW-HTM-CYT-

KKI-BZR-LWI-YSL-VEZ-CZD-DLP-GLT-

AAM-LCQ-UQD-DSJ-LZQ-GCK-FPL-JBZ-

WZA-RYT-SIQ-TGS-VZT-CKA-VLA-OEG-

FMJ-CKZ-VPY-SQK-RUA-KKY-DYS-DJY-

TNL-IHK-OAB-LZZ-VSE-IOA-XRE-EWE-

LZM-MPZ-SWU-DCH-GJX-OIR-AVF-XJS-

NSG-GMA-XNA-LEB-AQC-RJJ-UAW-GQJ-

UPM-SNU-FTZ-WOZ-AUF-POB-VOV-UFC-QNF-GKU (184021)

14

IXG-OXF-JFR-VZA-LYR-RDO-EPH-ZLA-

RZZ-APY-CFT-QQE-WUC-LKS-FPG-KQO-

HDB-BFF-HOH-PMQ-HHR-KII-IZC-MER-

SRE-SOM-FMC-MXN-IMH-SYY-XGR-JRF-

UIE-NXW-RTP-KDT-NHX-ONX-KPC-OEX-

CNY-QCY-IJJ-PGB-OYJ-IES-FGX-GUO-

KBC-WEC-GSD-SJO-XIH-CDN-EAJ-HKP-

RGA-SRB-JOK-VRH-QLD-FDC-OXB-QTS-

TOG-PNS-ZPD-JPW-ZGD-QQM-NWX-

BAH-HKT-MWZ-SSN-IKW-IFX-NZZ-SZB-

ZIT-AZZ-HIM-ZAH-QYJ-ZPQ-RUR-NNS-

MMT-FLC-FIC-ZOS-VMZ-PAB-WCQ-DMI-

ZZV-RLF-AGQ-ZTD-IAV-GZG-NNJ-PPL-

ZBA-WCY-OGN-WEN-QVV-CKL-NVF-

EKB-IPC-ILP-DZU-QPR-QNQ-FON-FXG-

HYF-MMR-NGK-BRR-VMP-KJN-XDP-

DRK-YZU-WLK-TIL-MXD-DYS-DLU-JTI-Dataset Solusi

FGK-YDC-XDS-EBK-PSK-PMI-WZV-EDF-

UVX-GCZ-QEM-EJY-SJH-QTT-ZYZ-TKN-

YAH-YBJ-FSO-ODX-HHA-TNR-IJS-NAW-

DQK-ZHK-OUO-GXR-QSS-KXT-SDF-EXL-

LWD-AOB-LMA-WNQ-JSE-OOW-QSX-

MFF-JVE-OXU-XJK-CEA-UFE-PTG-CCK-

TPF-EVD-XZU-BCJ-UPE-JNH-YDZ-HLT-

AAL-VQA-EXG-XJQ-JWW-AAJ-THL-IZW-

JAK-EWQ-RUB-MIZ-JSN-END-FQX-USH-

QHL-JRO-JEI-SJX-ORA-ZTM-AUQ-KXF-

KUA-DBP-AZP-MYJ-HFT-ITG-MCB-YAF-

LXM-CWL-GZZ-IER-BNB-YLV-LCC-RLV-

OST-HVE-UDG-FES-DWY-EVS-IVF-PZF-

SIQ-IBE-GIU-KEU-ZUJ-SGD-DEI-NRF-

OON-OYM-FSE-TKP-EWS-DOB-BOW-

OQQ-GIT-PQK-SWR-VRY-JTW-DUB-DAX-

FBV-OFE-HXK-QJO-SLF-MCY-FKP-YHQ-

HXV-CEF-JDF-PWL-VTF-QID-XMU-TVT-

CFH-JKA-RDM-GTW-WBK-ZAW-MQW-

JQA-SVV-ULV-YFC-AOL-WGF-XTR-AKF-

BPO-KEV-PXB-IPU-EKJ-MTA-GAL-OUL-HMF-GQV-IXG (230839)

4.4 Hasil Uji Coba Algoritma Artificial Bee Colony

Algoritma ABC digunakan untuk mengoptimasi solusi dari solusi awal yang telah dihasilkan.

Terdapat tiga parameter yang akan berpengaruh pada solusi akhir yaitu parameter limit,

foodSource dan jumlah iterasi yang akan dilakukan.

Untuk menghasilkan solusi yang lebih baik maka dilakukan pencarian nilai parameter yang

optimal dengan melakukan beberapa uji coba terhadap dataset 1, 6, 11 dan 14. Dataset tersebut

dipilih karena dataset tersebut mewakili karakter dari beberapa dataset lainnya.

Nilai parameter yang akan digunakan berdasarkan pada percobaan yang dilakukan oleh penulis

sebelumnya. Percobaan dilakukan dengan memulai dari nilai parameter terkecil. Setelah itu nilai

parameter akan dikali dua atau tiga kali lipat dan dibandingkan hasilnya.

Hal tersebut akan dilakukan terus menerus sampai ditemukan nilai parameter yang mendekati

nilai terbaik.

Hasil dari percobaan tersebut menghasilkan nilai parameter limit 5000, foodSource 8 dan jumlah

iterasi 500.000.000. Angka ini akan menjadi dasar pada uji coba parameter berikutnya.

Dari hasil nilai parameter diatas dataset 1 selalu menghasilkan hasil yang paling optimal, sehingga

dataset 1 tidak akan digunakan untuk uji coba berikutnya.

Ujicoba akan dilakukan sebelas kali pada setiap dataset. Hasil akhir akan diambil dari nilai

terbaik yang didapatkan dalam pengujian ini.

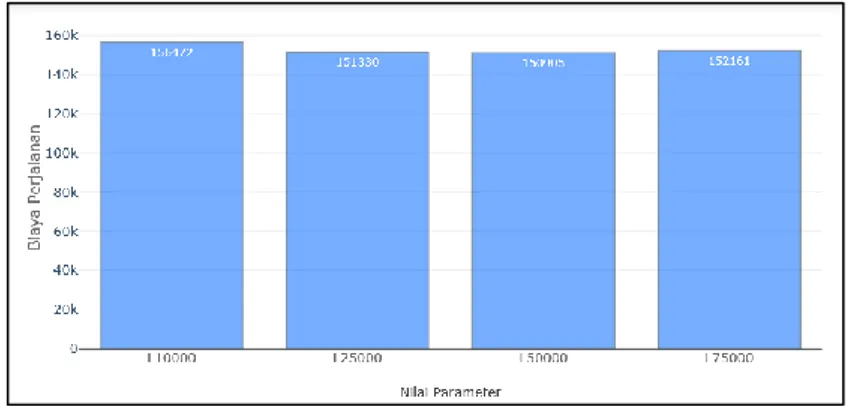

4.4.1. Uji Coba Parameter Limit

Pada uji coba ini dilakukan percobaan dengan menguji parameter limit dengan nilai 10000, 25000,

50000 dan 75000. Nilai limit yang terlalu kecil menyebabkan terlalu seringnya masuk ke tahapan

scout bee yang menyebakan akan menghasilkan solusi yang buruk. Terlalu besar nilai limit akan

menyembakan jarangnya terjadi tahapan scout bee yang menghasilkan kurangnya eksplorasi

terhadap solusi [17].

Pada dataset 6, nilai 10000 menghasilkan solusi yang lebih baik daripada ketiga nilai parameter

lainnya. Selengkapnya dapat dilihat pada gambar 4.1.

Gambar 4.1 Uji Coba Parameter Limit pada Dataset 6

Pada dataset 11, nilai 25000 menghasilkan solusi yang lebih baik daripada ketiga nilai parameter

lainnya. Selengkapnya dapat dilihat pada gambar 4.2.

Pada dataset 14, nilai parameter 50000 menghasilkan solusi yang lebih baik daripada ketiga nilai

parameter lainnya. Selengkapnya dapat dilihat pada gambar 4.3.

Dari ketiga hasil uji coba diatas, nilai parameter 25000 akan digunakan untuk menghasilkan nilai

solusi akhir karena menghasilkan hasil yang lebih baik secara keseluruhan.

Gambar 4.2 Uji Coba Parameter Limit pada Dataset 11

Gambar 4.3 Uji Coba Parameter Limit pada Dataset 14

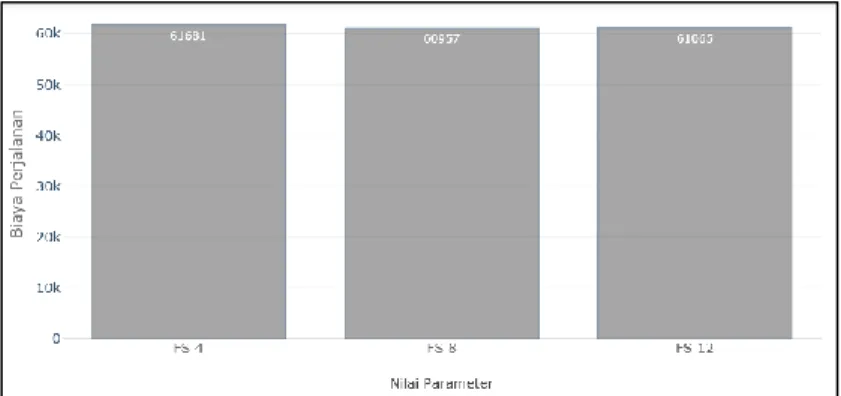

4.4.2. Uji Coba Parameter FoodSource

Pada uji coba ini dilakukan percobaan dengan menguji parameter foodsource dengan nilai 4, 8 dan

12. Sebenarnya parameter ini tidak terlalu perlu untuk cari nilai terbaiknya, karena algoritma ABC

mampu menjaga kualitas solusinya diberbagai nilai foodSource [17].

Pada dataset 6, nilai parameter 12 menghasilkan hasil yang lebih baik. Selengkapnya dapat dilihat

pada gambar 4.4.

Gambar 4.4 Uji Coba Parameter FoodSource pada Dataset 6

Pada dataset 11, nilai parameter 8 menghasilkan hasil yang lebih baik dari dua nilai lainnya.

Selengkapnya dapat dilihat pada gambar 4.5.

Gambar 4.5 Uji Coba Parameter FoodSource pada Dataset 11

Pada dataset 14, nilai parameter 12 menghasilkan solusi yang lebih baik daripada kedua nilai

parameter lainnya. Selengkapnya dapat dilihat pada gambar 4.4.

Gambar 4.6 Uji Coba Parameter FoodSource pada Dataset 14

Dari hasil uji coba ini, nilai 12 menghasilkan nilai yang lebih baik secara keseluruhan. Namun

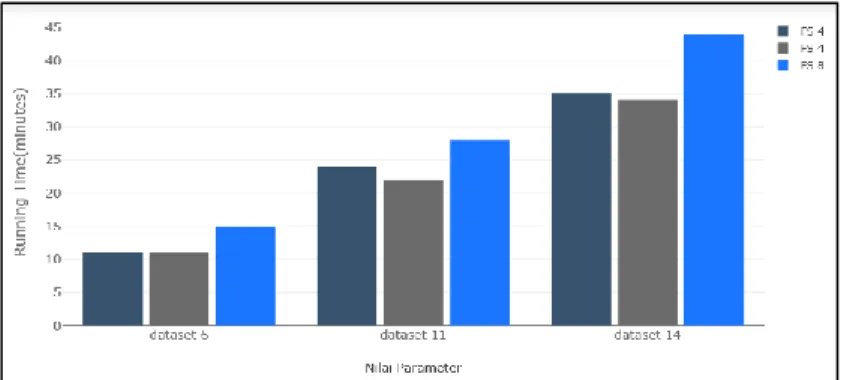

perbedaan antara nilai 4, 8 dan 12 hanya berkisar 1-2%. Jika dilihat dari running time, nilai

parameter 4 menjadi yang terbaik di ketiga dataset. Selengkapnya dapat dilihat pada gamba 4.7.

Berdasarkan pertimbangan running time dan selisih nilai solusinya, maka nilai foodSource 4 akan

digunakan untuk mencari solusi akhir.

Gambar 4.7 Running Time Parameter FoodSource

4.4.2. Uji Coba Jumlah Iterasi

Pada uji coba ini akan menggunakan tiga iterasi yang berbeda yaitu 100.000.000, 250.000.000 dan

500.000.000. Pada dataset 6 jumlah iterasi 500.000.000 menghasilkan solusi yang lebih baik

daripada kedua jumlah iterasi lainnya. Selengkapnya dapat dilihat pada gambar 4.8.

Gambar 4.8 Uji Coba Jumlah Iterasi pada Dataset 6

Pada dataset 11 jumlah iterasi 500.000.000 menghasilkan solusi yang lebih baik daripada kedua

jumlah iterasi parameter lainnya. Selengkapnya dapat dilihat pada gambar 4.9.

Pada dataset 14 jumlah iterasi 500.000.000 menghasilkan solusi yang lebih baik daripada kedua

jumlah iterasi lainnya. Selengkapnya dapat dilihat pada gambar 4.10.

Dari hasil uji coba diatas, jumlah iterasi 500.000.000 menghasilkan solusi yang lebih baik dari

ketiga dataset yang diuji coba. Sehingga jumlah iterasi 500.000.000 akan digunakan dalam

pencarian solusi akhir.

Gambar 4.9 Uji Coba Jumlah Iterasi pada Dataset 11

Gambar 4.10 Uji Coba Jumlah Iterasi pada Dataset 14

4.4.3. Uji Coba Low Level Heuristik

Pada uji coba ini akan menggunakan empat jenis low level heuristic (LLH) yang berbeda yaitu

swap 2 kota, swap 3 kota, swap 4 kota dan kombinasi swap 3 dan 4 kota. LLH swap memiliki

peluang yang lebih besar untuk menghasilkan solusi yang lebih baik dibandingkan move, shuffle

dan crossover karena ada perbedaan biaya dari kota a menuju b setiap harinya.

Pada dataset 6, swap 4 kota menghasilkan solusi yang sedikit lebih baik dari swap 3 kota dan

swap 3 & 4 kota. Selengkapnya dapat dilihat pada gambar 4.11.

Gambar 4.11 Uji Coba LLH pada Dataset 6

Pada dataset 11, swap 3 & 4 kota menghasilkan solusi yang sedikit lebih baik dari swap 3 kota

dan swap 4 kota. Selengkapnya dapat dilihat pada gambar 4.12.

Gambar 4.12 Uji Coba LLH pada Dataset 11

Pada dataset 6, swap 3 kota menghasilkan solusi yang sedikit lebih baik dari swap 4 kota dan

swap 3 & 4 kota. Selengkapnya dapat dilihat pada gambar 4.13.

Gambar 4.13 Uji Coba LLH pada Dataset 14

Pada hasil uji coba ini, swap 3, swap 4 dan swap 3 & 4 kota cukup berimbang. Sedangkan pada

swap 2 kota menghasilkan hasil yang lebih buruk dari 3 LLH lainnya. Perbedaan pada nilai solusi

terkecil dan terbesar dapat diakibatkan perbedaan nilai solusi awal dan penggunaan random,

sehingga pemilihan LLH terbaik akan menggunakan nilai rata-ratanya. Berdasarkan nilai rata-rata,

swap 3 & 4 menghasilkan hasil yang lebih baik sehingga swap 3 & 4 akan digunakan dalam

mencari solusi akhir.

4.4.3. Hasil Solusi Akhir

Setelah menemukan nilai parameter yang tepat lewat percobaan pada subbab sebelumnya, maka

algoritma ABC dijalankan pada seluruh dataset untuk mendapatkan solusi akhir yang hasilnya

dapat dilihat pada tabel 4.4.

Tabel 4.4 Hasil Solusi Akhir

Dataset Solusi

1

AB0-AB7-AB4-AB9-AB1-AB6-AB2-AB8-AB3-AB5-AB0 (1396)

2

EBJ-NBP-OMG-NCA-NUJ-OHT-GSM-EFZ-QKK-SSC-TKT (1498)

3

GDN-OSZ-KJ1-WE1-IEG-WRO-KTW-KRK-RZE-LB1-LD3-WMI-SZY-GDN (8530)

4

GDN-VNO-RIX-TLL-KUO-BLE-OSL-CPH-Dataset Solusi

SOF-IAS-KIV-ODS-ROV-ADF-AKT-ATH-

MLA-TIA-TGD-BEG-BRQ-BUD-KSC-BQT-GDN (16447)

5

RCF-EQP-MGY-BPA-JRJ-RZA-FWF-AON-

LDS-UUZ-CLQ-MWT-FIE-WYX-PSS-JLM-

QNL-IXY-BBZ-GMU-KLW-QNY-GMM-

GSW-JSF-FNO-HGY-YMJ-EGM-LGI-MLL-

AVC-MUD-SMM-FED-QUZ-SQZ-PIG-SZR-JAQ-EIF-EHO-UCF-LQP-LZS-MWE-RCF

(833)

6

VHK-RNK-BCT-LDS-EFU-ZML-GCC-IXJ-

FPD-KIS-CCR-QLA-UWL-URB-IXR-XEH-

FVJ-KKE-PJI-CTQ-QEZ-CUV-WTV-PFG-

UXA-RXB-EUV-VKQ-YHH-AFF-ZZY-

DUK-YMG-IFS-ZVP-ZVF-UNM-NOZ-RNS-

YCE-WBF-LTN-LNP-BYT-ASN-IWR-SAN-

IEI-UYZ-UXC-CPQ-GYZ-TXU-MXV-WJI-

DQJ-HPO-AWR-VTQ-CWC-BSK-BHK-

UDY-IKC-UGD-RSE-LGF-MUF-UHR-NTJ-

TPR-WYU-CJF-QXW-XSR-OTN-CZA-

LWM-BML-YUT-QIU-VDG-YQK-IXQ-

AJK-UAX-NKE-DBD-EXJ-BJW-PYW-JSP-LFE-GCX-UDQ-RLV-VHK (3233)

7

AHG-DHV-DVS-DER-DPO-FKV-BNK-FOE-

ETU-BHB-FOS-HFU-FRW-GWN-BZT-

BBW-CWC-AZS-BAJ-ECE-HAP-BWF-ALX-

GUT-BSP-BZH-FXP-GSL-DKV-FWO-DDV-

ARO-EPQ-DAU-ATB-GAR-FAY-BRF-FFF-

DNK-FDV-DSM-DIB-CRI-GRU-BUF-FJO-

EIH-GMM-FMZ-HCP-BAQ-BPW-HAF-

DWI-ALM-BXV-DUH-FIO-FHS-EFY-FRJ-

AMR-FCD-DIZ-FJA-COH-ERX-CTU-GWJ-Dataset Solusi

EZG-BKI-BTY-AEN-AKZ-HFX-LUI-IVN-

IDG-KMH-HXU-HVV-JHC-ICN-JGW-MIJ-

LAA-KLS-MLJ-JWN-LPA-JUG-IRN-HGD-

MDX-MAS-ITE-HRV-NFL-HTJ-KXI-JOQ-

NCU-LOU-MGM-LIR-HON-LID-LJA-KON-

LZD-NFB-IRE-IOM-JBB-JQD-HUV-MYY-

JOO-MON-KXF-KKA-LBK-LYI-MOR-NIZ-

HWB-HMD-JMP-KXM-KLO-MED-IIH-

KYK-LAL-IWU-LHG-HID-KPR-MCH-IBM-

MQY-MAZ-KXN-INT-NAD-JUZ-MRT-JLI-LSE-AHG (32854)

8

AEW-IDB-ZMT-FCJ-OAE-FMC-VCO-AOY-

CJT-OBE-PDI-DCB-OVD-ZZP-AZF-OLQ-

XGM-IYZ-WCD-BPY-XLY-VDU-YSB-

BQL-PEU-JFU-VGV-SVS-MSW-OIO-EOW-

BYB-NFP-NPT-IHD-FWA-NPF-BAB-TZP-

HIX-CSW-RVM-ETH-NRS-DWQ-WUE-

BIN-RWB-PDY-BKB-EOB-MFT-KIC-QQS-

DNZ-SVZ-QRL-TKC-JRT-OPC-QCW-LRU-

DCY-CGR-PUG-HMM-IVF-IUN-DRO-RAA-

VFT-WFU-MVV-RWZ-AKF-ILI-OTQ-BNL-

OOM-JQL-JKB-ULO-CAA-MYZ-JIM-FAO-

QMS-BLJ-PJS-GPI-PEP-RJM-LNC-OXH-

NOR-ROM-ASD-JAH-DSR-YHH-LAZ-EQV-

HTD-BMD-CUU-GSC-EHZ-INI-GRH-KBN-

IPE-MMN-AUJ-EXV-RWM-ZNG-JCY-PDX-

NZN-NVV-SRY-WJA-TQN-LTP-RAR-LTU-

WPH-FGF-FYA-RZG-KIW-IXO-VNJ-ASF-

HPZ-EOG-HGV-QBR-PFI-PUW-WCS-PNH-

TBS-VVA-BFZ-EBC-CKW-JLS-DVQ-CJM-Dataset Solusi

BCU-QUI-MRE-AFH-QXU-LRL-RYJ-PFU-

QZU-AME-JHO-HNP-OCB-LKE-JRX-JZU-

HKD-WKK-USB-GHI-WCU-LII-EBK-JSR-

CQP-VXE-RRT-PRO-TNH-VEP-GCF-OVC-HIN-AUO-AEW (6226)

9

GVT-NUO-PUN-RBN-ZHS-VDX-YSI-QBQ-

FTC-UZF-XPE-JAV-TMW-JPK-TWU-LUA-

AXO-NJH-JUJ-JLS-LJS-IJS-PQM-XXV-JNF-

KRI-UHQ-OBN-EGT-SAW-SAT-JPI-CAB-

JQS-PSS-TXQ-IUU-DJT-XGD-WMZ-TSX-

AWV-YEK-VLS-BSZ-IAM-RSX-QBZ-TAE-

LBR-VIQ-JVS-UCQ-OXE-GJO-NTM-EYO-

UHZ-ZUV-TKY-CEA-MZN-NRE-SIY-ZEA-

EJK-DPL-HVC-SOX-EUJ-DQF-SZE-OBM-

JXV-XSV-BYN-SPH-XXJ-VUC-DHJ-IQC-

BQX-HPH-NGB-VGF-BRC-HAC-SWH-

VGR-JOF-XEJ-TQQ-XMH-UOY-UZH-RZB-

REH-YDX-AHR-DLZ-RGA-STR-GER-AXR-

VVL-ERN-YRN-MVE-NRL-BXV-WWJ-

VKO-IML-CYU-WAZ-UCN-JJD-ZLZ-QTU-

NMF-UCR-SPU-PSE-QGZ-KXR-WSO-QRP-

FAK-WSD-IUH-VCI-GSQ-PWO-IRH-FMI-

ZZO-NVG-FKS-JDF-PYJ-GRI-VIW-FNL-

KKO-IMC-AEY-JAK-VMN-EAG-IZD-UMH-

XXF-SGB-RDM-RPW-MRO-FNQ-BCI-ZJX-

XIW-TVP-VSK-HJJ-UFP-YQL-LDA-ICU-

NDJ-VAK-OQL-PCH-SEW-VWB-HHM-

AOL-KKQ-BLW-LSE-GPH-VLV-QNV-LSC-

AEH-UGR-UEI-HSZ-NJX-TMZ-STB-HVP-

OLW-BUC-EYQ-PTC-LMK-LVV-JSU-RUK-

KLB-XSQ-URP-UDV-LOC-CAK-WTB-QJV-

YKY-JGV-LHE-RZK-XNA-XOS-QNA-PZZ-Dataset Solusi

MPH-KUL-ZID-ZNU-WQP-PAM-AHC-

OKB-ODA-ZWM-BNC-XIG-OXU-HAQ-

PSG-FWU-MLK-NZQ-BBM-ZTN-MUL-

ALC-JBA-IFZ-JIV-MGK-VEH-JLO-BRA-HDY-DHD-CPU-PFD-JXA-RGB-MRH-GVT

(82096)

10

ECB-DSH-BNO-VRY-JIE-JQC-FZB-ISW-

PDB-ZXF-YHM-GFO-PHT-BHN-RAX-VBB-

CSW-FCD-UYA-EWE-NHG-OEU-LTO-

YEC-XWU-XJE-ZIS-DEU-GEH-IUM-XFD-

TNQ-OLW-WMZ-OJE-EIN-IIK-NVJ-AJI-

KJC-AIN-QWG-XUA-CHW-LXL-WCD-

ERR-CSH-TRO-YOO-XRB-FJI-LOR-QLI-

WNB-ACC-TKS-YJV-AGL-CUQ-DRK-

NPM-UXZ-NWT-RYW-URW-JGZ-AQG-

ZEV-DSZ-NEU-SCB-STD-NAP-HZM-SPH-

ZCY-GFW-YOV-VQC-DDL-URO-OQC-

JZK-UIA-BUF-UVD-JTU-TUJ-IWD-ICO-

HDZ-KXQ-RVW-ZJA-TPR-JGU-ESC-NMV-

OTR-BHR-KOR-TBG-HLC-MTV-IYX-CQJ-

EDC-VKI-VWD-MFM-AXT-EOL-NLU-

BOT-UUG-KCX-JEH-UZM-TIP-EBZ-XXY-

FJQ-CLG-XGY-MOM-SPA-EMG-CJU-NPJ-

IVY-SZR-YME-NRS-LKC-URG-BTQ-QQA-

KAM-FCV-EJV-LME-ZZW-RMN-BCB-

LBS-SRK-YMX-HFW-GSW-LMY-BSS-

CHH-FAB-YMC-XCA-HFK-MFH-SHI-

QYH-RFP-NPL-KFW-PGR-KWU-IPX-TGN-

AHQ-RWT-THP-EPP-TFG-DLU-SLM-KCM-

GLV-JCY-YEO-AQO-SVY-QDZ-RXJ-ZIU-Dataset Solusi

UJN-MRZ-YMJ-FXQ-EXJ-ETP-OQV-UZO-

OGF-ASE-DEN-LNS-BQK-SVT-THY-IJZ-

VJP-GER-QPO-KWE-YWI-WTU-OLV-GCP-

LMG-APJ-GUO-URM-BFP-HMD-LQV-

WFD-KNJ-ICJ-CZK-KXM-JKP-VEE-QYW-

DTO-ZAZ-LFN-TIK-KNS-DDD-OQY-EGP-

LTS-LEL-ZSZ-AYM-ABP-LNF-BKB-NTI-

JAP-KLG-XOV-XGF-AAB-ZRU-GLQ-FSJ-

TNI-ODK-HTF-VUW-YPU-RQS-AKB-ZDE-

FGT-VON-SIV-WGN-QVC-KPX-OXB-EAK-

BOU-INX-XPD-WRM-PZG-PWL-ZZZ-LRY-

UKX-CNB-UPC-IUK-YRB-CCB-EXW-RFS-EVX-SNZ-DRM-GFY-UYZ-JDU-ECB

(57977)

11

LIJ-SLQ-FOG-HIE-DIW-RMH-FKL-HMT-

NNZ-CQT-NUJ-HLV-YUT-DGR-JNL-LTQ-

EIV-QAL-LQH-BKR-VRD-LRM-NFQ-JRW-

IGC-QWO-TXN-SZD-GAM-CXO-BEJ-PHY-

OFQ-KIP-DEE-PXN-DPA-DJI-ZPF-NRY-

JTA-FKW-GAB-MFB-LSW-TBR-MWP-SXJ-

EOW-PNA-BPL-NQM-NPJ-WHV-OYX-

KHM-ELA-PRW-IZX-TZY-NTW-UOA-

FWB-AEB-QDL-UZS-BUC-QZQ-NJQ-RIK-

MTM-JZN-FKN-TNZ-MYB-CJM-KYF-

NGN-CPP-DTD-JFR-KIB-LGM-UJA-LVG-

DZD-TAH-SRK-BLH-IWT-XBL-ZTL-FTW-

SVT-UHI-TTY-NOP-RYP-IKX-OIU-AUD-

VAH-FKQ-KPI-IUM-LOM-LIR-CUM-QSA-

CAW-ZEX-PND-XEX-NTG-EGG-MBQ-

CIB-OGM-PKP-EDC-CHM-MBV-LRU-JWL-

LSU-CLS-HYM-EKP-MGY-MRN-JCP-NDU-Dataset Solusi

HFR-FIT-BXF-LMS-KRL-HCI-AOU-HJQ-

LUF-GGK-SPS-IWF-QDG-XJU-JBN-PTG-JUT-LSX-LIJ (58642)

12

PJE-GPQ-GJZ-DKL-SDL-SKJ-LEX-MKS-

RNM-DMM-FXQ-KLY-ARK-RAG-OPN-

KGS-GRI-YRT-NUU-OBN-BFK-GYX-OHN-

NEJ-NXV-UMJ-GOF-KEF-HBE-QNT-OZM-

ADH-BQP-BCC-SBF-DUV-PLU-AEF-NIK-

CNZ-HQT-MYZ-OUH-NVC-CKH-UTG-

TPT-OXT-DFV-JTJ-SFS-TAR-MXC-EFD-

GDP-WMN-NXG-MXX-YBA-OQD-ABC-

LKD-PIL-PSS-FKK-JJR-HUU-GQE-UDS-

PFI-FBT-FNT-MWL-JGC-GSF-ODY-ONZ-

GUI-ZWI-BPA-VSR-CDF-TZF-YHK-RFV-

RLV-QTT-OYK-NHH-VNU-RCF-ISQ-FDO-

NIU-SKB-QTI-TTB-OLX-EKV-XIA-UBM-

IHU-ASV-KPQ-XAL-DUF-HKN-HWC-EZN-

SXO-LRD-KFV-KYY-KLC-MPH-CWO-

GJY-MFA-JOK-MCD-RWG-EVS-JLG-GYD-

JTO-CZB-OAM-ZNO-QPQ-SAN-RDI-DFY-

RRM-KSN-WGV-RHH-JEQ-FDM-LNP-

NTP-HJC-IGO-HBC-JCH-HQK-PJV-YDW-

LZB-KWC-HZT-AWL-NPB-MYC-NSB-

KNP-KIB-ISX-OWP-AXD-FLG-MTH-MNJ-

QRB-IWJ-XGF-IWP-ILA-TLJ-NSX-SCI-

SDS-JOX-EDL-MIS-EIH-DID-FWL-HER-

QIP-NFZ-TBX-TYV-MQY-LNJ-ZAA-SWO-

AVW-FSR-NZM-CNF-OMN-SUN-KBN-BAP-BPT-HPQ-AVL-JOY-VRQ-MUP-PJE

(83560)

Dataset Solusi

LZM-LIS-KZA-MPZ-DAH-SQK-EMY-IUF-

MOE-UKA-CTG-IUB-GCB-TDN-UTM-

BSH-YWL-TUU-NLU-SEF-NUY-TBP-SOL-

DJY-ZUO-MYF-NSG-TVO-SHN-HTM-SNU-

PYX-DYS-PGC-XMX-UDG-LFD-WHN-

AWP-WPR-IZA-IVS-RVW-TIP-GMA-ZTR-

BYN-DUX-LZQ-SWU-BEB-YPG-REB-

OAB-JBZ-IZT-VMY-AAM-LWI-DAK-FPL-

YTF-JCJ-BQF-KPN-UOW-OIR-GRX-CZD-

GKJ-GAR-TXU-OIK-UQP-VZT-QUE-GCK-

GQJ-VMW-OXW-CYT-XMH-BMD-SLY-

AHQ-BJT-CFT-YTJ-IZY-HIA-THJ-GSX-

LEB-NLW-AIV-AOJ-KQA-GOH-ITH-LGT-

POB-PLK-EPN-RYO-NOI-FFA-WOZ-XJS-

OFL-YWH-AEL-VZY-SRS-SBY-IOA-XUR-

CJZ-PUT-WBE-MGJ-SYL-NIF-GWD-XRE-

DLP-OUQ-WPW-VPY-GSI-HFS-RUA-NLM-

VCP-TGS-UQD-XME-OCL-BZR-INI-TLG-

OEH-FCA-TGW-DCO-FMJ-HML-ACC-

AVF-RFW-KKI-KFW-VSE-PGF-EUV-IKD-

SAN-AQC-BYM-DOO-NTW-KSY-UOU-

NZH-NEO-CKA-SHH-WTP-RZM-UPM-JJC-

IHK-JCC-PEF-WDX-GXK-TNL-OTS-LXH-

RJJ-OEE-DCH-UHC-AUF-LQC-SQP-SSF-

OGV-LLY-SDY-SOF-QNF-DSJ-RXQ-GSM-

VOV-JJB-ONM-SXE-HGS-XNA-IQS-AVI-

AMW-FFX-UFC-AON-EWE-KKY-GLT-

GDN-WJL-ZMS-VLA-OOK-EPV-RYT-DFV-

LZZ-DIY-SIQ-OFW-CKZ-NYB-NCV-TPX-

OEG-RZS-TAC-WOS-AOH-VEZ-DLH-UAW-TWD-DEB-GKU (138227)

Dataset Solusi

14

IXG-AAJ-ZIT-SLF-ZLA-BNB-MMT-TIL-

SYY-NVF-XDS-HVE-ZAH-BAH-DQK-KII-

OXB-LXM-ZAW-FKP-QQE-QQM-AKF-

DYS-RDM-NHX-FON-OST-MMR-PGB-

YDZ-FGX-HDB-LWD-FDC-CCK-EKJ-

WLK-DOB-PMI-OOW-IES-YFC-NXW-NNJ-

HMF-HKT-JEI-ZZV-SVV-TOG-PAB-KDT-

EKB-VMZ-PNS-JSN-EXG-XDP-WGF-XZU-

YBJ-QTT-EVD-QCY-JTI-WEN-OFE-QPR-

QYJ-QHL-IZW-GCZ-FXG-DMI-GIU-HXV-

KUA-DZU-QSS-VZA-QID-QVV-RLF-ONX-

IPC-EWS-EAJ-OUO-HKP-SDF-CEF-JQA-

OEX-HXK-THL-IVF-KXF-APY-TKP-QEM-

BRR-FLC-GSD-ZBA-AUQ-AAL-IAV-ZHK-

RTP-BOW-OGN-MYJ-PXB-HOH-VMP-

BFF-PZF-GTW-JVE-GUO-SJX-MWZ-MQW-

GZG-WZV-SJH-JTW-NGK-IZC-JRF-CNY-

AOB-RDO-XTR-DAX-RZZ-PMQ-GXR-DEI-

OYM-SRE-ZOS-PPL-AGQ-HYF-JNH-KEU-

TPF-IER-DLU-LCC-FSO-SIQ-ZTD-SZB-

PSK-FSE-QNQ-MCB-JKA-SSN-LYR-FGK-

MER-END-EXL-CDN-OXU-DWY-SOM-

DBP-QSX-RUR-DUB-NRF-ORA-VQA-JAK-

FMC-MXN-KBC-PQK-IJJ-HLT-ITG-YAH-

TKN-JFR-EVS-GQV-RUB-NNS-IPU-NWX-

UFE-KPC-MIZ-EJY-OYJ-MCY-VTF-RLV-

BCJ-IMH-GIT-WCY-CEA-JSE-CWL-GZZ-

SRB-IJS-JOK-SGD-ZTM-YLV-NZZ-IBE-

PWL-UDG-EPH-AZZ-JDF-KEV-SWR-HHR-

IFX-XGR-IKW-FPG-AOL-TVT-KJN-MXD-Dataset Solusi

WBK-UIE-EBK-JWW-MFF-ZPD-WCQ-ILP-

LKS-WNQ-UVX-BPO-KQO-PTG-USH-JRO-

YDC-YZU-YHQ-OUL-RGA-CKL-HFT-

VRY-ZYZ-XMU-OON-XJQ-OQQ-QLD-

QJO-FBV-DRK-HIM-GAL-OXF-WUC-QTS-

ZGD-YAF-EDF-FIC-UPE-FQX-XIH-ZUJ-XJK-CFT-FES-AZP-SJO-IXG (144815)

4.5 Performa Algoritma Artificial Bee Colony

Untuk bisa mengetahui apakah hasil solusi akhir dengan menggunakan algoritma ABC bagus atau

tidak, maka perlu dilakukan beberapa perbandingan dari hasil solusi akhir. Perbandingan pertama

akan dilakukan dengan hasil dari solusi awal. Setelah itu akan dilanjutkan dengan

membandingkan dengan algoritma lainnya (GA, NN, SA). Parameter dan jumlah iterasi pada

masing-masing algoritma pembanding telah diatur agar menghasilkan solusi optimal dengan

running time yang mirip dengan running time algoritma ABC.

4.5.1 Perbandingan dengan Solusi Awal

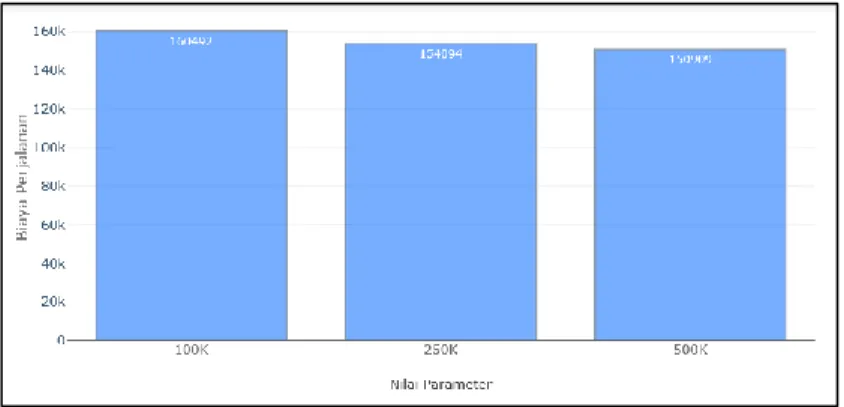

Perbandingan dengan solusi awal dilakukan untuk melihat seberapa besar penghematan yang bisa

dilakukan setelah dilakukan optimasi dengan algoritma ABC. Hasil perbandingan dapat dilihat

pada gambar 4.14.

Berdasarkan perbandingan dengan solusi awal, algoritma ABC dapat menghemat biaya perjalanan

dengan rata-rata 56,1% darihasil yang dihasilkan solusi awal. Algoritma ABC hanya

menghasilkan solusi yang sama pada dataset 2 karena hasil pada solusi awal sudah merupakan

hasil yang teroptimal.

Pada dataset buatan, algoritma ABC mampu menghasilkan hasil yang sangat baik dengan

menghasilkan solusi lebih baik diatas 50%. Terdapat tiga dataset yang mampu menghasilkan

solusi lebih lebih baik diatas 80%. Namun pada dataset berdasarkan data real, peningkatan solusi

hanya berkisar 20 sampai 40%.

Gambar 4.14 Perbandingan Solusi Awal dan Solusi Akhir

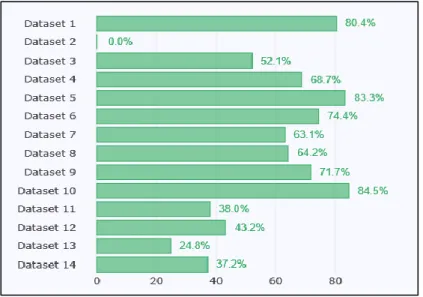

4.5.2 Perbandingan dengan Algoritma Nearest Neighbour

Pada dataset 1-5 algoritma ABC menghasilkan hasil yang lebih baik pada 7 dataset. Sedangkan

pada dataset 2 menghasilkan hasil yang sama dengan algoritma NN dikarenakan dataset 2

memang hanya memiliki satu solusi.

Algoritma ABC mampu menghasilkan solusi yang jauh lebih baik dari algoritma NN dengan

penghematan biaya perjalanan sebesar 73% pada dataset 1, 52% pada dataset 3, 72% pada dataset

4 dan 66% pada dataset 5. Selengkapnya dapat dilihat pada gambar 4.15.

Gambar 4.15 Perbandingan Algoritma ABC dan NN

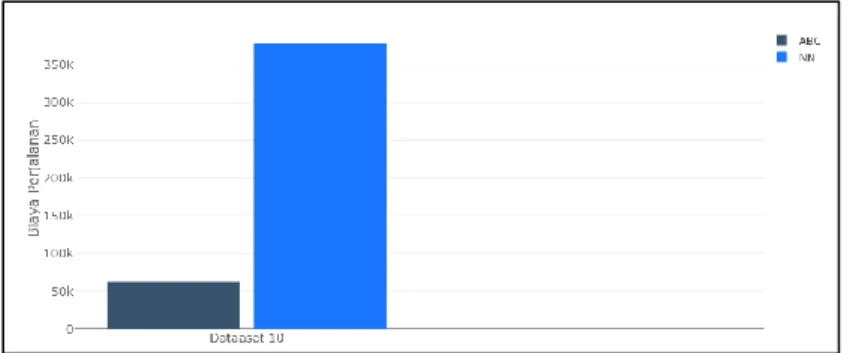

Pada dataset 6-14 algoritma NN hanya dapat menghasilkan solusi yang layak pada dataset 10.

Pada dataset tersebut algoritma ABC menghasilkan solusi yang lebih baik dengan penghematan

4.5.3 Perbandingan dengan Algoritma Genetik

Pada dataset 1-8 algoritma ABC menghasilkan hasil yang lebih baik pada 7 dataset. Sedangkan

pada dataset 2 menghasilkan hasil yang sama dengan algoritma GA dikarenakan dataset 2

memang hanya memiliki satu solusi.

Perbedaan cukup besar terlihat pada dataset 4 dan 5. Algoritma ABC mampu menghasilkan solusi

yang lebih baik dari algoritma GA dengan penghematan biaya perjalanan sebesar

Gambar 4.16 Perbandingan Algoritma ABC dan NN

49,5% pada dataset 4 dan 73% pada dataset 5. Selengkapnya dapat dilihat pada gambar 4.17.

Pada dataset 9-14 algoritma ABC menghasilkan hasil yang lebih baik pada 5 dataset tersebut.

Perbedaan cukup besar terlihat pada dataset 9 dan 10 dan 14. Algoritma ABC mampu

menghasilkan solusi yang lebih baik dari algoritma GA dengan penghematan biaya perjalanan

sebesar 34% pada dataset 9, 47% pada dataset 10 dan 29% pada dataset 14. Selengkapnya dapat

dilihat pada gambar 4.18.

Perbandingan dapat dilihat lebih detail pada setiap dataset dengan menggunakan box plot. Pada

dataset 1 baik persebaran data maupun hasil solusi, algoritma GA menghasilkan hasil yang lebih

buruk.

Sementara untuk dataset 2 hasil antara kedua algoritma sama persis diakibatkan dari solusi awal

yang mampu menghasilkan hasil terbaik pada dataset tersebut. Selengkapnya dapat dilihat pada

gambar 4.19

Gambar 4.17 Perbandingan Algoritma ABC dan GA

Gambar 4.18 Perbandingan Algoritma ABC dan GA

Selanjutnya pada dataset 3 dan 4, algoritma ABC menghasilkan hasil yang lebih baik dari segi

persebaran data dan juga hasil solusinya. Pada dataset 4 algoritma ABC mampu menghasilkan

solusi baik dengan persentase sebesar 50%. Selengkapnya dapat dilihat pada gambar 4.20.

Gambar 4.20 Box Plot Dataset 3 dan 4

Pada dataset 5 dan 6, algoritma ABC tetap unggul baik dari segi persebaran maupun hasil solusi.

Perbedaan yang cukup besar terdapat pada dataset 5 dimana algoritma ABC mampu menghasilkan

solusi lebih baik dengan persentase sebesar 73%. Selengkapnya dapat dilihat pada gambar 4.21.

Gambar 4.21 Box Plot Dataset 5 dan

6

Pada dataset 7 dan 8 algoritma ABC tetap menghasilkan hasil yang lebih baik. Selengkapnya

dapat dilihat pada gambar 4.22.

Gambar 4.22 Box Plot Dataset 7 dan 8

Pada dataset 9 dan 10 algoritma ABC masih tetap menghasilkan hasil yang lebih baik dari segi

persebaran data maupun hasil solusi. Selengkapnya dapat dilihat pada gambar 4.23.

Gambar 4.23 Box Plot Dataset 9 dan 10

Selanjutnya pada dataset 11 dan 12 algoritma ABC tetap menghasilkan hasil ynag lebih baik. Pada

persebaran data algoritma ABC menghasilkan hasil yang lebih baik dengan persebaran data yang

lebih kecil. Sedangkan untuk hasil solusi perbedaan hanya berkisar 10-15%. Selengkapnya dapat

dilihat pada gambar 4.24.

Gambar 4.24 Box Plot Dataset 11 dan 12

Pada dataset 13 dan 14 persebaran data tidak terlalu berbeda jauh antara kedua algoritma. Namun

pada hasil solusinya algoritma ABC menghasilkan hasil yang lebih baik terutama pada dataset 14.

Selengkapnya dapat dilihat pada gambar 4.25.

Gambar 4.25 Box Plot Dataset 13 dan 14

Berdasarkan beberapa penjelasan diatas, dapat disimpulkan algoritma ABC menghasilkan hasil

yang jauh lebih baik daripada algoritma GA.

4.5.4 Perbandingan dengan Algoritma Simulated Annealing

Pada dataset 1-8 algoritma hanya menghasilkan hasil lebih baik pada dataset 4. Pada dataset 2

kedua algoritma menghasilkan hasil yang sama. Pada 6 dataset lainny algoritma SA menghasilkan

hasil yang lebih baik.

Perbedaan cukup besar terlihat pada dataset 8. Algoritma SA mampu menghasilkan solusi yang

lebih baik dari algoritma ABC dengan penghematan biaya perjalanan sebesar 41%. Selengkapnya

dapat dilihat pada gambar 4.24.

Gambar 4.26 Perbandingan Algoritma ABC dan SA

Pada dataset 9-14 algoritma SA menghasilkan hasil yang lebih baik pada 5 dataset tersebut.

Selengkapnya dapat dilihat pada gambar 4.27.

Gambar 4.27 Perbandingan Algoritma ABC dan SA

Untuk lebih detailnya akan dilihat setiap dataset dengan menggunakan box plot. Dataset 1 dan 2

mengasilkan hasil yang sama persis sehingga tidak dibuatkan grafik box plotnya.

Untuk dataset 3 algoritma ABC menghasilkan persebaran solusi yang lebih baik dan untuk nilai

solusi tidak ada perbedaan besar antara kedua algoritma.

Untuk dataset 4 algoritma SA menghasilkan persebaran solusi yang lebih baik. Sedangkan

algoritma ABC unggul pada hasil solusi. Selengkapnya dapat dilihat pada gambar 4.28.

Gambar 4.28 Box Plot Dataset 3 dan 4

Untuk dataset 5 dan 6 algoritma ABC menghasilkan hasil persebaran data yang lebih baik.

Sedangkan untuk nilai solusi algoritma SA menghasilkan hasil yang lebih baik pada dataset 4.

Untuk dataset 7 dan 8 persebaran nilai solusi cenderung sama dan untuk hasil solusi algoritma SA

menghasilkan hasil yang lebih baik. Selengkapnya dapat dilihat pada gambar 4.30.

Pada dataset 9 algoritma SA menghasilkan hasil yang lebih baik dengan pada persebaran nilai solusi

dan nilai solusi.

Gambar 4.29 Box Plot Dataset 5 dan 6

Gambar 4.30 Box Plot Dataset 7 dan 8

Sedangkan untuk dataset 10 algoritma SA menghasilkan nilai solusi yang lebih baik tetapi untuk

persebaran nilai solusinya lebih buruk daripada algoritma ABC. Selengkapnya dapat dilihat pada

gambar 4.31.

Gambar 4.31 Box Plot Dataset 9 dan 10

Pada dataset 11 dan 12 algoritma ABC menghasilkan persebaran nilai solusi yang lebih baik.

Sedangkan untuk nilai solusinya algoritma SA menghasilkan nilai yang lebih baik. Selengkapnya

dapat dilihat pada gambar 4.32.

Gambar 4.32 Box Plot Dataset 11 dan 12

Pada dataset 13 algoritma ABC menghasilkan persebaran nilai solusi yang lebih baik. Namun untuk

nilai solusinya algoritma SA yang menghasilkan hasil lebih baik.

Pada dataset 14 algoritma SA menghasilkan persebaran dan nilai solusi yang sedikit lebih baik dari

algoritma ABC. Selengkapnya dapat dilihat pada gambar 4.33.

Berdasarkan beberapa penjelasan diatas, algoritma SA menghasilkan hasil yang lebih baik daripada

algoritma ABC dengan menghasilkan hasil yang lebih baik pada 11 dataset. Algoritma ABC

menghasilkan hasil yang lebih baik pada persebaran data. Namun hal tersebut tidak dapat membuat

algoritma ABC menghasilkan performa yang lebih baik.

BAB III STATUS LUARAN

Tabel 3 Status Luaran

No

Nama Luaran

Status

1

Seminar Internasional Terindeks Scopus

Published

2

Jurnal Q1

Persiapan

BAB IV KENDALA PELAKSANAAN PENELITIAN

Kesulitan mendapatkan data kepadatan lalu lintas yang real time di kota Surabaya. Ditambah lagi

pandemic covid19 sehingga terkendala tidak bisa kunjungan ke dinas perhubungan kota Surabaya.

BAB V RENCANA TAHAPAN SELANJUTNYA

Rencana selanjutnya dari penelitian ini adalah:

1. Pengembangan Model VRP

2. Penulisan untuk Jurnal

BAB VI DAFTAR PUSTAKA

[1] Kruskal, Joseph B. "On the shortest spanning subtree of a graph and the traveling salesman

problem." Proceedings of the American Mathematical society 7.1 (1956): 48-50.

[2] E. K. Burke and Y. Bykov, "The late acceptance Hill-Climbing heuristic," European Journal of

Operational Research, no. 258, pp. 70-78, 2017.

[3] J. M. Sussman, Perspectives on Intelligent Transportation Systems (ITS). New York:

Springer-Verlag, 2005.

[4] D. L. Applegate, R. E. Bixby, V. Chvatal and W. J. Cook, "The Problem," in The Traveling

Salesman Problem : A Computational Study, New Jersey, Princeton University Press, 2006,

pp. 1-59.

[5] Edmund Burke, Graham Kendall, Jim Newall, Emma Hart, Peter Ross, and Sonia

Schulenburg. Hyper-heuristics: An emerging direction in modern search technology. In

Handbook of metaheuristics, pages 457–474. Springer, 2003.

[6] G. Dantzig and J. Ramser, “The Truck Dispatching Problem,” Management Science, Vol. 6,

No. 1, 1959, pp. 80-91.

[7] Braekers, Kris, Katrien Ramaekers, and Inneke Van Nieuwenhuyse. "The vehicle routing

problem: State of the art classification and review." Computers & Industrial Engineering 99

(2016): 300-313.

[8] Zhang, Junping, et al. "Data-driven intelligent transportation systems: A survey." IEEE

Transactions on Intelligent Transportation Systems 12.4 (2011): 1624-1639.

[9] Laporte, Gilbert. "A concise guide to the traveling salesman problem." Journal of the

Operational Research Society 61.1 (2010): 35-40.

[10] Lust, Thibaut, and Jacques Teghem. "The multiobjective traveling salesman problem: a

survey and a new approach." Advances in Multi-Objective Nature Inspired Computing.

Springer, Berlin, Heidelberg, 2010. 119-141.

[11] Doerner, Karl F., and Verena Schmid. "Survey: matheuristics for rich vehicle routing

problems." International Workshop on Hybrid Metaheuristics. Springer, Berlin, Heidelberg,

2010.

[12] Lin, Canhong, et al. "Survey of green vehicle routing problem: past and future trends."

Expert Systems with Applications 41.4 (2014): 1118-1138.

[13] Zhao, Na, Jiabin Yuan

, and Han Xu. "Survey on intelligent transportation system." Computer

science 41.11 (2014): 7-11.

LAMPIRAN 1 Tabel Daftar Luaran

Program

: Penelitian Unggulan ITS

Nama Ketua Tim

: Ahmad Muklason, S.Kom., M.Sc., Ph.D

Judul

: Pengembangan Model Traveling Salesman Problem &

Vehicle Routing Problem dan Algoritma Generik Berbasis

Hyper-heuristics Untuk Menyelesaikan Permasalahan

Optimasi Operasi dan Penjadwalan Public Transport di Kota

Surabaya dalam Kerangka Kerja Intelligent Transport

Systems

1.Artikel Jurnal

No

Judul Artikel

Nama Jurnal

Status Kemajuan*)

1

Solving Travelling Salesman

Challenge 2.0 Problem

with Artificial Bee Colony

Algorithm

Expert System With Its

Application

Persiapan

*) Status kemajuan: Persiapan, submitted, under review, accepted, published

2. Artikel Konferensi

No

Judul Artikel

Nama Konferensi (Nama

Penyelenggara, Tempat,

Tanggal)

Status Kemajuan*)

1

Self Adaptive Learning – Great

Deluge Based Hyper-heuristics

for Solving Cross Optimization

Problem Domains

IEEE: The 17th

International

Conference on

Electrical

Engineering/Electronics,

Computer,

Telecommunications

and Information

Technology (ECTI-CON

2020) 24-27 June 2020

Virtual Conference

Hosted by College of

Computing, Prince of

Songkla University,

Thailand

Presented

*) Status kemajuan: Persiapan, submitted, under review, accepted, presented

3. Paten

*) Status kemajuan: Persiapan, submitted, under review

4. Buku

No

Judul Buku

(Rencana) Penerbit

Status Kemajuan*)

*) Status kemajuan: Persiapan, under review, published

5. Hasil Lain

No

Nama Output

Detail Output

Status Kemajuan*)

*) Status kemajuan: cantumkan status kemajuan sesuai kondisi saat ini

4. Disertasi/Tesis/Tugas Akhir/PKM yang dihasilkan

No Nama Mahasiswa

NRP

Judul

Status*)

1

SHOF RIJAL AHLAN

ROBBANI

05211850012002Hyper-heuristic

for Solving

New variant

TSP Problem

In Progress

2

LANANG ALUN

NUGRAHA

05211850012003

Hyper-heuristic

for Solving

New variant

VRP Problem

In Progress

Self Adaptive Learning – Great Deluge Based

Hyper-heuristics for Solving Cross Optimization

Problem Domains

Widya Saputra

Information Systems Department Institut Teknologi Sepuluh Nopember

Surabaya, Indonesia

widyasaputra@engineer.com

Ahmad Muklason

Information Systems Department Institut Teknologi Sepuluh Nopember

Surabaya, Indonesia

mukhlason@is.its.ac.id

Baiq Z.H. Rozaliya

Information Systems Department Institut Teknologi Sepuluh Nopember

Surabaya, Indonesia

zuyyinahilya56@gmail.com

Abstract—In the literature, almost all optimization problems in NP-hard class are solved by meta-heuristics approach. However, this approach has the drawback of requiring tuning parameters for each different problem domain and different instances of the same problem. This approach is considered less effective in resolving these problems. Therefore, a new approach is needed, namely the hyper-heuristics approach that is able to solve cross-domain problems. Hyper-heuristic is one of the approximate search methods which is able to provide solutions to NP-hard problems in polynomial time, as well as giving fairly good and acceptable results. This method has two properties of search space, namely the selection of LLH and the acceptance of solutions (move acceptance). This approach works in barrier domains rather than directly working in problem domains. With these properties, hyper-heuristic is able to solve problems in different domains. In addition, hyper-heuristics has a learning mechanism through feedback from previously generated solutions. This final project tries to apply a hyper-heuristic algorithm in six combinatorial optimization problem domains, namely SAT, Bin Packing, Flow Shop, Personnel Scheduling, TSP, and VRP. The method that will be used in this final project is Self Adaptive - Great Deluge (SAD-GED). The Self Adaptive mechanism is used to make LLH selection to be used, while the Great Deluge is used in determining the acceptance of solutions (move acceptance) in a hyper-heuristic framework. The application of the SAD-GED algorithm is expected to be able to provide better results than the existing algorithm used previously, namely Simple Random - Simulated Annealing.

Keyword—Meta-heuristic, Hyper-heuristic, Self-adaptive Learning, Great Deluge, Cross Domain Optimization

I. INTRODUCTION

Optimization is a method of finding feasible and optimal solutions from a collection of solutions that have been identified [1]. Optimization plays a role in minimizing or maximizing the value of the objective function in each problem. There are various optimization problems such as sat, flow shop, timetabling, vehicle routing problem, bin packing, and traveling salesman problem where trying to find the shortest distance, from one location to another [2]. These problems can be included in the NP-hard class where optimal solutions are

In solving increasingly complex problems, we need algorithms that are able to provide solutions with relatively fast time. Approximate algorithms such as heuristics, meta-heuristics, and hyper-heuristics are choices in solving these problems. The approximate algorithm provides a solution that does not guarantee the most optimal, but is quite good and relatively fast (polynomial).

Meta-heuristic is one method that is able to select and modify heuristics to produce new solutions or change current solutions into other solutions [3]. For many combinatorial problems, this method becomes very powerful and provides a flexible method. However, this method has drawback, unable to adapt well to the changes in the structure of problems or even instance of problems that are different from the same structure.

Unlike Hyper-heuristics, this method is a high-level methodology which combine multiple low-level heuristics (LLH) and problem instances effectively so it provides solutions in cross-domain problems. In other words, this method can determine which low level heuristic will be used and determine whether to accept the solution produced by LLH (move acceptance) or not. This method works in a heuristic workspace so there is no need to know a specific understanding of the problem to be solved. So that, hyper-heuristic is more general in solving hard combinatorial optimization problems because it does not depend on the problem parameters [4]. This study tries to apply the Hyper-heuristic Self Adaptive Learning Great Deluge (SADGED) method in solving cross domain optimization problems. The problem to be solved refers to the HyFlex framework where there are six problem domains, satisfiability (SAT), one dimensional bin packing, permutation flow shop, personnel scheduling, traveling salesman problem (TSP), and vehicle routing problem (VRP). Later, the results obtained from the method will be compared with the Simple Random Simulated Annealing (SRSA) algorithm which acts as a comparison method so that it can measure the performance of the algorithm that has been applied

II. LITERATURE STUDY

A. Combinatorial Optimization

The problem of combinatorial optimization is a problem that exists in the fields of machinery, planning, and industry that can be modeled in the form of minimizing or maximizing costs on limited discrete variables. [5]. In the optimization problem, there is a value of the objective function which will be maximized and minimized according to the objectives to be achieved based on the existing constraints.

B. Meta-heuristic

Meta-heuristics are the main strategies that guide and modify other heuristics to produce solutions outside of optimal local search. This method describes the entire search process, such as which heuristics will be used, even the criteria for accepting solutions. For many combinatorial problems, this method becomes very powerful and provides a flexible method. Meta-heuristics are mostly inspired by natural processes or science, such as the Simulated Annealing method, Taboo Search, Genetic Algorithm, and so on [3].

Meta-heuristics will succeed in optimizing the problem if it can strike a balance between exploration (diversification) and exploitation (intensification) so that it depends on parameter values [6]. Exploitation is needed to identify parts of the search for solutions with good quality results. The classification of solutions resulting from this process can be either single or plural solutions. This approach relies on parameter values so that it is less able to adapt to changes in problem structures or even different problem instances with the same structure. C. Hyper-heuristic

Hyper-heuristic includes a collection of approaches which aim to automate, which usually combines with machine learning techniques, the process involves selecting and combining simple heuristics or creating new heuristics from existing heuristic components in order to solve optimization problems [6]. Hyper-heuristic is a methodology that can provide a solution that is not too optimal, but a fairly good and acceptable solution. the main purpose of hyper-heuristics is to create a general design method, which can provide a feasible solution based on the use of LLH.

Hyper-heuristic is a learning algorithm if it uses feedback from the solution search process. Based on the feedback dimension, there are 3 divisions of learning types. Online learning, learning is done when the algorithm is solving problems. Offline learning, which is collecting knowledge in the form of rules and programs, from a collection of training instances that are expected to generalize to resolve events that are not visible [7]. As for No-learning, Hyperheurisik does not do learning.

Hyper-heuristic has a general structure consisting of high-level

it has LLH selection mechanism (to determine new solutions) and move acceptance (determine whether to accept the solution or not).

III. METHOD

A. Problem Identification

This study aims to apply a hyper-heuristic method that is able to provide optimal results (fitness) for each problem domain contained in the HyFlex framework. Each problem contained in HyFlex has different problem characteristics so that the LLH

Fig. 1. The Design of Algorithm Flowchart for Self Adaptive Learning Great Deluge

contained in each problem is also different. Hyper-heuristics must be able to recognize every LLH and use LLH for every

development focuses on selection of pertubative LLH based on single point search (one solution result) [8].

B. Literature Study

At this stage a literature study is carried out related to the material that will be used as a research reference. Literature studies include concepts that will be applied in research. C. Desain The Algorithm

At this stage the hyper-heuristic is developed as a high-level heuristic strategy that is in accordance with the problem that has been defined. At this stage the method will be described in the selection of LLH and the mechanism for accepting solutions.

In this study, the high level strategy applied to hyper-heuristics is a combination of self adaptive learning and great deluge (SADGED). The self adaptive learning method is used as LLH selection in solving problems, while the great deluge is used as a mechanism of move acceptance in obtaining new solutions resulting from the implementation of LLH in each problem domain. This mechanism will accept a better solution or below the parameter B value limit in the great deluge method at each predetermined iteration. SADGED algorithm design can be seen in Figure 1.

In this study, the LLH series (low level heuristic) used is LLH which is available in the HyFlex framework. low level heuristic is a collection of heuristics on HyFlex which is used to generate solutions so that the objective function of the solution can be known in solving problems. In HyFlex, LLH used are grouped into four types, namely mutation, ruin-recreate, local search, and crossover [9].

Fig. 2. The calculation of minimum and median value that is better than SRSA based on the trial results of the percentage of desired value based on the initial solution

The self adaptive learning method plays a role in determining the amount of LLH that will be used by the method to find the value of objective functions, this study uses the number of LLH limits as provided in the HyFlex framework. The value of the desired value variable is set to 10 percent of the initial solution value. The initial level parameter value or the solution acceptance factor is set the same as the initial solution value, while the value of the decay rate or temperature reducing factor is set based on the reduction in the initial value of the solution

[10]. Self adaptive learning plays a role in selecting LLH which produces the best value. When all the selected LLHs have been used, the algorithm will fill in the LLH that will be used with a composition of 75% of LLH that produces values that can be accepted by the move acceptance method, while the remaining 25% of LLH is in the problem domain [11].

D. Implementation

This stage is the implementation phase of the algorithm design in the hyper-heuristic Flexible (HyFlex) framework. Implementation is the stage of development of algorithm design into the program language. This stage starts from the preparation of tools to the implementation of the program.

The implementation is done on a 3.2 Ghz core i5 processor and 4096 MB of memory. The algorithm design will be implemented in the HyFlex framework using the NetBeans IDE 8.2 application. implementation is done by calling the method contained in the chesc.jar library

.

E. Trial

Algorithm testing tries to find the optimal solution for the six problem domains in the HyFlex framework. A trial was conducted to find out how the performance of the algorithm that had been built on six problem domains, namely satisfaction, one-dimensional bin packing, permutation flow shop, personnel scheduling, traveling salesman problem, and vehicle routing problem.

Fig. 3. The scenario of testing methods that will be used in the HyFlex framework.

Based on the results of testing the desired value parameters in the self-adaptive learning great deluge method, the most optimal value obtained is 10 percent of the value of the initial solution. The trial is conducted by comparing the median and minimum values of the results of the execution. From Figure 2, the desired value of 10 percent provides a fairly stable number of solutions compared to other trial values. The value obtained is a percentage of the initial solution value. Meanwhile, the use of LLH length in the SADGED method is adjusted to the number of LLH contained in each problem domain.

In Figure 3 the method trial scenario, the algorithm is run by entering some required input data. Furthermore, the framework will search for solutions based on predefined input data. After the final criteria for running the algorithm are completed, the framework will return the value of the best solution resulting from the search process

Simple Random Simulated Annealing Algorithm and Great Deluge Self Adaptive Learning are applied in six problem domains contained in the HyFlex framework. In each problem domain, there are five instances that have been determined in the trial process so that the total instances used are 30 instances. Each instance is tested 31 times with a time of 60000 milliseconds. From the data the results of the execution are calculated the best value (minimum), first quartile, median, third quartile, maximum value, and average that will be used as a comparison value for each method

IV. RESULTS AND DISCUSSION

The trials were conducted 31 times on six problem domains with 5 instances of each problem. In conducting trials, performance measurements are carried out by comparing the SADGED method with SRSA. Performance testing is done by doing three comparisons. First, comparing the distribution of data from the results of the method execution on some statistical data, namely the minimum value (fitness), the first quartile, median, third quartile, and the maximum value of the value of the objective function. This test uses the calculation of values and points and visualization of boxplot diagrams from the statistical data obtained. Second, comparing the median values obtained to measure the concentration of values in the data. Third, make a comparison of the minimum values obtained from the method execution results.

A. Comparison of Data Distribution

Comparison of data distribution is done by calculating based on statistical values such as minimum value, first quartile, median, third quartile, and maximum value and visualization of values against the boxplot diagram. The objective function value data from the comparison of two methods that give smaller values will get one point. The maximum point in one problem domain is 25 while the overall point of the problem domain is 150. Methods that get a greater value are said to be superior to other methods. The results of calculations and boxplot diagrams of the two methods can be seen as follows:

• In the SAT problem domain, SADGED has better

performance compared to SRSA. The SADGED method excels at the five instances tested and gets 25 points.

• In the bin packing problem domain, the SADGED

algorithm lost 17 points from the SRSA algorithm with the acquisition of 21 values for SRSA and 4 for SADGED. The SADGED algorithm is only able to outperform one instance and lose to the other four instances.

it gets 12 points, while SRSA gets 13 points. The difference between the two methods is only 1 point and won by SRSA.

• In the personnel scheduling problem domain, SADGED excels in three instances, namely instance 5, instance 10, and instance 11, while losing to the other two. The SADGED algorithm is 5 points ahead of SRSA with 16 points.

• In the tsp problem domain, SADGED excels in all five instances by getting a value of 21, which is 19 points ahead of SRSA who gets a value of 4.

• In the vrp problem domain, SAGDED excels in the five instances tested and scores 25 points.

Based on the calculation of points that have been done, the SADGED method excels in four problem domains and gets 56 points compared to SRSA. The SADGED method gets 103 points from all 30 instances tested compared to SRSA which only gets 47 points.

Fig. 4. The comparison of median score graph of great deluge self adaptive learning method with simple random simulated annealing.

B. Comparison of Median Values

Comparison of the median value is done to measure the centralization of the results of the method execution. This second measurement uses the FIFA ball method by looking at the value of the median in each instance. the algorithm that is considered to be won will be given a value of three, then for a balanced algorithm will get a value of one and the losing algorithm will get an empty value. The method is considered to win if the total value of the changes obtained is positive and is considered losing if it is negative.

Based on the test results in Figure 4, SADGED won in four problem domains, namely sat, personnel scheduling, tsp, and vrp. However, this method loses to two other problem domains, namely Bin Packing and Flowshop. This indicates that the SADGED algorithm is not able to provide better results in the two problem domains when compared to the SRSA algorithm, which suffered quite a lot of losses. Performance testing graph