Universitas Gadjah Mada 1 BAB 4.

JARINGAN BERBASIS KOMPETISI

Jaringan berbasis kompetisi menggunakan ide kompetisi untuk meningkatkan kontras dalam aktivasi neuron (winner take all). Hanya neuron yang aktivasinya diperbolehkan tetap ―on‖. Jaringan ini dapat dikategorikan sebagai berikut:

1. Jaringan kompetitif berbobot tetap: a. Maxnet

b. Mexican Hat c. Hamming Net

2. Jaringan Kompetitif dengan bobot adaptif

a. Jaringan Kohonen Self Organizing Map (SOM) b. Jaringan Linear Vector Quantization (LVQ) c. Jaringan Counter Propagation (CP).

4.1 Maxnet

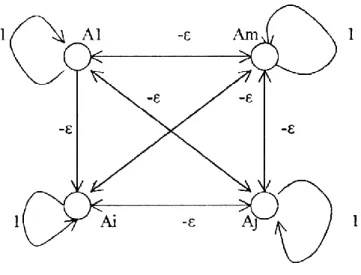

Jaringan ini dapat digunakan sebagai subnet untuk menetukan node yang masukannya terbesar. Ke m node dalam subnet ini terhubung penuh dengan bobot simetris. Karena bobotnya tetap, maka tidak ada algoritma pelatihan.

Arsitektur

Arsitektur Maxnet terlihat pada Gambar 4.1

Universitas Gadjah Mada 2 Fungsi aktivasinya adalah

Aplikasi

Langkah 0. Inisialisasi aktivasi dan bobot.

Tetapkan 0 < ε <1/m ; aj(0) = masukan ke node Aj 1 bila i = j

wij=

-

i ≠ jLangkah 1. Bila syarat berhenti salah, kerjakan Langkah 2 - 4 Langkah 2. Perbarui aktivasi setiap node

aj (baru) = f [aj (lama) -

∑ ak (lama) ] k ≠ jLangkah 3. Simpan aktivasi untuk iterasi selanjutnya. aj (lama) aj (baru) ; j = 1 , ……… m Langkah 4. Uji syarat berhenti.

Bila Iebih dan satu node mernpunyai aktivasi non zero, lanjutkan.

Bila tidak, berhenti

4.2 Mexican Hat.

Jaringan ini merupakan subnet peningkat kontras (Kohonen 1989) yang Iebih umum dan pada Maxnet. Setiap neuron dihubungkan ke sejumlah tetangga kooperatifnya yang berdekatan dengan link eksitator yang berbobot positif. Setiap neuron juga dihubungkan ke sejumlah tetangga kompetitif yang berdekatan dengan jalinan (link) inhibitori, yang merupakan neuron-neuron yang lebih jauh. (Gambar 4.2)

Untuk mernudahkan deskripsi, neuron-neuron digambarkan sebagai susunan orde Iinear, dengan hubungan positifantara unit Xi dan unit tetangga., yaitu satu atau dua posisi ke sampan, serta hubungan negative untuk posisi ketiga ke samping. Ukuran daerah koperasi dan kompetisi bisa berubah menurut :

a. Magnitude relative dan bobot positifdan negative b. Topologi daerah (linear rectangular, heksagonal, dll).

Universitas Gadjah Mada 3 Gambar 4.2 Jaringan Mexican hat

Peningkatan kontras sinyal si yang diterima oleh unit xi diperoleh dengan iterasi beberapa langkah Aktivasi unit xi pada waktu t diberikan oleh:

xi(t) = f[ si (t) + ∑ wk xi + k (t + 1)] k

dengan suku penjumlahan adalah sinyal terbobot dari unit lain (tetangga kooperatif dan tetangga kompetitif) pada langkah sebelumnya. Pada Gambar 4.2 terlihat bahwa bobot wk dan unik xi ke xi+k adalah positifuntuk k = -2, .1, 0, 1, dan 2 serta negative untukk k = -3 dan 3, dan nol untuk unit yang lain

4.3 Jaringan Hamming

Jaringan Hamming adalah pengklasifikasi kemungkinan maksimum yang dapat digunakan untuk menentukan vector eksemplar yang paling serupa dengan vector masukan. (n tupel). Vektor eksemplar menentukan bobot jaeingan. Ukuran kemiripan antara vector masukan dan vector eksemplar yang disimpan dinyatakan dengan jarak Hamming. Jarak Hamming antara dua vector adalah cacah komponen yang berbeda antara dua vector tersebut. Untuk vector bipolar x dan y maka produk innernya adalah:

x.y =a – d

dengan a: cacah komponen yang sama

d : cacah komponen yang berbeda yang merupakan jarak Hamming. BiIa n adalah cacah komponen vector, maka

d=n – a dan x.y 2a – n atau 2a= x.y +n

a = x. 34 y + ½ n yang ekuivalen dengan yin = x w + b

Universitas Gadjah Mada 4 Ini berarti dengan menetapkan bobot = ½ vector eksemplar, maka nilai bobot = ½ vector eksemplar dan nilai bias = n/2. Sehinggajaringan akan menemukan unit yang paling at dengan eksemplar bila menemukan unit dengan masukan neto terbesar.

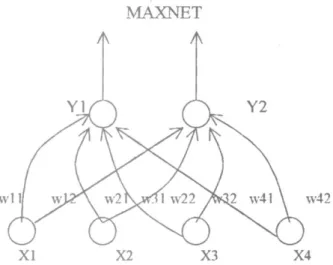

Jaringan bagian bawah terdiri atas n node masukan, yang masing-masing terhubung dengan m node keluaran (dengan m adalah cacah vector eksemplar yang disimpan di dalam jaringan. Kemudian node keluaran dan jaringan bagian bawah diberikan ke jaringan bagiati atas Maxnet), yang menghiti.Thg kesesuaian eksemplar terbaik dengan vektor masukan. Vektor masukan dan vektor keluaran adalah bipolar. Arsitekturjaringan Hamming terlihat pada Gambar 4.3.

Gambar 4.3 Jaringan Hamming

4.4 Pemetaan Swa Organisai Kohonen

Pemetaan Swa Organisasi Kohonen (Kohonen Self Organizing Maps, SOM) juga disebut pemetaan yang mempertahankan topologi, dengan mengasumsikan struktur topologi di antara unit gugus (cluster). Sifat mi nampak pada otak. Di sini terdapat m unit gugus yang tersusun dalam lank satu atau dua dimensi. Sinyal masukannya merupakan n tupel.

Vektor bobot unit gugus bertindak sebagai eksemplar dan pola masukan yang terasosiasi dengan gugus tersebut. Selama proses swa-organisasi, unit gugus yang vector bobotnya sangat sepadan dengan pola masukan (biasanya dinyatakan dengan kuadrat jarak Euclidean minimum) dipilih sebagai pemenang. Unit pemenang dan unit tetangganya (dalam arti topologis unit gugus) memperbarui bobotnya. Vektor bobot unit tetangga umumnya tidak dekat dengan pola masukan.

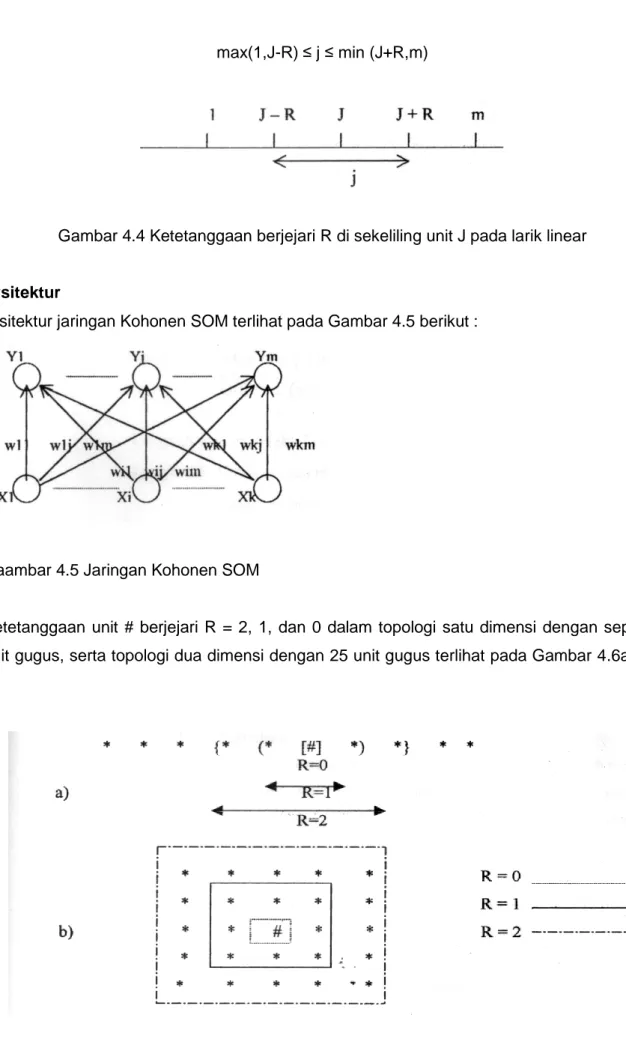

Untuk lank (array) linear dan unit gugu, ketetanggaan berjejani R disekeliling unit gugus 3 terdini atas semua unit j sedemikian sehingga ( Gambar 4.4):

Universitas Gadjah Mada 5 max(1,J-R) ≤ j ≤ min (J+R,m)

Gambar 4.4 Ketetanggaan berjejari R di sekeliling unit J pada larik linear

Arsitektur

Arsitektur jaringan Kohonen SOM terlihat pada Gambar 4.5 berikut :

Gaambar 4.5 Jaringan Kohonen SOM

Ketetanggaan unit # berjejari R = 2, 1, dan 0 dalam topologi satu dimensi dengan sepuluh unit gugus, serta topologi dua dimensi dengan 25 unit gugus terlihat pada Gambar 4.6a dan b.

Universitas Gadjah Mada 6 Algoritma

Algoritma pelatihan jaringan Kohonen SOM adalah sebagai berikut: Langkah 0. Inisialisasi bobot wij

Tetapkan parameter ketetanggaan topologis Tetapkan parameter laju pelatihan

Langkah 1. Selama syarat berhenti : salah, kerjakan Langkah 2 — 8.

Langkah 2. Untuk setiap vektor masukan x, Kerjakan Langkah 3 - 5. Langkah 3. Untuk setiap hitunglah:

D(j) = ∑ (wij - xi)2 i

Langkah 4. Cari indeks J sedemikian sehingga D (J) minimum. Langkah 5. Untuk semua unit j di dalam ketetanggaan 3, dan

untuk semua i, hitunglah:

wij (baru) = wij (lama) +

[xi — wij (lama) ] Langkah 6. Perbarui laju belajar.Langkah 7. Kurangi jejari ketetanggaan topologis dengan cacah tertentu Langkah 8. Uji syarat berhenti. Bila benar, berhenti.

4.5 Kuantisasi Vektor Pelatihan

Kuantisasi vektor pelatihan (Learning Vector Quantization, LVQ) adalah metode kiasifikasi pola yang mana setiap unit keluaran menyatakan suatu kelas atau kategori. Vektor bobot untuk unit keluaran sering disebut vector referensi (buku kode) untuk kelas yang dinyatakan oleh unit tersebut. Selama pelatihan unit keluaran dicari posisinya dengan mengatur bobotnya lewat pelatihan terbimbing.

Dalam hal ini diberikan sehimpunan pola yang klasifikasinya diketahui diberikan bersama distribusi awal vector referensi. Setelah pelatihan jaringan LVQ mengklasifikasikan vector masukan dalainkelas yang sarna dengan unit keluaran yang memiliki vector bobot (referensi ) yang paling dekat dengan vector masukan,

Arsitektur

Arsitektur jaringan LVQ adalah sama dengan jaringan Kohonen SOM tetapi tanpa asumsi struktur topologis untuk unit keluaran (Gambar 4.5). Lagi pula setiap unit keluaran memiliki kelas yang diketahui.

Algoritma

Motivasi algoritma pelatihan LVQ adalah mempçroleh unit keluaran yang paling dekat dengan vector msukan. Bila x dan wc berasal clan kelas yang sama, maka vector bobot

Universitas Gadjah Mada 7 didekatkan ke vector masukan ini. Tetapi bila x dan wc memiliki kelas yang berbeda, maka vector bobot dijauhkan dan vector masukan ini.

Nomenklatur:

x : vector pelatihan (x1,xi, ... . . . .,xn) T : Kelas atau kategori vector pelatihan.

wj : vektor bobot untuk unit keluaran kej ; (w1j, ……. wij , ……. wnj). Cj : Kategori atau kelas yang diberikan oleh unit keluaran ke j.

wj

x : Jarak Euclidean antara vector masukan dan vector bobot untuk unit keluaran kej.

Langkah 0. Inisialisasi vector referensi Inisilisasi laju pelatihan a (0)

Langkah 1. Selama syarat berhenti : salah, kerjakan Langkah 2 - 6

Langkah 2. Untuk setiap vector masukan pelatihan x, kerjakan Langkah 3 - 4. Langkah 3. Carilah J sehingga xwj minimum

Langkah 4. Perbarul wj, sebagai berikut: Bila T = CJ maka

wj (baru) = wJ (lama) +

[x- wJ (lama)]J] Bila T ≠ CJ makaw, (baru) = w. (lama) - a [x- w., (lama)] Langkah 5. Kurangi laju pelatihan

Langkah 6. Uji syarat berhenti

(dapat spesifikasi cacah iterasi atau laju pelatihan sudah mencapai nilai yang cukup kecil).