MAKALAH

ANALISIS REGRESI TERAPAN

REGRESI ROBUST

TIAR INDARTO G152144051

PROGRAM STUDI STATISTIKA TERAPAN

SEKOLAH PASCA SARJANA

INSTITUT PERTANIAN BOGOR 2016

DAFTAR ISI

DAFTAR ISI ii

A. PENDAHULUAN 1

1. LATAR BELAKANG 1

2. TUJUAN 2

B. TINJAUAN PUSTAKA 2

1. REGRESI LINEAR BERGANDA 2

2. OLS UNTUK REGRESI LINEAR BERGANDA 3

3. UJI ASUMSI MODEL REGRESI LINEAR 3

a. UJI NORMALITAS 3

b. UJI MULTIKOLINEARITAS 3

c. UJI HOMOSKEDASITAS9 3

d. UJI AUTOKORELASI 3

4. PENCILAN (OUTLIER) 4

a. STANDARDIZED RESIDUAL 4

b. DELETED (STUDENTIZED RESIDUAL) 4

c. DFITS 5

5. REGRESI ROBUST 5

a. Estimasi M 5

b. Estimasi Least Trimmed Square (LTS) 9

c. Estimasi S 9

d. Estimasi MM 10

e. Estimasi LMS 10

f. Estimasi W 11

g. Estimasi L 11

h. Estimasi R 11

C. PEMBAHASAN 12

1. PENERAPAN ESTIMASI M 12

a. Estimasi M (Huber) 12

b. Estimasi M (Tukey Bisquare) 18

2. PENERAPAN ESTIMASI LTS 20

D. DAFTAR PUSTAKA 23

A. PENDAHULUAN 1. LATAR BELAKANG

Analisis terhadap hubungan antara dua variabel atau lebih menggunakan sebuah persamaan matematik (model regresi) adalah analisis regresi. Dalam model regresi terdapat dua variabel yakni variabel Y (variabel tak bebas/dependent/respon/akibat) dan variabel X (variabel

bebas/independent/penjelas/sebab). Dalam analisis regresi dapat dibagi menjadi regresi linear sederhana, regresi linear berganda dan regresi non linear. Terdapat beranekaragam metode yang dapat digunakan untuk melihat hubungan antara Y dengan X seperti metode kuadrat terkecil (ordinary least square), metode kemungkinan maksimum (maximum likelihood method), metode bootstrap, metode kuadrat terkecil terboboti (weighted least square method), dan lain – lain (Bambang, 2009). Metode yang familiar digunakan adalah metode kuadrat terkecil/ordinary Least Square (OLS), karena mudah penggunaanya. Ada beberapa asumsi yang harus dipenuhi dalam OLS agar hasil estimasinya bersifat BLUE (best linear unbiased estimator), yaitu : (1) sisaan menyebar normal dengan

E ( ε

i)

=0 danvar ( ε

i)

=σ2 , (2) sisaan memiliki ragam yang homogeny (homoskedasitas), (3) sisaan menyebar bebas yaknicov ( ε

i, ε

j)

=E ( ε

i, ε

j)

=0 (serial independent). Namun OLS memiliki kekurangan yakni sensitive terhadap pencilan/outlier. karena apabila terdapat outlier maka akan terjadi penyimpangan pendugaan OLS atau terjadi bias estimasi. Sehingga model regresi dapat memberikan gambaran hubungan yang jauh dari keadaan sebenarnya. Untuk mengatasi hal tersebut dibutuhkan suatu penduga robust (kekar) yang mempunyai kemampuan mendeteksi pencilan sekaligus menyesuaikan dugaan parameter regresi, sehingga memberikan hasil yang resistant (stabil).Regresi robust menjadi alternatif solusi dalam mengatasi hal tersebut. Regresi kekar terhadap outlier tersebut diperkenalkan Andrews (1972). Regresi robust yang baik adalah yang sebanding dengan OLS tanpa outlier. Suatu estimator semakin robust terhadap outlier ketika memiliki efisiensi dan breakdown point yang tinggi. Kemungkinan tertinggi breakdown point untuk sebuah estimator adalah 50%. Ada 8 prosedur estimasi parameter dalam regresi robust, antara lain:

a. Estimasi M

b. Estimasi Least Trimmed Square (LTS) c. Estimasi S

d. Estimasi MM e. Estimasi LMS f. Estimasi W g. Estimasi L

h. Estimasi R

Masalah yang akan dibahas dalam tulisan makalah ini adalah pengujian ketidakpenuhan asumsi klasik, cara pendeteksian outlier dan pendugaan model pada data penjualan rokok tahun 2012 di yogyakarta dengan menggunakan metode regresi robust hingga didapat persamaan model terbaiknya.

2. TUJUAN

Tujuan dari penulisan makalah ini adalah untuk menggunakan regresi robust estimasi M IRLS dengan fungsi pembobot Huber dan Bisquare Tukey dan regresi robust estimasi LTS pada data yang terdapat outlier.

B. TINJAUAN PUSTAKA

1. REGRESI LINEAR BERGANDA

Menurut Montgomery and Peck (1992), secara umum peubah tak bebas y kemungkinan berhubungan dengan k peubah bebas. Model ini :

y

i = β0 + β1 xi1 + β2 xi2 + … + βk xik + εi (1)

y

i adalah peubah tak bebas pada pengamatan ke-i, xi1, xi2, …, xik adalah nilai peubah bebas pada pengamatan ke-i dan parameter ke-k, β0, β1, … , βkadalah parameter regresi, dan εi adalah error pengamatan ke-i.

2. OLS UNTUK REGRESI LINEAR BERGANDA

Dalam kasus k-peubah bebas, penaksir metode kuadrat terkecil diperoleh dengan meminimumkan :

∑

i=1 nεi2 =

y

i¿¿

∑

i=1 n¿

)2 (2)

di mana

∑

i=1 n

ε

i2 adalah jumlah kuadrat sisaan. Dalam notasi skalar, metodekuadrat terkecil tercapai dalam menduga β0, β1, … , βk sehingga

∑

i=1 n

ε

i2sekecil mungkin. Ini dicapai dengan menurunkan persamaan (2) secara parsial terhadap ^β 0, ^β 1, … , ^β k dan menyamakan hasil yang diperoleh dengan nol.

Berdasarkan Montgomery and Peck (1992), dalam notasi matriks, metode kuadrat terkecil sama dengan meminimumkan

ε

'ε

.Dengan persamaan :

ε= y−Xβ

(3)Oleh karena itu,

ε

'ε=( y−Xβ )

'(y−Xβ)

¿

y

'y−2 β

'X

'y +β

'X

'Xβ

(4)β

'X

'y

adalah matrik 1 x 1, atau suatu skalar. Transposenya(

β

'X

'y)

'=y

'Xβ

adalah skalar. Pendugaan metode kuadrat terkecil harus memenuhi :∂ ∑

i=1 n

ε

i2∂ β

=∂ ε

'ε

∂ β

=−2 X'y+2 X

'X ^β

(5) Bila disederhanakan menjadi :−2 X'

y +2 X

'X ^β=0

2 X'X ^β=2 X

'y

X

'X ^β=X

'y

(6)Untuk menyelesaikan persamaan (6) kalikan keduannya dengan invers dari

X

'X

. jadi pendugaan kuadrat terkecil dariβ

adalah^β=( X'

X)

−1X

'y

(7)3. UJI ASUMSI MODEL REGRESI LINEAR a. UJI NORMALITAS

Pada regresi linier klasik diasumsikan bahwa tiap εi didistribusikan normal dengan lambang :

ε N (0, σ

2) . Uji statistik yang dapat digunakan untuk menguji normalitas residual adalah uji statistik Kolmogorov-Smirnov (K-S).b. UJI MULTIKOLINIERITAS

Menurut Montgomery and Peck (1992), untuk mendeteksi ada atau tidaknya multikolinieritas di dalam model regresi, dapat dilihat pada nilai VIF (variance inflation factors).

VIFj = 1

(1−R2j) (8)

dengan

R

2j adalah nilai koefisien determinasi yang diperoleh dari meregresikan peubah bebas xj dengan peubah bebas lainnya. Nilai VIF > 10 menunjukkan multikolinieritas yang kuat.c. UJI HOMOSKEDASITAS

Untuk menguji ada tidaknya kesamaan variansi residual dari satu pengamatan ke pengamatan yang lain. Uji ini dapat menggunakan Scatter plot. Sumbu X adalah nilai-nilai prediksi ZPRED = Regression Standartdized Predicted Value. Jika garfik yang diperoleh menunjukkan adanya pola tertentu dari titik-titik yang ada, dikatakan terjadinya heteroskedastisitas. Akan tetapi, jika tidak membentuk pola tertentu, dikatakan tidak terjadi heteroskedastisitas.

d. UJI AUTOKORELASI

Menurut Gujarati (1997), dengan menggunakan lambing : E(

ε

i, ε

j ) = 0 ; i ≠ j. Secara sederhana dapat dikatakan model klasik mengasumsikan bahwa error yang berhubungan dengan pengamatan tidak dipengaruhi oleh error yang berhubungan dengan pengamatan lain yang manapun. Salah satu cara yang dapat digunakan untuk mendeteksi masalah autokorelasi adalah dengan uji Durbin Watson.Dengan terpenuhi semua asumsi regresi linier di atas, model yang dihasilkan dianggap baik untuk melihat pengaruh peubah-peubah bebas terhadap peubah-peubah tak bebas. Selanjutya, model dapat digunakan sebagai penduga.

4. PENCILAN (OUTLIER)

Menurut Montgomery and Peck (1992), pencilan adalah suatu pengamatan yang ekstrim. Residual yang nilai mutlaknya jauh lebih besar daripada yang lain dan bisa jadi terletak tiga atau empat simpangan baku dari rata-ratanya adalah yang menyebabkan data sebagai pencilan. Pencilan adalah titik-titik data yang tidak setipe dengan titik data yang lainnya.

Menurut Draper and Smith (1992), adakalanya pencilan memberikan informasi yang tidak bisa diberikan oleh titik data lainnya. Berdasarkan Montgomery and Peck (1992), sebagai kaidah umum, pencilan baru ditolak jika setelah ditelusuri ternyata merupakan akibat dari kesalahan-kesalahan seperti memasukkan ukuran atau anlisis yang salah, ketidaktepatan pencatatan data, dan terjadi kerusakan alat pengukuran. Bila ternyata bukan

akibat dari kesalahan-kesalahan semacam itu, penyelidikan yang seksama harus dilakukan. Menghapus data tersebut untuk “memperbaiki persamaan yang cocok” dapat berbahaya, tindakan tersebut dapat menimbulkan kesalahan ketelitian dalam mengestimasi atau memprediksi. Ryan (1997) mengelompokkan pencilan dalam berbagai tipe :

a. Pencilan-x, yakni pengamatan yang hanya menyimpang pada sumbu x saja. Pengamatan ini disebut juga sebagai titik leverage.

b. Pencilan-y, yakni pengamatan yang menyimpang hanya karena arah peubah tak bebasnya.

c. Pencilan-x,y, yaitu pengamatan yang menyimpang pada keduanya yakni pada peubah x dan peubah y.

Untuk mendeteksi adanya pencilan dapat dilakukan dengan beberapa metode sebagai berikut:

a. Standardized residual

Standardized residual merupakan nilai residual yang distandarkan. Nilai ini digunakan untuk mendeteksi pencilan. Jika | ri | > 2 atau | ri | > 3, maka data pada pengamatan ke-i merupakan pencilan y.

b. Deleted (Studentized Residual)

Deleted Studentized Residual merupakan nilai-nilai standardized residual dimana observasi ke-i dihilangkan. Nilai ini digunakan untuk mendeteksi ada atau tidaknya pencilan. Data dikatakan pencilan jika ti > ( α, n-p) dengan p adalah banyak parameter.

c. DFITS

DFITS yaitu mengukur pengaruh suatu pengamatan terhadap nilai dengan respon ketika suatu pengamatan tidak disertakan dalam analisis. Nilai ini digunakan untuk mendeteksi pengaruh pengamatan ke-i terhadap nilai ^

y

dirinya sendiri. Jika nilai | DFITS | > 2

√ n p

dengan p menyatakan jumlah parameter dalam model bersangkutan maka hal ini merupakan pengamatan berpengaruh.5. REGRESI ROBUST

Menurut Chen (2002), regresi robust adalah sebuah alat yang penting untuk menganalisis data yang terkontaminasi pencilan. Tujuan utama regresi robust adalah untuk memberikan hasil yang stabil karena kehadiran pencilan.

a. Estimasi M

Berikut adalah diagram alur pembentukan model estimasi M :

Mulai

Mencari estimasi baru dengan weighted least square.

Estimasi parameter b dengan OLS

Menghitung fungsi pembobot melalui ( )

Paramater () konvergen ?

Pengujian signifikansi parameter Tidak terpenuhi

revisi

Model estimasi M

(Huber dan Tukey Bisquare) Bisquare)

selesai ya

ya

Tidak konvergen

Estimasi M diperkenalkan oleh Huber pada tahun 1973 dan ini merupakan pendekatan yang paling sederhana baik secara teori maupun perhitungan.

Diketahui:

y

i=α +β1x

i 1+β

2x

i 2+…+βkx

ik+ε

i (9)i i

i

x

y

' (10)

Untuk observasi ke-i dari n observasi, model yang sesuai adalah,

y

i=a+b1x

i 1+b2x

i 2+…+b

kx

ik+ei (11)i i

i

x b e

y

' (12)

Estimator M umumnya dengan meminimumkan fungsi objektifnya adalah,

∑

i=1 nρ ( e

i)

=∑

i=1 n

ρ( y

i−xi'b)

(13)Dimana fungsi ρ memberikan kontribusi untuk setiap residual dari untuk fungsi objektifnya.

Misalkan ψ=ρ ' dengan ψ merupakan turunan dari ρ. Untuk meminimumkan fungsi objektif, maka fungsi objektif akan diturunkan terhadap

b

dan hasilnya persamaan, sebagai berikut :∑

i=1 nψ

(

yi−xi'b)

xi'=0 (14)

ψ

merupakan fungsi influence yang digunakan dalam memperolehbobot (weight). Dengan fungsi pembobot wi=ψ (ei¿)

ei¿ dimana

e

i¿ merupakan residual yang distandarkan, maka persamaannya menjadi :∑

i=1 nw

i( y

i−x

i'b ) x

i'=0 (15)

Apabila dinotasikan dalam matrik :

X

TWXb=X

TWy

, bentuk matrik tersebut dinamakan least square dengan penimbang (weighted leastsquare) yang akan meminimalkan

y

i−^y

i¿¿

w

i¿∑

i=1 n¿

. Weighted least square dapat

digunakan untuk mendapatkan estimasi M, estimasi parameternya menjadi :

b= ( X

TWX )

−1X

TWy

(16)Penimbang tergantung pada residual, residual tergantung pada koefisiean yang diestimasi, dan koefisien yang diestimasi tergantung pada penimbang. Untuk menyelesaikan masalah tersebut dilakukan proses

iterasi yang disebut sebagai Iteratively Reweighted Least-Square (IRLS).

Langkah – langkahnya sebagai berikut :

1) Pilih estimasi b(0), seperti estimasi least-squares.

2) Pada setiap iterasi

l

, hitung residuals eil-1 dan asosiasikan penimbang wi(l-1) =w[ei(l-1) ] dari iterasi sebelumnya.3) Penyelesaian untuk estimasi penimbang baru.

b(t)=

[

X ' W(l−1)X]

−1X ' W(l −1)y (17)dengan l1

w

merupakan matrik diagonal dengan elemen diagonalnya adalah i,l1

w

. Sehingga estimasi parameter pada iterasi pertama ( l = 1 ) menggunakan ei,0 dan i,0

w

.4) Langkah 2 dan 3 diulangi sampai koefisien yang diestimasi konvergen.

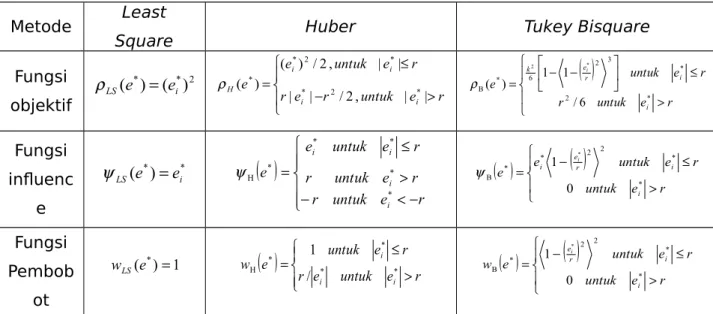

Tiga bentuk estimasi M diantaranya estimasi least square, Huber dan Tukey bisquare (biweight). Bentuk fungsi objektif, fungsi influence dan fungsi pembobot untuk ketiga jenis estimasi M sebagai berikut :

Metode Least

Square Huber Tukey Bisquare

Fungsi objektif

2

*

*) ( )

( i

LS e e

r e r untuk e r

r e untuk e

e

i i

i i

H | | /2, | |

|

| , 2 / ) ( )

( * 2 *

* 2

*

*

r e untuk r

r e untuk e

i r i

k ei

* 2

* 2 3

* 6 B

6 / 1 ) 1

(

2 *

Fungsi influenc

e

*

*)

( i

LS e e

r e untuk r

r e untuk r

r e untuk e

e

i i i i

*

*

*

*

*

H

r e untuk

r e untuk e e

i r i

e

i i

*

* 2 2

*

* B

0 1 *

Fungsi Pembob

ot

1 ) (e*

wLS

r e untuk e

r

r e untuk e

w

i i

i

*

*

*

*

H /

1

r e untuk

r e untuk e

w

i r i

ei

*

* 2 2

*

B 0

1 *

Tabel 1 Fungsi objektif, fungsi influence, dan fungsi pembobot pada estimasi M (Sumber : Fox (2002), Mongomery (1992))

Nilai r pada fungsi objektif, influence dan pembobot adalah tunning constant. Kuzmic et.al (2004) menyebutkan estimasi M Huber efektif digunakan pada α = 5% dengan r=1,345, sedangkan estimasi M Tukey Bisquare dengan r=4,685. Kelly (2008) menyatakan permasalahan dalam estimasi regresi robust adalah perlu dilakukan pemilihan tunning constant agar estimasi yang diperoleh lebih spesifik dan memimimumkan jumlah kuadrat residual. Apabila menurunkan tunning constant akan menaikan

pembobot terhadap residual yang besar, sedangkan menaikkan tunning constant akan menurunkan pembobot terhadap residual yang besar.

Semakin besar r maka estimasi robust akan mendekati least square.

Setelah estimasi telah didapatkan, maka langkah selanjutnya adalah melakukan pengujian parameter dalam model regresi bertujuan untuk mengetahui apakah parameter tersebut telah menunjukkan hubungan yang nyata antara variabel prediktor dan variabel respon. Disamping itu juga untuk mengetahui kelayakan parameter dalam menerangkan model.

Terdapat dua tahap pengujian yaitu uji serentak dan uji parsial (individu).

1) Uji Serentak

Uji serentak merupakan pengujian secara bersama semua parameter dalam model regresi. Hipotesis yang digunakan adalah sebagai berikut : H0 :0 = 1 = ... = j = 0

H1 : paling tidak ada satu j 0, j = 0, 1, ... k Statistik uji yang digunakan untuk OLS adalah

Fhitung =

MSE MSR

=

) 1 /(

ˆ ) (

) /(

ˆ ) (

1

2 1

2

k n y

y

k y y

n i

i i n i

i

Sedangkan untuk Weighted least squares (WLS)

Fhitung(weighted) = weighted

weighted

MSE MSR

=

) 1 /(

ˆ ) (

) /(

ˆ ) (

1

2 1

2

k n y

y w

k y y w

n i

i i i n i

i i

(18) Ket : MSR : Mean Square Regression

MSE : Mean Square Error

Pengambilan keputusan adalah apabila Fhitung F (k, n-k-1) dengan k adalah parameter maka H0 ditolak pada tingkat signifikansi , artinya paling sedikit ada satu j yang tidak sama dengan nol. Pengambilan keputusan juga dapat melalui P-value dimana H0 ditolak jika P-value < α.

2) Uji Parsial

Uji parsial merupakan pengujian secara individu parameter dalam model regresi yang bertujuan untuk mengetahui parameter model regresi telah signifikan atau tidak. Hipotesis yang digunakan adalah sebagai berikut : H0 :j = 0

H1 : j 0, j = 0, 1, 2, ..., k

Statistik uji yang digunakan untuk metode OLS adalah

) ( j

j hitung

b S t b

(19) Dengan

MSE X

X b

S2( j)( T )1

(20) Sedangkan untuk metode Weighted least squares (WLS)

) ( ( )

) ( ) (

weighted j

weighted j weighted hitung

b S

t b

(21)

dengan

) ( ( )

2

weighted

bj

S

merupakan diagonal matrik kovarian.

Pengambilan keputusannya yaitu apabila |thitung| t(1-/2, n-k-1) dengan k adalah parameter maka H0 ditolak pada tingkat signifikansi , artinya ada pengaruh xi terhadap model. Pengambilan keputusan juga dapat melalui P- value, dimana H0 ditolak jika P-value < α.

b. Estimasi Least Trimmed Square (LTS)

Langkah – langkah yang dilakukan dalam mengestimasi parameter regresi robust dengan estimasi LTS, sebagai berikut :

1) Menghitung kuadrat residual (

e

i2) urutkan dari yan terkecil sampai

terbesar dan menghitung h dimana

h= n+ p+1

2 .

2) Menghitung

E

2LTS=∑

i=1 h

e

i2 .3) Melakukan estimasi parameter ^βbaru(i) dari

h

baru(i) pengamatan.4) Menentukan kuadrat residual

e

i2 darih

baru(i) pengamatan.5) Menghitung

E

2LTS(baru) .6) Melakukan iterasi dari langkah 4 s.d. 5 sampai mendapatkan fungsi objektif (h) yang terkecil dan konvergen ke nol.

7) Kemudian lakukan uji hipotesis untuk mengetahui apakah variabel bebas mempunyai pengaruh yang signifikan terhadapa variabel tak bebas.

c. Estimasi S

Langkah – langkah yang dilakukan dalam mengestimasi parameter regresi robust dengan metode estimasi S, sebagai berikut :

1) Menghitung nilai residual yakni

e

i=y

i− ^y

i 2) Menghitung standar deviasi sisaanmedian∨e

i−median( e

i)

∨0.6745¿, iterasi=1

^σi=

{

¿√ nk

1∑

i=1nw

ie

i2,iterasi>1

Dengan k =0.1993) untuk mendapatkan nilai

u

i=e

i^σs

4) Menghitung nilai pembobot

w

i=ψ (u

i)u

i ={ [1−(

1.5470 ,u

i| u

i| ) ≥1.547

2]

2, | u

i| ≤ 1.547

5) Menghitung nilai koefisien parameter penduga ^β=

[

X ' WX]

−1X ' Wy 6) Dari koefisien parameter penduga yang didapat kembali ulangilangkah 1 s.d. 4 sampai didapatkan kekonvergenan.

7) Kemudian lakukan uji hipotesis untuk mengetahui apakah variabel bebas mempunyai pengaruh yang signifikan terhadapa variabel tak bebas.

d. Estimasi MM

Estimasi MM merupakan gabungan dari estimasi S dan estimasi M.

Prosedur estimasi ini adalah dengan mengestimasi parameter regresi menggunakan estimasi S yang meminimumkan skala sisaan dari estimasi M dan dilajutkan dengan estimasi M. langkah-langkahnya sebagai berikut : 1) Menghitung nilai sisaan

e

i=y

i− ^y

i dari estimasi S2) Menghitung nilai

σ

^s 3) Menghitung nilaiu

i=e

i^σs

4) Menghitung pembobot

w

i={ [

1−(

4.685¿u

0i)

2]

2, | u

i| ≤ 4.685

¿

, | u

i| ≥ 4.685

5) Menghitung parameter ^β estimasi MM dengan metode WLS dengan

pembobot

w

i06) Mengulangi langkah 2 s.d. 4 sampai diperoleh nilai ^β estimasi MM yang konvergen.

7) Kemudian lakukan uji hipotesis untuk mengetahui apakah variabel bebas mempunyai pengaruh yang signifikan terhadapa variabel tak bebas.

e. Estimasi LMS

LMS (Least Median of Square) didefenisikan sebagai vector-p,

^θLMS=argmin

θ

Q

LMS(θ)Dimana,

Q

LMS(θ)=r(h)2r

(1)2<

r

(22)<…<r(n)2adalah error (residual) kuadrat yang diurutkan,

r

i2=( y

i−xiTθ )

2, i=1, … ,n ,

h didefenisikan sebagai interval darin

2+1 ≤ h ≤3 n+ p+1

4 . Nilai breakdown untuk estimasi LMS juga bernilai

n−h

n

. Namun, estimasi LTS mempunyai beberapa keunggulan dibandingkan dengan estimasi LMS. Fungsi objektifnya “lebih halus”, membuat LTS lebih stabil (kecuali sensitive untuk efek local) daripada estimasi LMS. Efisensi statistiknya lebih baik karena estimasi LTS normal secara asymptotic dimana estimasi LMS memiliki tingkat konvergensi yang lebih rendah.f. Estimasi W

Estimasi W mewakili bentuk alternative dari estimasi M. Masing-masing estimasi W mempunyai karakteristik fungsi penimbang W(.) menggambarkan pentingnya tiap sample dalam kontribusinya pada estimasi T, yang dihubungkan pada estimasi M yang bersesuaian mengikuti

ψ (r )=W (r )r

. Parameter optimal diperoleh dengan menyelesaikan,∑

j=1 nW (rj)rj=0

Yang sama seperti persamaan untuk masalah regresi Weighted Least Square. W-Estimator menawarkan prosedur penghitungan iterative M- Estimator yang sederhana dan menyenangkan, dimana persamaan W- Estimator dalam iterasi sekarang diselesaikan dengan perbaikan nilai penimbang,

W (r

j) , pada iterasi sebelumya. Prosedur untuk memperoleh hasil merujuk pada Iterative Reweighted Least-Square (IRLS atau RLS). Seperti pada kasus estimator M dan W, IRLS bergantung pada skala prefix dan akurat untuk defenisi penimbangnya. Skala estimasi yang paling umum digunakan adalah 1,483 x MAD.g. Estimasi L

Estimasi L didasarkan pada order statistic (statistic terurut), sebagai contoh andaikan kita ingin mengestimasi parameter lokasi suatu distribusi dari sample acak

X

1, X

2,… , X

n . Order statistic sampel ini adalahX

[1 ]≤ X

[2]≤ …≤ X

[n] . Median sample merupakan estimasi L, karena itu merupakan suatu ukuran lokasi order statistic.h. Estimasi R

Sebagai tambahan terhadap estimator M, ada pendekatan lain untuk regresi robust. Estimasi R adalah prosedur yang didasarkan pada ranking (urutan). Untuk menggambarkan prosedur yang umum, ganti satu factor

pada fungsi sasaran kuadrat terkecil s(β)=

∑

i=1 n

(

yi−xi'β)

2 denganrankingnya. Demikian jika

R

i adalah ranking dariy

i−x

i'β

, lalu kitaingin meminimalkan

∑

i=1 n

(

yi−xi'β)

Ri . Lebih umumnya, kita dapatmengganti ranking (yang mana integer 1,2,…,n) dengan fungsi skor a(i)=1,2,…,n, sehingga fungsi sasarannya menjadi :

min

β

∑

i=1 n

( y

i−x

i'β ) a(R

i)Jika kita menetapkan fungsi skor sama dengan ranking (ranks), a(i)=i, hasilnya disebut skor Wilcoxon. Kemungkinan lain adalah menggunakan

skor median, dimana a(i)=-1 jika

i< n+1

2 dan a(i)=1 jika

i> n+1

2 .C. PEMBAHASAN

1. PENERAPAN ESTIMASI M a. Estimasi M (Huber)

Data pengamatan penjualan rokok tahun 2012 di yogyakarta:

N o

Sales (y)

jml outlet

(X1)

iklan radio (X2)

iklan out (X3)

iklan koran

(X4)

1 215.36 7 13.23 27.9 20.98

2 295.15 5 13.44 32.28 22.41

3 254.26 10 15.26 29.49 22.98

4 452.62 5 18.45 39.17 23.21

5 150.5 8 19.58 34.25 23.25

6 320.14 8 12.03 33.63 23.45

7 254.25 6 13.87 29.38 24.86

8 235.26 9 15.69 29.19 24.88

9 302.21 9 16.35 32.82 25

1

0 120.35 8 12.88 33.44 25.12

1

1 222.32 8 18.97 29.14 25.87

1

2 265.99 11 12.05 32.09 25.89

1

3 300.12 7 12.23 32.33 26.23

1

4 265.21 5 15.87 30.22 26.23

1

5 110.6 6 13.67 35.42 26.25

1

6 323.45 9 18.29 33.72 28.94

1

7 362.02 8 15.26 35.84 29.8

1

8 423 5 13.56 37.12 32.26

1

9 400.23 9 18.78 36.1 32.79

2

0 412.6 6 13.02 36.85 33.45

2

1 423.22 7 16.59 37.44 33.98

2

2 400.25 9 14.23 36.15 34.55

2

3 366.25 9 15.26 35.92 34.76

2

4 435.23 8 15.78 38.2 35.99

2

5 430.22 10 13.33 37.91 36.21

2

6 352.16 9 12.89 34.79 36.25

2

7 365.21 8 12.45 35.91 36.87

2

8 415.25 8 19.25 36.96 36.99

2

9 451.29 8 14.32 38.98 40.12

3

0 512.33 8 13.45 39.33 44.98

Dilakukan uji asumsi terlebih dahulu, yakni : Pertama, uji normalitas :

150 100 50 0 -50 -100 -150 -200 -250 99

95 90 80 70 60 50 40 30 20 10 5

1

RESI1

Percent

Mean -1.65793E-13

StDev 62.06

N 30

KS 0.222

P-Value <0.010

Probability Plot of RESI1 Normal

Kedua, uji multikolinearitas :

Predictor Coef SE Coef T P VIF Constant -296.0 175.3 -1.69 0.104

X1 -5.272 8.390 -0.63 0.535 1.156 X2 2.149 5.398 0.40 0.694 1.042 X3 11.127 5.882 1.89 0.070 2.480 X4 8.380 3.215 2.61 0.015 2.595

Karena nilai VIF yang kecil mengindikasikan tidak ada multikolinearitas.

Ketiga, uji homoskedasitas :

30 28 26 24 22 20 18 16 14 12 10 8 6 4 2 100

50 0 -50 -100 -150 -200

Observation Order

Residual

Versus Order (response is Y)

Keempat, uji autokorelasi :

Durbin-Watson statistic = 2.19514

Karena nilai durbin Watson mendekati 2 menunjukkan tidak ada autokorelasi.

Output minitab :

b.

c.

17

The regression equation is

Y = - 296 - 5.27 X1 + 2.15 X2 + 11.1 X3 + 8.38 X4

Predictor Coef SE Coef T P Constant -296.0 175.3 -1.69 0.104 X1 -5.272 8.390 -0.63 0.535 X2 2.149 5.398 0.40 0.694 X3 11.127 5.882 1.89 0.070 X4 8.380 3.215 2.61 0.015

S = 66.8377 R-Sq = 64.0% R-Sq(adj) = 58.2%

Analysis of Variance

Source DF SS MS F P Regression 4 198473 49618 11.11 0.000 Residual Error 25 111682 4467

Total 29 310155

Source DF Seq SS X1 1 22 X2 1 268 X3 1 167831 X4 1 30352

Unusual Observations

Obs X1 Y Fit SE Fit Residual St Resid 4 5.0 452.6 347.6 46.6 105.0 2.19R 5 8.0 150.5 279.8 31.8 -129.3 -2.20R 10 8.0 120.3 272.1 21.8 -151.7 -2.40R 15 6.0 110.6 315.8 23.3 -205.2 -3.28R

d.

e.

f.

g.

h.

i.

j.

k.

l.

m.

n.

o.

p.

q.

r.

s.

t.

u. Dengan menggunakan minitab didapatkan model regresinya adalah :

v. Y = - 296 - 5.27 X1 + 2.15 X2 + 11.1 X3 + 8.38 X4

w. Model tersebut merupakan hasil metode OLS.

x.

y.

z.

aa.

ab.

Didapatkan model : Y = - 296 - 5.27 X1 + 2.15 X2 + 11.1 X3 + 8.38 X4

Kemudian dilakukan pengujian dengan nilai standarized residual, dan DFITS. Hasilnya sebagai berikut :

Berdasarkan nilai standarized residual dan DFITS bahwa observasi ke 4, 5, 10, dan 15 terindikasi sebagai outlier.

ac. Untuk penentuan nilai bobotnya menggunakan fungsi influence dan fungsi pembobot Huber, sebagai

berikut : ad.

ae. Dengan menggunakan minitab, maka di dapatkan model regresi untuk tiap iterasi sebagai berikut :

af.

It ag. Model regresi

ah.

1

ai. Y = - 288 - 5.10 X1 + 0.42 X2 + 13.4 X3 + 6.55 X4

aj.

2

ak. Y = - 312 - 5.03 X1 + 0.89 X2 + 14.4 X3 + 6.00 X4

al.

3

am. Y = - 307 - 5.14 X1 + 0.78 X2 + 14.2 X3 + 6.10 X4

an.

4

ao. Y = - 308 - 5.06 X1 + 0.81 X2 + 14.3 X3 + 6.07 X4

ap.

5

aq. Y = - 308 - 5.10 X1 + 0.80 X2 + 14.3 X3 + 6.08 X4

ar.

6

as. Y = - 308 - 5.08 X1 + 0.80 X2 + 14.3 X3 + 6.08 X4

at.

7

au. Y = - 308 - 5.09 X1 + 0.80 X2 + 14.3 X3 + 6.08 X4

av.

8

aw. Y = - 308 - 5.09 X1 + 0.80 X2 + 14.3 X3 + 6.08 X4

ax. Sehingga model regresi robust untuk estimasi M adalah :

ay. Y = - 308 - 5.09 X1 + 0.80 X2 + 14.3 X3 + 6.08 X4

az. Kemudian dilakukan uji secara serentak (apakah keragaman Y dapat dijeaskan oleh model regresi X terhadap Y signifikan secara statistik?) dan uji individu (apakah peubah Xi berpengaruh terhadap peubah Y apabila peubah lainnya tetap?). hasil output minitab sebagai berikut :

ba.

bb.

bc.

bd.

be.

bf.

bg.

bh.

bi.

bj.

bk.

bl.

bm.

bn.

bo.

bp.

bq.

br.

bs.

21

Weighted analysis using weights in W(e*)8

The regression equation is

Y = - 308 - 5.09 X1 + 0.80 X2 + 14.3 X3 + 6.08 X4

Predictor Coef SE Coef T P Constant -307.8 136.1 -2.26 0.033 X1 -5.088 6.394 -0.80 0.434 X2 0.802 4.239 0.19 0.851 X3 14.260 4.687 3.04 0.005 X4 6.077 2.586 2.35 0.027 S = 50.3678 R-Sq = 74.0% R-Sq(adj) = 69.8%

Analysis of Variance

Source DF SS MS F P Regression 4 180198 45049 17.76 0.000 Residual Error 25 63423 2537

Total 29 243621 Source DF Seq SS

X1 1 74 X2 1 82 X3 1 166034 X4 1 14008 Unusual Observations

Obs X1 Y Fit SE Fit Residual St Resid 5 8.0 150.50 296.88 26.14 -146.38 -2.38R 10 8.0 120.35 291.32 17.28 -170.97 -2.55R 15 6.0 110.60 337.23 19.07 -226.63 -3.08R

bt.

bu.

bv.

bw.

bx. Untuk uji serentak didapatkan p-value sebesar 0.000 yang lebih kecil dari alpha sebesar 0.05, sehingga secara statistik keragaman Y dapat dijeaskan oleh model regresi X terhadap Y signifikan. Untuk uji individu didapatkan peubah X1 dan X2 tidak signifikan, namun ini masih lebih baik dari model regresi non robust dimana ada empat peubah yang tidak signifikan yakni constant, peubah X1, X2, dan X3.

by. b. Estimasi M (Tukey Bisquare)

bz. Dengan menggunakan minitab didapatkan model regresinya adalah :

ca. Y = - 296 - 5.27 X1 + 2.15 X2 + 11.1 X3 + 8.38 X4

cb. Model tersebut merupakan hasil metode OLS.

cc. Dengan menggunakan minitab, maka di dapatkan model regresi untuk tiap iterasi sebagai berikut :

cd.

Iter a s i k e

ce. Model regresi

cf. 1 cg. Y = - 290 - 5.77 X1 + 0.09 X2 + 14.1 X3 + 6.19 X4

ch.

2

ci. Y = - 317 - 4.58 X1 + 0.99 X2 + 14.5 X3 + 5.85 X4

cj. 3 ck. Y = - 303 - 6.12 X1 + 0.29 X2 + 14.8 X3 + 5.83 X4

cl. 4 cm. Y = - 316 - 4.33 X1 + 1.00 X2 + 14.4 X3 + 5.87 X4

cn.

5

co. Y = - 302 - 6.34 X1 + 0.28 X2 + 14.8 X3 + 5.85 X4

cp.

6

cq. Y = - 317 - 4.04 X1 + 1.08 X2 + 14.3 X3 + 5.91 X4

cr. 7 cs. Y = - 301 - 6.59 X1 + 0.25 X2 + 14.8 X3 + 5.89 X4

ct. 8 cu. Y = - 318 - 3.71 X1 + 1.19 X2 + 14.2 X3 + 5.97 X4

cv.9 cw. Y = - 299 - 6.85 X1 + 0.21 X2 + 14.8 X3 + 5.94 X4

cx.1 0

cy. Y = - 320 - 3.38 X1 + 1.31 X2 + 14.0 X3 + 6.04 X4

cz.1 1

da. Y = - 297 - 7.07 X1 + 0.17 X2 + 14.7 X3 + 6.00 X4

db. dc. Y = - 321 - 3.09 X1 + 1.43 X2 + 13.9 X3 + 6.10 X4

12 dd.

13

de. Y = - 295 - 7.24 X1 + 0.14 X2 + 14.7 X3 + 6.06 X4

df. 1 4

dg. Y = - 321 - 2.89 X1 + 1.51 X2 + 13.8 X3 + 6.15 X4

dh.

15

di. Y = - 293 - 7.35 X1 + 0.13 X2 + 14.6 X3 + 6.11 X4

dj. 1 6

dk. Y = - 322 - 2.76 X1 + 1.57 X2 + 13.7 X3 + 6.19 X4

dl. 1 7

dm. Y = - 293 - 7.42 X1 + 0.12 X2 + 14.6 X3 + 6.14 X4

dn.

18

do. Y = - 322 - 2.69 X1 + 1.60 X2 + 13.6 X3 + 6.21 X4

dp.

19

dq. Y = - 292 - 7.45 X1 + 0.11 X2 + 14.6 X3 + 6.15 X4

dr. 2 0

ds. Y = - 322 - 2.65 X1 + 1.62 X2 + 13.6 X3 + 6.22 X4

dt.2 1

du. Y = - 292 - 7.47 X1 + 0.11 X2 + 14.6 X3 + 6.16 X4

dv.

22

dw. Y = - 322 - 2.63 X1 + 1.62 X2 + 13.6 X3 + 6.23 X4

dx.

23

dy. Y = - 292 - 7.48 X1 + 0.11 X2 + 14.6 X3 + 6.16 X4

dz.

24

ea. Y = - 322 - 2.62 X1 + 1.63 X2 + 13.6 X3 + 6.23 X4

eb.

25

ec. Y = - 292 - 7.48 X1 + 0.11 X2 + 14.6 X3 + 6.17 X4

ed.

26

ee. Y = - 322 - 2.62 X1 + 1.63 X2 + 13.6 X3 + 6.23 X4

ef. 2 7

eg. Y = - 292 - 7.49 X1 + 0.11 X2 + 14.6 X3 + 6.17 X4

eh.

ei. Dalam kasus ini, ternyata model regresi robust dengan tukey bisquare konvergen ke dua model yakni :

ej. Y = - 322 - 2.62 X1 + 1.63 X2 + 13.6 X3 + 6.23 X4

ek.

R

el. R - s q u a r e a

em. Uj i F

en. Uji T

d j

eo.

7

ep. 6 5 . 7

%

eq. si gn if ik an

er. X1 dan X2 tidak signifikan

es. Dan

et. Y = - 292 - 7.49 X1 + 0.11 X2 + 14.6 X3 + 6.17 X4

eu.

R

ev. R - s q u a r e a d j

ew. Uj i F

ex. Uji T

ey.

7

ez. 7 3 . 6

%

fa. si gn if ik an

fb. X1 dan X2 tidak signifikan fc.

fd. Sehingga model terpilih adalah Y = - 292 - 7.49 X1 + 0.11 X2 + 14.6 X3 + 6.17 X4

fe.

ff.

fg.

fh.

fi.

fj.

fk.

fl.

2. PENERAPAN ESTIMASI LTS

fm. Langkah awal untuk menentukan h dimana

h= n+ p+1

2 dan

E2LTS=

∑

i=1 h

ei2 digunakan model hasil dari OLS. Didapatkan

E

2LTS=5798.007 dan h = 18 yang artinya 18 data baru (telah diurutkan

secara ascending berdasarkan

e

i2 yang akan digunakan untuk estimasi LTS iterasi ke 1, hasil output minitabnya sebagai berikut :fn.

fo.

fp.

fq.

fr.

fs.

ft.

fu.

fv.

fw.

fx.

fy.

fz. Dengan

E

2LTS=577,9835 .ga. nilai h baru untuk iterasi ke 2 adalah 12 yang artinya 12 data baru yang akan digunakan, hasil output minitab sebagai berikut :

gb.

gc.

gd.

ge.

gf.

gg.

gh.

gi.

gj.

gk.

gl. Dengan

E

2LTS=183.79 .gm. nilai h baru untuk iterasi ke 3 adalah 9 yang artinya 9 data baru yang akan digunakan, hasil output minitab sebagai berikut : gn.

go.

gp.

25

The regression equation is

Y = - 365 - 5.34 X1 + 0.28 X2 + 18.3 X3 + 3.92 X4 Predictor Coef SE Coef T P

Constant -364.95 51.16 -7.13 0.000 X1 -5.342 2.276 -2.35 0.035 X2 0.275 1.493 0.18 0.857 X3 18.315 2.239 8.18 0.000 X4 3.921 1.361 2.88 0.013 S = 13.5080 R-Sq = 98.0% R-Sq(adj) = 97.4%

Analysis of Variance

Source DF SS MS F P Regression 4 117648 29412 161.19 0.000 Residual Error 13 2372 182

Total 17 120020 Source DF Seq SS

X1 1 250 X2 1 2156 X3 1 113729 X4 1 1514 Unusual Observations

Obs X1 Y Fit SE Fit Residual St Resid 2 8.0 512.33 492.72 9.57 19.61 2.06R R denotes an observation with a large standardized residual.

The regression equation is

Y = - 308 - 5.07 X1 - 1.55 X2 + 15.8 X3 + 5.69 X4 Predictor Coef SE Coef T P

Constant -307.54 38.89 -7.91 0.000 X1 -5.069 1.351 -3.75 0.007 X2 -1.547 1.114 -1.39 0.207 X3 15.831 2.167 7.30 0.000 X4 5.689 1.676 3.39 0.012 S = 7.56569 R-Sq = 99.5% R-Sq(adj) = 99.2%

Analysis of Variance

Source DF SS MS F P Regression 4 78567 19642 343.15 0.000 Residual Error 7 401 57

Total 11 78967 Source DF Seq SS X1 1 0 X2 1 114 X3 1 77793 X4 1 659

The regression equation is

Y = - 345 - 5.39 X1 - 1.49 X2 + 16.9 X3 + 5.67 X4 Predictor Coef SE Coef T P

Constant -344.89 30.14 -11.44 0.000 X1 -5.3908 0.8230 -6.55 0.003 X2 -1.4929 0.7848 -1.90 0.130 X3 16.889 1.411 11.97 0.000 X4 5.675 1.042 5.45 0.006 S = 4.03036 R-Sq = 99.9% R-Sq(adj) = 99.8%

Analysis of Variance

Source DF SS MS F P Regression 4 57117 14279 879.07 0.000 Residual Error 4 65 16

Total 8 57182 Source DF Seq SS

X1 1 26 X2 1 766

gq.

gr.

gs.

gt.

gu.

gv.

gw.

gx.

gy. Dengan

E

2LTS=37.5484 .

gz. nilai h baru untuk iterasi ke 4 adalah 8 yang artinya 8 data baru yang akan digunakan, hasil output minitab sebagai berikut : ha.

hb.

hc.

hd.

he.

hf.

hg.

hh.

hi.

hj.

hk.

hl. Dengan

E

2LTS=126.7744 . hm.hn.

ho.

hp.

hq. nilai h baru untuk iterasi ke 5 adalah 7 yang artinya 7 data baru yang akan digunakan, hasil output minitab sebagai berikut : hr.

hs.

ht.

26

The regression equation is

Y = - 321 - 5.17 X1 - 2.00 X2 + 15.7 X3 + 6.39 X4 Predictor Coef SE Coef T P

Constant -321.32 21.06 -15.26 0.001 X1 -5.1693 0.5277 -9.80 0.002 X2 -2.0034 0.5330 -3.76 0.033 X3 15.7200 0.9969 15.77 0.001 X4 6.3890 0.7129 8.96 0.003 S = 2.55122 R-Sq = 100.0% R-Sq(adj) = 99.9%

Analysis of Variance

Source DF SS MS F P Regression 4 52540 13135 2018.07 0.000 Residual Error 3 20 7

Total 7 52560 Source DF Seq SS

X1 1 54 X2 1 1208 X3 1 50755 X4 1 523

The regression equation is

Y1 = - 334 - 5.56 X11 - 1.45 X21 + 16.6 X31 + 5.57 X41 Predictor Coef SE Coef T P

Constant -333.999 9.930 -33.63 0.001 X11 -5.5644 0.2569 -21.66 0.002 X21 -1.4483 0.2802 -5.17 0.035 X31 16.6446 0.5079 32.77 0.001 X41 5.5721 0.3862 14.43 0.005 S = 1.12714 R-Sq = 100.0% R-Sq(adj) = 100.0%

Analysis of Variance

Source DF SS MS F P Regression 4 45404 11351 8934.59 0.000 Residual Error 2 3 1

Total 6 45406 Source DF Seq SS

X11 1 958 X21 1 222

hu.

hv.

hw.

hx.

hy.

hz.

ia.

ib.

ic. Dengan

E

2LTS=20.2058 .

id. Iterasi berhenti sampai iterasi ke 5 karena nilai h pada itreasi ke 6 sama dengan iterasi ke 5 yakni 7.

ie.

if.

ig.

ih.

ii.

ij.

ik.

il.

im.

in.

io.

ip.

iq.

ir.

is.

it.

D. DAFTAR PUSTAKA

iu. Bambang J. 2009. Ekonometrika: Pemodelan dan Pendugaan. Bogor (ID): IPB Pr.

iv.

iw. Chen C. 2002. Robust Regression and Outlier Detection with the Robustreg Procedure. Paper 265-27, Statistics and Data Analysis, SUGI 27, North Carolina: SAS Institute Inc.

ix.

iy. Draper NR, Smith. 1992. Analisis Regresi Terapan. Diterjemahkan oleh Bambang Sumantri. Jakarta (ID): Gramedia.

iz.

ja. Montgomery DC, Peck EA. 1992. Introduction to Linear Regression Analysis. New York (NY): John Wiley and Sons.

jb.

jc. Musarifah, Raupong, Nasrah S. Perbandingan Metode Robust Least Trimmed Square Dengan Metode Scale Dalam Mengestimasi

Parameter Regresi Linear Berganda Untuk Data Yang Mengandung Pencilan. [Internet]. Makassar (ID). [diunduh 2016 jam 14:28 WIB].

Tersedia pada:

http://repository.unhas.ac.id/bitstream/handle/123456789/13647/JUR NAL.pdf?sequence=1

jd.je. Paper Robust.

jf.jg. Rokhdana DB. Regresi Robust Dengan M-Estimation.

jh.ji. Ryan TP. 1997. Modern Regression Methods. Canada: John Wiley &

Sons Inc.

jj.jk. Yuliana S, Hasih P, Sri SH. 2013. Optimasi Model Regresi Robust Untuk Memprediksi Produksi Kedelai di Inodonesia. [Internet]. Yogyakarta (ID). [diunduh 2016 jam 17:45 WIB]. Tersedia pada:

https://core.ac.uk/download/files/335/18454387.pdf

jl.jm. Yuliana. 2014. Penerapan Model Regresi Linear Robust Dengan Estimasi M Pada Data Nilai Kalkulus II Mahasiswa Universitas Widya Dharma Klaten. Magistra No. 90 Th. XXVI [Internet]. Hlm 87 – 97;

[diunduh 2016 jam 09:46 WIB]. Tersedia pada:

http://download.portalgaruda.org/article.php?

article=298460&val=6820&title=PENERAPAN%20MODEL

%20REGRESI%20LINEAR%20ROBUST%20DENGAN%20ESTIMASI

%20M%20PADA%20DATA%20NILAI%20KALKULUS%20II

%20MAHASISWA%20UNIVERSITAS%20WIDYA%20DHARMA

%20KLATEN

jn.

jo.

jp.

jq.

jr.

js.