LAPORAN AKHIR

PENELITIAN LABORATORIUM

DANA ITS 2020

Sistem Deteksi Dan Pelacakan Benda Pada Lintasan Kendaraan Berbasis

Citra RGB-D Untuk Mendukung Self-Driving Car

Tim Peneliti :

Muhammad Attamimi, B.Eng.,M.Eng.,Ph.D. (Teknik Elektro/FTEIC)

Ir. Hendra Kusuma M.Eng.Sc. (Teknik Elektro/FTEIC)

Atar Fuady Babgei S.T., M.Sc. (Teknik Biomedik/FTEIC)

DIREKTORAT RISET DAN PENGABDIAN KEPADA MASYARAKAT

INSTITUT TEKNOLOGI SEPULUH NOPEMBER

SURABAYA

i

Daftar Isi

Daftar Isi ... i

Daftar Tabel ... ii

Daftar Gambar ... iii

Daftar Lampiran ... iv

BAB I RINGKASAN ... 1

BAB II HASIL PENELITIAN ... 2

BAB III STATUS LUARAN ... 6

BAB IV PERAN MITRA (UntukPenelitian Kerjasama Antar Perguruan Tinggi) ... 7

BAB V KENDALA PELAKSANAAN PENELITIAN ... 8

BAB VI RENCANA TAHAPAN SELANJUTNYA ... 9

BAB VII DAFTAR PUSTAKA ... 10

BAB VIII LAMPIRAN ... 12

iii

Daftar Gambar

1. Gambar 1. Desain sistem pada laporan kemajuan ………... 2 2. Gambar 2. Screenshot code deteksi jalan dalam Python ..………... 3 3. Gambar 3. Contoh deteksi jalan yang diimplementasikan dalam penelitian ini ..……… 4 4. Gambar 4. Desain akhir sistem dalam penelitian ini ………... 4

1

BAB I RINGKASAN

Sistem deteksi dan pelacakan benda adalah sistem yang mampu menentukan posisi suatu benda dan mengikuti posisi benda tersebut. Implementasi sistem ini kedalam sistem cerdas dan/atau mesin cerdas seperti self-driving car menjadi sangat penting karena sistem tersebut mampu menentukan lokasi dari benda-benda yang berada dalam jangkauannya (yakni diatas lintasan pada self-driving car) setiap saat. Penentuan lokasi tersebut menjadi salah satu parameter bagi self-driving car untuk memutuskan gerakannya seperti apakah harus berhenti, mendahului, berbelok ke kiri atau ke kanan.

Dalam penelitian ini citra warna (RGB) dan depth (D) atau disebut citra RGB-D yang diambil dari kamera RGB-D akan digunakan sebagai input dari sistem. Masing-masing komposisi dari citra yang diambil memiliki keunggulan dan kekurangan. Pada pencahayaan yang normal citra warna lebih deskriptif dibandingkan citra depth. Namun pencahayaan yang kurang bagus menjadikan kelemahan citra warna. Sebaliknya walaupun cenderung tidak deskriptif citra depth lebih stabil terhadap pencahayaan dan juga lebih akurat dalam menghitung jarak dan ukuran benda. Oleh karena itu kombinasi kedua citra yakni citra RGB-D digunakan disini.

Permasalahan yang dihadapi dalam relealisasi sistem yang diajukan adalah 1) Variasi dari jenis benda yang akan dideteksi, dan 2) Lokasi dan/atau orientasi dari benda yang termuat dalam citra input. Permasalahan pertama dapat diatasi dengan verifikasi benda yang menjadi target dengan database atau bisa disebut sebagai identifikasi benda. Permasalahan kedua dapat diselesaikan dengan mengajukan beberapa hipotesa tentang lokasi dan/atau orientasi dari target benda; tentunya juga dengan mempertimbangkan bentuk dan ukuran benda tersebut. Dalam penelitian ini, kedua masalah diatas akan diselesaikan dengan menggunakan metode Deep Learning. Transfer learning akan dilakukan untuk menambah akurasi dari model yang dibuat.

Kontribusi dari penelitian ini adalah sistem yang mampu mendeteksi dan melacak benda dengan input berupa citra RGB-D. Output dari sistem berupa lokasi benda yang dapat dimanfaatkan untuk menghitung jarak, orientasi, maupun kecepatan relatif benda yang bergerak. Manfaat tersebut diharapkan memudahkan realisasi self-driving car.

Ringkasan penelitian berisi latar belakang penelitian,tujuan dan tahapan metode penelitian, luaran yang ditargetkan, kata kunci

BAB II HASIL PENELITIAN

Dalam penelitian ini pertama dilakukan studi pustaka untuk mendalami teori, desain sistem, dan juga proses implementasi dari sistem yang diusulkan. Penelitian ini berhubungan berhubungan dengan self-driving car [1, 2, 3], visual recognition systems [4, 5], object detection [6, 7], dan object recognition [8, 9, 10, 11, 12, 13]. Pada penelitian tentang self-driving car banyak teknik-teknik yang dapat diambil seperti penggunaan sensor dan penempatan sensor tersebut dalam mobil tanpa awak.

Untuk memudahkan implementasi dan integrasi pada iCAR, peneliti berencana menggunakan desain dengan berdasar pada prinsip komunikasi dengan menggunakan middleware. Dalam penelitian ini, kami memutuskan akan memakai Robot Operating System (ROS) [14]. Tentunya proses implementasi dari sistem akan berdasar pada ROS tersebut.

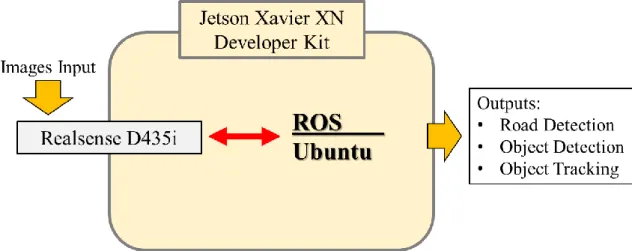

Gambar 1. Desain sistem pada laporan kemajuan.

Hasil dari kemajuan penelitian berikutnya adalah desain sistem yang ditunjukkan pada Gambar 1. Seperti diuraikan diatas bahwa sistem dibuat berdasarkan middleware ROS yang diimplementasikan untuk media komunikasi sensor-sensor yang dipakai pada penelitian ini. Disini, akan dipakai Jetson Xavier XN [15] sebagai alat komputasi yang terintegrasi dengan kemampuan menghitung yang tinggi. Alat tersebut akan diinstal Ubuntu 18.04 [16] dan middleware ROS Melodic [17]. Dalam penelitian ini, proses pemahaman untuk pemakaian middleware memakan banyak waktu, sampai pada penulisan laporan kemajuan, peneliti masih belum menyelesaikan tahap belajar tersebut. Proses ini sangatlah diperlukan sebab untuk implementasi dan proses integrasi dengan sensor yang lain dibutuhkan pengetahuan tersebut.

Dalam desain sistem pada Gambar 1. terdapat proses deteksi jalan. Pada laporan kemajuan ini peneliti telah berhasil melakukan implementasi dengan menggunakan machine learning sederhana. Perpaduan antara color segmentation dengan logika jalan digunakan untuk pemisahan area jalan dan bukan jalan. Implementasi dilakukan dengan menggunakan program Python dengan screenshot code ditunjukkan pada Gambar 2. Pada tahapan ini peneliti menggunakan kamera biasa untuk menangkap gambar di lingkungan kampus ITS. Hasil dari gambar yang ditangkap kemudian diproses dengan algoritma yang dikembangkan dan output dari program yang diimplementasikan pada penelitian ini ditunjukkan pada Gambar 3. Deteksi jalan ini masih perlu disempurnakan.

3 Gambar 2. Screenshot code deteksi jalan dalam Python.

Gambar 3. Contoh deteksi jalan yang diimplementasikan dalam penelitian ini.

Kedepannya direncanakan implementasi dengan memanfaatkan semantic segmentation dengan menggunakan deep learning. Deteksi jalan ini bermanfaat untuk membatasi deteksi benda dengan asumsi bahwa benda yang menjadi fokus dalam penelitian ini adalah benda yang berada diatas lintasan jalan iCAR.

5 Setelah penulisan laporan kemajuan ada perubahan yang cukup signifikan dalam ketersediaan barang untuk keperluan penelitian ini. Kamera seperti Realsense D435i sempat menempati penawaran harga yang cukup tinggi. Dilain sisi muncul kamera tipe baru namun untuk pemesanannya menunggu waktu beberapa bulan. Dalam situasi yang sulit ini, setelah melakukan pendalaman peneliti akhirnya mengambil keputusan untuk mengoptimalkan dana penelitian supaya prototipe yang diusulkan dalam proposal realisasinya dapat didekati. Keputusan tersebut adalah dengan menunda pembelian dan memutuskan untuk mengganti sensor dengan yang lebih baru seperti Realsense D455 yang memiliki akurasi pengukuran jarak dua kali lipat dibandingkan dengan kamera Realsense D435i.

Akibat dari keputusan diatas, maka kami mendesain ulang sistem kami seperti ditunjukkan pada Gambar 4. Adapun daftar komponen yang akan dipakai dalam desain yang diusulkan adalah sebagai berikut:

1. Kamera Intel Realsense D455 2. Jetson Xavier XN Developer Kit 3. Pendingin

4. Cashing

5. Battery Management Systems 6. Battery

7. Charger 8. Adaptor

Dari sisi software, peneliti akan meneruskan pemakaian ROS Melodic yang diinstal pada Ubuntu Biotic pada perangkat komputasi Jetson Xavier XN. Disini, kami juga akan menambahkan fitur seperti Graphical User Interface (GUI) dengan memakai Qt untuk mempermudah pengguna dalam mengoperasikan sistem. Untuk fungsi dengan memakai kamera Realsense, peneliti telah membuat class untuk keperluan akses kamera. Namun dengan adanya ROS wrapper untuk Realsense, hasil tersebut perlu disesuaikan dalam implementasi sistem. Wrapper ini juga terus berkembang dan sempat berhenti beberapa waktu.

BAB III STATUS LUARAN

Pada penelitian ini dua luaran akan dihasilkan. Pertama, luaran yang berupa prototipe yang berbentuk hardware dan software. Pada saat ini, komponen telah berhasil dipesan, namun kedatangannya masih memerlukan waktu.

Berikutnya, pada penelitian ini luaran wajib berupa jurnal terindeks scopus minimal Q2. Peneliti berencana untuk submit pada “Bulletin of Electrical Engineering and Informatics” [18] dengan rencana judul “Object Detection and Tracking Using RGBD Image for Self-Driving Car”. Seperti diuraikan diatas, tahap implementasi dari sistem masih belum selesai, sehingga status luaran wajib masih belum ada.

7

BAB IV PERAN MITRA

(UntukPenelitian Kerjasama Antar Perguruan Tinggi)BAB V KENDALA PELAKSANAAN PENELITIAN

Kendala dalam pelaksanaan penelitian dapat diuraikan sebagai berikut. Pertama adalah proses belajar middeware baru. Untuk memahami konsep dan pemakaian dari middleware tersebut membutuhkan waktu yang cukup lama. Pada proses pembelajaran tersebut peneliti melakukan trial and error pada beberapa aspek seperti pemakaian OS, versi middleware yang dipakai, dan mencari kesesuaian dengan desain yang diusulkan. Kedua adalah dengan adanya COVID19 proses penelitian yang biasa dilakukan menjadi lebih susah terutama adalah proses pengadaan barang dan juga eksperimen di lapangan. Hal ini menyebabkan kendala pengadaan barang dialami oleh peneliti.

9

BAB VI RENCANA TAHAPAN SELANJUTNYA

Pada tahapan selanjutnya peneliti akan menyelesaikan proses belajar middleware ROS sampai pada tahap bisa mengimplementasikan sistem yang diusulkan. Paralel dengan kegiatan belajar, peneliti akan menunggu komponen yang telah dipesan. Tiap kedatangan komponen, peneliti akan melakukan implementasi sistem perbagian sehingga ketika komponen terkumpul dapat langsung melakukan integrasi.

Tahap berikutnya adalah implementasi object detection yang dimulai dengan desain network dalam Deep Learning dengan mengacu pada model-model yang memiliki performansi tinggi. Selanjutnya akan dilakukan penyesuaian dan dilakukan tuning parameter. Kami akan mengadopsi Transfer Learning untuk pengoptimalan model yang akan dipakai dalam penelitian ini.

Selanjutnya adalah implementasi sistem keseluruhan, pengambilan data, dan pengujian. Terakhir, hasil dari pengujian akan dirangkum dalam jurnal internasional dan juga laporan akhir.

BAB VII DAFTAR PUSTAKA

1. Taeihagh, Araz; Lim, Hazel Si Min (2 January 2019). "Governing autonomous

vehicles: emerging responses for safety, liability, privacy, cybersecurity, and industry

risks".

Transport

Reviews.

39

(1):

103–128.

arXiv:1807.05720.

doi:10.1080/01441647.2018.1494640. ISSN 0144-1647.

2. Thrun, Sebastian (2010). "Toward Robotic Cars". Communications of the ACM. 53

(4): 99–106. doi:10.1145/1721654.1721679.

3. Gehrig, Stefan K.; Stein, Fridtjof J. (1999). Dead reckoning and cartography using

stereo vision for an automated car. IEEE/RSJ International Conference on Intelligent

Robots and Systems. 3. Kyongju. pp. 1507–1512. doi:10.1109/IROS.1999.811692.

ISBN 0-7803-5184-3.

4. Tomoaki Nakamura, Muhammad Attamimi, Komei Sugiura, Takayuki Nagai, Naoto

Iwahashi, Tomoki Toda, Hiroyuki Okada, and Takashi Omori, “An Extended Mobile

Manipulation Robot Learning Novel Objects”, Journal of The Robotics Society of

Japan, vol.30, no.2, pp.213–224, 2012 (in Japanese)

5. Muhammad Attamimi, Takaya Araki, Tomoaki Nakamura, and Takayuki Nagai,

“Visual Recognition System for Cleaning Tasks by Humanoid Robots”, International

Journal of Advanced Robotic Systems: Humanoid, pp.1–14, 2013

6. Miriam Lopez-de-la-Calleja, Takayuki Nagai, Muhammad Attamimi, Mariko

Nakano-Miyatake, and Hector Perez-Meana, “Object Detection Using SURF and

Superpixels”, Journal of Software Engineering and Applications, vol.6, no.9,

pp.511–518, 2013

7. Muhammad Attamimi, Takayuki Nagai, and Djoko Purwanto, “Particle filter with

integrated multiple features for object detection and tracking”, Telkomnika, Vol. 16,

No. 6, pp. 3008-3015, December 2018

8. Alex Krizhevsky, “ImageNet Classification with Deep Convolutional Neural

Networks”, in Proc. NIPS 2012.

9. Osada R, Funkhouser T, Chazelle B, Dobkin D (2002) Shape Distributions. ACM

Transactions on Graphics. 21 :4 pp. 807-832.

10. Lowe D. G (2004) Distinctive Image Features from Scale-Invariants Keypoints. J. of

Computer Vision 60 :2 pp. 91-110.

11. Csurka G, Dance C, Fan L, Williamowski J, Bray C (2004) Visual Categorization

with Bags of Keypoints. Int. Workshop on Statistical Learning in Computer Vision.

pp.1-22.

12. Attamimi M, Mizutani A, Nakamura T, Nagai T, Funakoshi K, Nakano M (2010)

Real-Time 3D Visual Sensor for Robust Object Recognition. Int. Conf. on IROS. pp.

4560-4565.

13. Nowak E, Jurie F, Triggs B (2006) Sampling Strategies for Bag-of-Features Image

Classification. Int. Conf. on ECCV. 3954 pp.490-503.

14. https://www.ros.org/

11

16. https://releases.ubuntu.com/18.04/

17. http://wiki.ros.org/melodic

18. Bulletin of Electrical Engineering and Informatics: http://beei.org/index.php/

EEI/index.

13