2.2 Contoh Perhitungan Backpropagation1

Teks penuh

Gambar

Dokumen terkait

simetris. Pada jaringan neural network setiap unit- unit pada input layer

Templat input perkataan dan parameter seperti pemberat lapisan input- tersembunyi dan lapisan tersembunyi-output yang menghasilkan ketepatan set latihan terbaik digunakan oleh

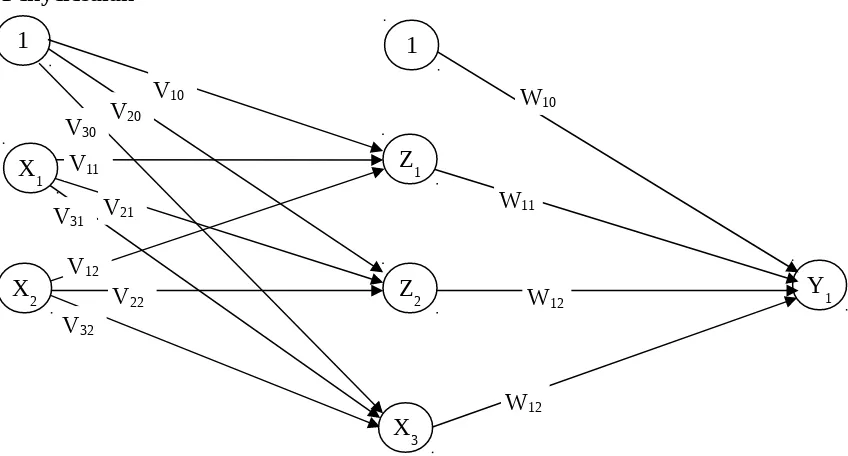

Jaringan lapis banyak terdiri dari satu lapisan input, satu lapisan output dan satu atau lebih hidden layer yang terletak diantara lapisan input dan lapisan output seperti yang

Jaringan lapis banyak terdiri dari satu lapisan input , satu lapisan output dan satu atau lebih hidden layer yang terletak diantara lapisan input dan lapisan output seperti

Dalam bentuk paling sederhana dari Jaringan Saraf Tiruan dengan satu layer, kita mempunyai sebuah input layer dari node sumber di mana informasi diproyeksikan ke output

Dimana ft adalah nilai dari forget gate, Wf adalah bobot untuk nilai input pada waktu ke t, xt adalah nilai input pada waktu ke t, Uf adalah bobot untuk nilai output dari waktu ke t-1,

𝛿𝑛𝑒𝑡𝑗 = Sinyal Faktor koreksi dari output layer ke hidden layer ke-j 𝛿𝑘 = Faktor koresi dari neuron output ke-k 𝑊𝑗𝑘 = Bobot yang menghubungkan hidden ke-j dan output ke-k 5 Menghitung

𝛿𝛿𝑀𝑀𝑍𝑍𝐷𝐷𝑗𝑗 = Sinyal Faktor koreksi dari output layer ke hidden layer ke-j 𝛿𝛿𝑘𝑘 = Faktor koresi dari neuron output ke-k 𝑊𝑊𝑗𝑗𝑘𝑘 = Bobot yang menghubungkan hidden ke-j dan output ke-k 5