INEZA NUR OKTABRONI

DEPARTEMEN ILMU KOMPUTER

FAKULTAS MATEMATIKA DAN ILMU PENGETAHUAN ALAM INSTITUT PERTANIAN BOGOR

PENGENALAN SIDIK JARI MENGGUNAKAN RESILIENT BACKPROPAGATION NEURAL NETWORK

DENGAN PRAPROSES TRANSFORMASI WAVELET

Skripsi

Sebagai salah satu syarat untuk memperoleh gelar Sarjana Komputer pada Fakultas Matematika dan Ilmu Pengetahuan Alam

Institut Pertanian Bogor

Oleh : Ineza Nur Oktabroni

G64104094

DEPARTEMEN ILMU KOMPUTER

FAKULTAS MATEMATIKA DAN ILMU PENGETAHUAN ALAM INSTITUT PERTANIAN BOGOR

ABSTRAK

INEZA NUR OKTABRONI. Pengenalan Sidik Jari Menggunakan Resilient Backpropagation

Neural Network Dengan Praproses Transformasi Wavelet. Dibimbing oleh AZIZ KUSTIYO dan

ARIEF RAMADHAN.

Sistem pengenalan biometrik menggunakan karakteristik fisiologis yang dimiliki manusia sebagai dasar dari pengenalannya. Karakteristik fisiologis yang digunakan harus bersifat unik, permanen, dan universal. Sidik jari memiliki semua karakteristik tersebut sehingga digunakan sebagai dasar pengenalan dalam penelitian ini.

Data yang digunakan pada penelitian ini berjumlah 70 buah sidik jari yang diperoleh dari situs internet pada alamat http://www.bias.csr.unibo.it/fvc2000/databases.asp. Sidik jari tersebut diambil dari 10 orang berbeda dengan 7 posisi pengambilan yang serupa. Data akan mengalami transformasi wavelet sebanyak enam level dengan menerapkan bank filter wavelet. Induk wavelet yang digunakan pada penelitian ini adalah Haar. Citra yang akan digunakan pada proses pengenalan sidik jari adalah citra pendekatan hasil dekomposisi wavelet level 1, level 2, level 3, level 4, level 5, dan level 6.

Sistem pengenalan sidik jari yang digunakan pada penelitian ini adalah Jaringan Syaraf Tiruan Propagasi Balik karena dinilai sangat baik untuk mengenali pola-pola yang kompleks. Parameter yang diamati pada penelitian ini adalah nilai generalisasi maksimum untuk mendapatkan kombinasi jumlah hidden neuron, toleransi kesalahan, dan level dekomposisi wavelet.

Penelitian ini menghasilkan nilai generalisasi maksimum sebesar 93.33% pada dekomposisi wavelet level 5 dan 6. Generalisasi minimum rata-rata terjadi pada jumlah hidden neuron 10. Jaringan syarat tiruan propagasi balik mencapai generalisasi maksimum pada kombinasi dekomposisi wavelet level 5 dan toleransi kesalahan 0.001.

To Ilkomerz 41

Time goes by We change along the way People come and pass me by Wish our memories will always stay (Ineza 2008)

As we go on we remember All the times we had together This our last chance

Come whatever

We will still be friends forever (Graduation Song, Vit C)

Thank You So Much…

Judul : Pengenalan Sidik Jari Menggunakan Resilient Backpropagation Neural

Network dengan Praproses Transformasi Wavelet

Nama : Ineza Nur Oktabroni

NIM :

G64104094

Menyetujui:

Pembimbing I,

Aziz Kustiyo, S.Si., M.Kom

NIP 132206241

Pembimbing II,

Arief Ramadhan, S.Kom

Mengetahui:

Dekan Fakultas Matematika dan Ilmu Pengetahuan Alam

Institut Pertanian Bogor

Tanggal lulus :

Dr. Drh. Hasim, DEA

NIP 131578806

kakak perempuan yang bernama Desmawati, S.Pi dan satu adik perempuan yang bernama Alisa Ananda Mardani.

Setelah tamat dari Sekolah Lanjut Tengah Pertama (SLTP) Negeri 75 Jakarta pada tahun 2001, penulis melanjutkan pendidikannya di Sekolah Menengah Umum Negeri 65 Jakarta pada tahun yang sama. Penulis melanjutkan pendidikannya ke Ilmu Komputer Institut Pertanian Bogor melalui jalur Saringan Penerimaan Mahasiswa Baru (SPMB) pada tahun 2004. Pada bulan Juli-Agustus 2007, penulis melaksanakan kegiatan praktek kerja lapang di Departemen Sosial Republik Indonesia divisi Pusat Data dan Informasi Kesejahteraan Sosial.

PRAKATA

Puji dan syukur penulis ucapkan kepada Allah SWT yang telah memberikan semua rahmat dan karuniaNya sehingga penulis dapat menyelesaikan tulisan ini. Tidak lupa salawat dan salam penulis ucapkan kepada junjungan besar kita Nabi Muhammad SAW yang telah memberikan banyak teladan bagi penulis.

Tulisan ini akhirnya dapat diselesaikan oleh penulis setelah melalui banyak hambatan. Karena itu, penulis ingin mengucapkan terima kasih kepada semua pihak yang telah membantu penulis, diantaranya :

1 Mama, Papa, Kakak, dan Adikku tersayang. Penulis mempersembahkan tulisan ini untuk kalian.

2 Bapak Aziz Kustiyo, S.Si, M.Kom dan Bapak Arief Ramadhan, S.Kom sebagai pembimbing pertama dan pembimbing kedua penulis, yang telah memberikan banyak saran, bantuan, serta motivasi bagi penulis.

3 Bapak Ir.Agus Buono, M.Si, M.Kom sebagai moderator seminar dan dosen penguji pada ujian akhir penulis.

4 Noven Himan dan Irfan Pratama sebagai pembahas pada seminar tulisan ini.

5 Denny Setia Mulyadi. Terimakasih untuk dukungan, semangat, motivasi, dan waktu untuk mendengarkan semua keluh kesah penulis.

6 Anizza Restra, Popi Hariona, Marissa Anggraeni, Irvan Lewenusa, Gananda Hayardisi. Terima kasih telah menjadi sahabat-sahabat terbaik penulis.

7 Restu, Roni, Nur, Ganang, teman-teman satu bimbingan skripsi.

8 Ilkomerz 41. Terima kasih untuk semua saat menyenangkan yang kalian berikan kepada penulis.

9 Keluarga besar Pondok Sabrina, Biblio Butaflika, Rini Ariani, Yuli Fitriyani, Wellya Septin, Anggia Anggraini. Terima kasih telah menjadi teman, sahabat, dan keluarga penulis. Semoga kita tetap menjadi keluarga sampai seterusnya.

Penulis juga mengucapkan terima kasih kepada pihak-pihak lain yang telah membantu penulis menyelesaikan tulisan ini. Maaf penulis tidak dapat menyebutkan satu persatu. Semoga tulisan ini dapat bermanfaat.

Bogor, Juli 2008

DAFTAR ISI

Halaman

DAFTAR TABEL ... vi

DAFTAR GAMBAR ... vi

DAFTAR LAMPIRAN ... vii

PENDAHULUAN ... 1

Latar Belakang ... 1

Tujuan Penelitian ... 1

Ruang Lingkup Penelitian... 1

Manfaat Penelitian ... 1

TINJAUAN PUSTAKA ... 1

Sidik Jari ... 1

Jaringan Syaraf Tiruan ... 2

Jaringan Syaraf Tiruan Propagasi Balik ... 2

Resilient Backpropagation (RPROP) ... 3

Wavelet ... 3

Transformasi Haar-Wavelet ... 4

METODE PENELITIAN ... 5

Data ... 5

Transformasi Wavelet ... 5

Proses Pengenalan Sidik Jari ... 5

Tahapan Pengenalan Sidik Jari ... 6

Generalisasi ... 6

Lingkup Pengembangan Sistem ... 6

HASIL DAN PEMBAHASAN ... 6

Percobaan 1: Dekomposisi Wavelet Level 1 ... 7

Percobaan 2: Dekomposisi Wavelet Level 2 ... 8

Percobaan 3: Dekomposisi Wavelet Level 3 ... 9

Percobaan 4: Dekomposisi Wavelet Level 4 ... 10

Percobaan 5: Dekomposisi Wavelet Level 5 ... 11

Percobaan 6: Dekomposisi Wavelet Level 6 ... 12

Perbandingan Generalisasi ... 13

Perbandingan Konvergensi Jaringan Syaraf Tiruan yang Digunakan ... 13

KESIMPULAN DAN SARAN ... 14

Kesimpulan ... 14

Saran ... 14

DAFTAR PUSTAKA ... 14

DAFTAR TABEL

Halaman

1 Parameter percobaan ... 5

2 Definisi kelas target ... 5

3 Detil dimensi citra tiap dekomposisi level wavelet ... 6

4 Generalisasi terbaik wavelet level 1 ... 8

5 Generalisasi terbaik wavelet level 2 ... 9

6 Generalisasi terbaik wavelet level 3 ... 10

7 Generalisasi terbaik wavelet level 4 ... 11

8 Generalisasi terbaik wavelet level 5 ... 12

9 Generalisasi terbaik wavelet level 6 ... 13

DAFTAR GAMBAR

Halaman 1 Contoh sidik jari. ... 12 Arsitektur jaringan syaraf tiruan propagasi balik (Fu 1994). ... 3

3 Bank filter Haar. ... 5

4 Tahapan pengenalan sidik jari. ... 6

5 Contoh hasil dekomposisi wavelet tiap level. ... 7

6 Grafik perbandingan generalisasi wavelet level 1 toleransi kesalahan 0.01. ... 7

7 Grafik perbandingan generalisasi wavelet level 1 toleransi kesalahan 0.001. ... 7

8 Grafik perbandingan generalisasi wavelet level 1 toleransi kesalahan 0.0001. ... 7

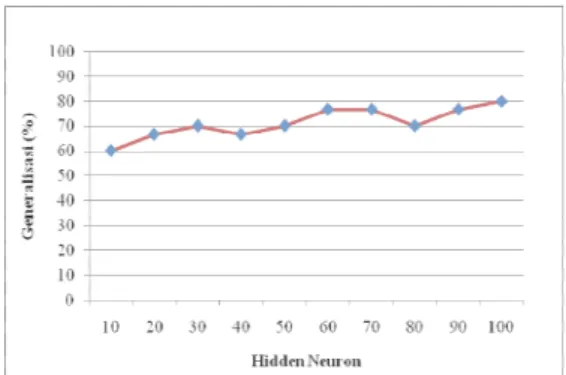

9 Grafik perbandingan generalisasi wavelet level 1 keseluruhan. ... 8

10 Grafik perbandingan generalisasi wavelet level 2 toleransi kesalahan 0.01. ... 8

11 Grafik perbandingan generalisasi wavelet level 2 toleransi kesalahan 0.001. ... 8

12 Grafik perbandingan generalisasi wavelet level 2 toleransi kesalahan 0.0001. ... 8

13 Grafik perbandingan generalisasi wavelet level 2 keseluruhan. ... 9

14 Grafik perbandingan generalisasi wavelet level 3 toleransi kesalahan 0.01. ... 9

15 Grafik perbandingan generalisasi wavelet level 3 toleransi kesalahan 0.001. ... 9

16 Grafik perbandingan generalisasi wavelet level 3 toleransi kesalahan 0.0001. ... 9

17 Grafik perbandingan generalisasi wavelet level 3 keseluruhan. ... 10

18 Grafik perbandingan generalisasi wavelet level 4 toleransi kesalahan 0.01. ... 10

19 Grafik perbandingan generalisasi wavelet level 4 toleransi kesalahan 0.001. ... 10

20 Grafik perbandingan generalisasi wavelet level 4 toleransi kesalahan 0.0001. ... 10

21 Grafik perbandingan generalisasi wavelet level 4 keseluruhan. ... 11

22 Grafik perbandingan generalisasi wavelet level 5 toleransi kesalahan 0.01. ... 11

23 Grafik perbandingan generalisasi wavelet level 5 toleransi kesalahan 0.001. ... 11

24 Grafik perbandingan generalisasi wavelet level 5 toleransi kesalahan 0.0001. ... 11

25 Grafik perbandingan generalisasi wavelet level 5 keseluruhan. ... 12

26 Grafik perbandingan generalisasi wavelet level 6 toleransi kesalahan 0.01. ... 12

27 Grafik perbandingan generalisasi wavelet level 6 toleransi kesalahan 0.001. ... 12

28 Grafik perbandingan generalisasi wavelet level 6 toleransi kesalahan 0.0001. ... 12

29 Grafik perbandingan generalisasi wavelet level 6 keseluruhan. ... 13

30 Grafik perbandingan generalisasi maksimum. ... 13

31 Grafik perbandingan jumlah epoch. ... 13

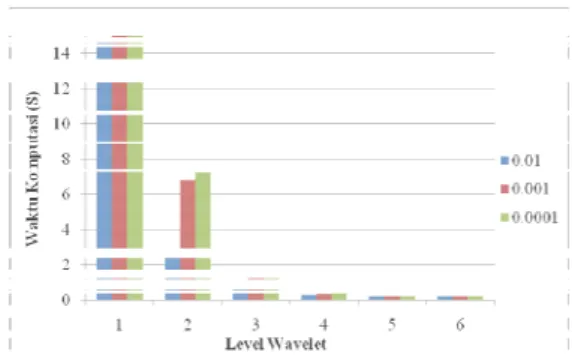

32 Grafik perbandingan waktu komputasi. ... 14

33 Transformasi wavelet pada kolom. ... 19

34 Transformasi wavelet pada baris. ... 19

DAFTAR LAMPIRAN

Halaman

1 Algoritme Jaringan Syaraf Tiruan Resilient (RPROP) ... 16

2 Ilustrasi transformasi wavelet pada citra ... 19

3 Data Sidik Jari ... 20

4 Tabel generalisasi toleransi kesalahan 0.01 ... 24

5 Tabel generalisasi toleransi kesalahan 0.001 ... 29

PENDAHULUAN

Latar Belakang

Sistem pengenalan biometrik menggunakan karakteristik fisiologis yang dimiliki manusia sebagai dasar dari pengenalannya. Karakteristik fisiologis manusia yang digunakan sebagai dasar pengenalan harus bersifat unik, permanen, dan universal (Maltoni et al 2003). Contoh dari karakteristik fisiologis manusia yang dapat dijadikan sebagai dasar pengenalan biometrik adalah wajah, retina, sidik jari, dan suara manusia. Sidik jari bersifat universal dan unik karena setiap individu memiliki sidik jari dan tidak ada satupun individu yang memiliki sidik jari yang sama. Selain itu, sidik jari juga bersifat permanen karena sidik jari sulit untuk dihilangkan, kecuali disebabkan kecelakaan yang amat serius pada jari.

Wavelet adalah salah satu metode pengolahan citra yang dapat mengekstraksi fitur selain dapat mereduksi dimensi. Menggunakan wavelet, fitur-fitur yang penting tidak akan hilang ketika dimensi citra mengalami reduksi. Citra hasil transformasi wavelet akan digunakan sebagai input sistem pengenalan sidik jari pada penelitian ini. Induk wavelet yang digunakan adalah induk wavelet Haar karena merupakan wavelet yang paling mudah digunakan (McAndrew 2004).

Metode pengenalan sidik jari yang digunakan pada penelitian ini adalah jaringan syaraf tiruan propagasi balik. Jaringan syaraf tiruan propagasi balik digunakan karena memiliki arsitektur multilayer sehingga baik untuk menangani permasalahan yang kompleks (Fu 1994).

Penelitian ini didasarkan pada penelitian sebelumnya yang dilakukan oleh Cahyaningtias (2007). Penelitian tersebut menggunakan citra wajah sebagai karakteristik fisiologis pada sistem pengenalannya dan Haar sebagai induk waveletnya. Dari penelitian tersebut, dapat disimpulkan bahwa akurasi sistem pengenalan citra wajah meningkat seiring dengan peningkatan level dekomposisi wavelet pada citra. Penelitian lainnya dilakukan oleh Minarni (2004). Sistem klasifikasi yang digunakan pada penelitian tersebut adalah jaringan syaraf tiruan Learning Vector

Quantization (LVQ). Penelitian tersebut

menghasilkan kesimpulan bahwa dengan menggunakan jaringan syaraf tiruan LVQ,

semakin kecil dimensi masukan akan membuat unjuk kerja pengenalan menurun. Tujuan Penelitian

Penelitian ini bertujuan menganalisis pengaruh level dekomposisi transformasi wavelet pada pengenalan sidik jari. Penelitian ini juga akan menganalisis kinerja jaringan syaraf tiruan propagasi balik pada pengenalan sidik jari yang telah mengalami praproses transformasi wavelet.

Ruang Lingkup Penelitian

Penelitian ini menggunakan citra sidik jari berskala keabuan yang memiliki dimensi awal 300 × 300 piksel. Data diambil dari sebuah situs internet pada alamat http://www.bias.csr.unibo.it/fvc2000/database s.asp. Pada situs ini terdapat kumpulan basis data sidik jari yang dapat diunduh secara bebas. Induk wavelet yang digunakan pada penelitian ini adalah induk wavelet Haar. Manfaat Penelitian

Penelitian ini diharapkan dapat menambah pustaka penelitian biometrik yang menggunakan sidik jari sebagai dasar pengenalannya. Penelitian ini juga diharapkan menambah pustaka penelitian mengenai wavelet dan manfaatnya.

TINJAUAN PUSTAKA

Sidik Jari

Sidik jari bersifat unik untuk tiap individu dan tidak akan berubah seumur hidup kecuali disebabkan oleh kecelakaan seperti luka parah pada jari (Maltoni et al 2003). Pola sidik jari dapat dibagi menjadi dua tipe garis, yaitu

ridge dan valley. Ridge merupakan garis yang

berwarna gelap, sedangkan valley adalah daerah antara ridge yang berwarna terang. Untuk lebih jelasnya dapat dilihat pada Gambar 1.

Gambar 1 Contoh sidik jari. Garis berwarna hitam adalah ridge sedangkan daerah putih

Representasi sidik jari yang baik harus memiliki dua properti berikut :

1 Saliency: mengandung informasi yang khusus mengenai sidik jari tersebut.

2 Suitability: mudah diekstrak, disimpan dalam media yang padat, dan berguna untuk proses verifikasi.

Pola sidik jari saat dianalisis dalam beberapa skala yang berbeda menghasilkan beberapa fitur yang berbeda, yaitu:

- Pada level global, garis-garis berbentuk gelombang pada sidik jari menggambarkan titik-titik yang disebut Titik Singular. Titik Singular, yang juga disebut loop atau delta, adalah titik dimana alur-alur garis yang terdapat pada sidik jari memutar balik. Titik singular dan tingkat kekasaran alur sidik jari sangat berpengaruh pada pengindeksian dan klasifikasi sidik jari (Maltoni et al 2003).

- Pada level lokal, teridentifikasi lebih dari 100 karakteristik garis ridge yang disebut minutiae. Terdapat dua tipe minutiae (Maltoni et al 2003), yaitu:

1 Ridge ending : titik dimana garis ridge memiliki ujung yang kasar.

2 Ridge bifurcation : titik dimana garis

ridge mengalami percabangan.

- Analisis pada level yang lebih detail berhasil mengidentifikasi sweat pores (pori-pori tempat keluarnya keringat) pada jari. Proses klasifikasi sidik jari menggunakan titik ini hanya dapat dilakukan pada gambar sidik jari yang beresolusi tinggi, misalnya 100 dpi.

Jaringan Syaraf Tiruan (JST)

Jaringan syaraf tiruan adalah sebuah sistem pemroses informasi yang memiliki beberapa karakteristik kinerja yang mirip dengan jaringan syaraf biologis (Fausett 1994). Jaringan syaraf tiruan dicirikan dengan arsitekturnya, metode pembelajaran (learning), dan fungsi aktivasinya (Fausett 1994). Arsitektur jaringan syaraf tiruan adalah pola keterhubungan antar neuron pada jaringan. Metode pembelajaran adalah metode untuk menentukan bobot dari koneksi antar

neuron.

Topologi jaringan syaraf tiruan biasanya dispesifikasikan oleh jumlah layer dan jumlah

neuron pada tiap layer-nya. Tipe-tipe layer

yaitu (Fu 1994):

1 Layer input: merepresentasikan masalah agar dapat diproses oleh jaringan syaraf tiruan. Pada lapisan input tidak dilakukan

pemrosesan informasi tetapi hanya mendistribusikannya ke layer lain.

2 Hidden layer: tidak diobservasi secara langsung. Menyediakan nonlinearitas dalam bentuk fungsi aktivasi pada jaringan syaraf tiruan.

3 Layer output: merepresentasikan konsep atau nilai yang mungkin untuk permasalahan yang diberikan oleh layer input.

Arsitektur jaringan syaraf tiruan biasanya diklasifikasikan menjadi dua yaitu single layer dan multilayer (Fausett 1994). Jaringan syaraf tiruan single layer hanya mempunyai satu

layer yang terhubungkan. Jaringannya hanya

terdiri dari layer input sebagai penerima sinyal dari lingkungan dan layer output sebagai tempat diberikannya respon jaringan. Jaringan syaraf tiruan multilayer memiliki satu atau lebih hidden layer antara layer input dan layer output. Jaringan syaraf tiruan

multilayer dapat menyelesaikan permasalahan

yang lebih kompleks dari jaringan syaraf tiruan single layer (Fausett 1994).

Jaringan syaraf tiruan dikelompokkan dalam dua kelompok besar yaitu jaringan syaraf tiruan feed-forward dan jaringan syaraf tiruan recurrent. Jaringan syaraf tiruan

feed-forward dicirikan dengan tidak adanya loop

dalam graf jaringan, sedangkan jaringan syaraf tiruan recurrent dicirikan dengan adanya loop koneksi balik pada graf jaringannya.

Fungsi aktivasi

Fungsi aktivasi jaringan syaraf tiruan adalah fungsi yang menggambarkan tingkat aktivasi internal antar neuron (Puspitaningrum 2006). Untuk mendapatkan hasil maksimum dari jaringan syaraf tiruan multilayer, dibutuhkan sebuah fungsi aktivasi yang nonlinear (Fausett 1994). Fungsi sigmoid sangat berguna digunakan sebagai fungsi aktivasi. Terdapat dua jenis fungsi aktivasi sigmoid yang umum digunakan yaitu fungsi sigmoid biner dan sigmoid tangen.

Jaringan Syaraf Tiruan Propagasi Balik Jaringan syaraf tiruan propagasi balik termasuk dalam jaringan syaraf tiruan feed

forward multilayer (Fu 1994). Arsitektur

jaringan syaraf tiruan propagasi balik dapat dilihat pada Gambar 2. Pada jaringannya, tiap unit lapisan input akan terhubungkan dengan tiap unit hidden layer.

Gambar 2 Arsitektur jaringan syaraf tiruan

propagasi balik (Fu 1994).

Pelatihan pada jaringan syaraf tiruan propagasi balik memiliki 3 langkah (Fausett 1994), yaitu:

- feed forward

Pada tahap feed forward, tiap unit input diberi masukan dari luar JST, kemudian input-input tersebut dikirimkan ke hidden layer. Setelah menerima input dari layer input,

hidden layer akan menghitung nilai

aktivasinya dan meneruskan sinyal input ke

layer output. Sama seperti hidden layer, layer

output juga akan menghitung nilai aktivasi sebagai respon dari JST tersebut.

- perhitungan dan propagasi balik kesalahan Nilai-nilai aktivasi yang dihasilkan oleh tiap unit output akan dibandingkan dengan nilai target yang diberikan untuk mencari nilai kesalahan yang dihasilkan. Berdasarkan kesalahan tersebut, akan dihitung nilai gradien

error δ yang akan digunakan untuk

mendistribusikan kesalahan pada layer output ke hidden layer sebelumnya. Kemudian, dilakukan perhitungan yang sama pada hidden

layer. Namun nilai δ tidak digunakan untuk

mendistribusikan nilai kesalahan ke layer input, tetapi digunakan untuk memperbaiki bobot antara layer input dan hidden layer. - penyesuaian bobot

Setelah semua nilai δ ditentukan, dilakukan penyesuaian bobot untuk semua

layer. Penyesuaian bobot didasarkan kepada

faktor δ dan nilai aktivasi pada tiap layer. Fungsi aktivasi yang biasanya digunakan pada jaringan syaraf tiruan propagasi balik adalah sigmoid biner. Fungsi sigmoid biner dapat memetakan nilai input yang range-nya tak terbatas menjadi nilai di antara range 0

sampai 1 pada output. Fungsi sigmoid biner didefinisikan sebagai : x e x f − + = 1 1 ) ( 1 . (1)

Resilient Backpropagation (RPROP)

Resilient Backpropagation (RPPROP)

adalah salah satu jaringan syaraf tiruan yang dikembangkan dari jaringan syaraf tiruan propagasi balik. RPROP dapat memperkecil besarnya efek turunan parsial pada jaringan syaraf tiruan propagasi balik dengan cara hanya menggunakan tanda turunan yang mempengaruhi cara perbaikan bobot. Pada RPROP, besarnya perubahan setiap bobot ditentukan oleh suatu faktor yang disebut Faktor Naik (FN) atau Faktor Turun (FT) (Nugroho 2007). Bila gradien error berubah tanda dari iterasi satu ke iterasi setelahnya, bobot diturunkan sejumlah FT, sedangkan bila gradien error bertanda sama dari iterasi sebelumnya bobot akan dinaikkan sejumlah FN. Bila gradien error bernilai nol, maka nilai bobot tetap dari iterasi sebelumnya. Algoritma RPROP selengkapnya dapat dilihat pada Lampiran 1.

Wavelet

Wave didefinisikan sebagai sebuah fungsi

yang berosilasi terhadap waktu atau ruang (Burrus, Gopinath, Guo 1998). Contoh dari sebuah wave adalah sinusoid atau fungsi sinus. Wavelet adalah sebuah ’’wave kecil’’ yang energinya terkonsentrasi pada waktu atau titik tertentu (Burrus, Gopinath, Guo 1998). Wavelet juga dapat dianggap sebagai

wave yang hanya memiliki nilai tidak nol pada

sebagian kecil daerah (McAndrew 2004). Transformasi wavelet dapat didefinisikan sebagai jumlah dari nilai fungsi yang dikalikan dengan nilai wavelet (McAndrew 2004).

Basis wavelet berasal dari sebuah fungsi penskalaan atau scaling function (Burrus, Gopinath, Guo 1998). Scaling function dapat dituliskan dengan persamaan:

Z n n n t n h t = φ − ∈ φ

∑

, 1 ) 2 ( 2 ) ( ) ( (2)dengan h adalah koefisien scaling function. Dari persamaan (1), dapat dibentuk persamaan wavelet pertama (mother wavelet):

, ) 2 ( 2 ) ( 1 1 ) ( n t n n Z n h t = φ − ∈ ψ

∑

(3)untuk sekumpulan nilai h1. Wavelet lainnya dapat dibentuk dari hasil dilasi dan pergeseran

mother wavelet.

Wavelet dapat digunakan untuk mengurangi noise, deteksi tepi, dan kompresi citra (McAndrew 2004). Prinsip kerja semua transformasi wavelet adalah menggunakan nilai rata-rata dari nilai-nilai input dan menyediakan semua informasi yang diperlukan agar dapat mengembalikan input ke nilai semula (McAndrew 2004). Untuk mengembalikan input ke nilai semula, diperlukan nilai selisih nilai input dan nilai rata-ratanya. Metode ini disebut averaging (rata-rata) dan differencing (selisih).

Misal diberikan dua nilai a dan b, maka nilai rata-rata (average) s dapat diperoleh dengan persamaan:

2

b a

s= + , (4)

dan nilai selisih (difference) d dapat dihitung dengan persamaan:

.

s ad = − (5)

Untuk mengembalikan nilai input, dapat digunakan persamaan: d s a= + , (6) dan . d s b= − (7)

Transformasi wavelet pada bidang dua dimensi, misalnya citra, dapat dibagi dalam dua cara yaitu dekomposisi standar dan dekomposisi nonstandar (McAndrew 2004). Pada dekomposisi standar, seluruh level transformasi wavelet dilakukan pada tiap kolom terlebih dahulu, kemudian dilakukan transformasi wavelet dari level pertama pada tiap baris dari hasil transformasi seluruh kolom. Pada dekomposisi nonstandar, transformasi wavelet dilakukan per level pada tiap kolom, kemudian transformasi wavelet level yang sama diterapkan pada tiap barisnya. Dekomposisi nonstandar menghasilkan empat citra, yaitu: citra pendekatan sebagai hasil sebenarnya transformasi wavelet, citra detil horisontal, citra detil vertikal, dan citra detil diagonal. Ketiga citra terakhir digunakan untuk merekonstruksi citra hasil transformasi ke citra aslinya.

Pengembangan sinyal berdimensi dua, misalnya citra, menggunakan bank filter untuk melakukan dekomposisi. Citra yang mengalami dekomposisi akan menghasilkan citra pendekatan berupa koefisien pendekatan dan citra detil berupa koefisien detil. Koefisien pendekatan dihasilkan oleh koefisien low-pass (h[n]) dan koefisien detil dihasilkan oleh koefisien high-pass (g[n]). Metode averaging berhubungan dengan koefisien low-pass, sedangkan differencing berhubungan dengan koefisien high-pass (McAndrew 2004).

Wavelet terdiri dari banyak famili. Tiap famili dibedakan dari bank filter yang digunakan. Haar adalah wavelet yang paling mudah dan sederhana (McAndrew 2004). Famili wavelet hasil pengembangan dari Haar adalah wavelet Daubechies. Selain itu, terdapat biorthogonal wavelet, Meyer

wavelet, Morlet wavelet, Shanon wavelet, dan masih banyak lainnya.

Transformasi Haar-Wavelet

Wavelet Haar didefinisikan dengan fungsi berikut (McAndrew 2004): . 1 2 / 1 2 / 1 0 0 1 1 ) ( lainnya x jika x jika x ≤ < < < − =

⎪⎩

⎪

⎨

⎧

ψ (8)dengan hanya dua koefisien tidak nol, yaitu

h1(0) = 1/√2 dan h1(1)= −1/√2 (Burrus,

Gopinath, Guo 1998). Selain itu, wavelet Haar dapat dituliskan juga dalam bentuk scaling

function berikut (McAndrew 2004):

⎩

⎨

⎧

≤ < = , 0 1 0 1 ) ( lainnya x if x φ (9) dan ). 1 2 ( ) 2 ( ) (x =φ x −φ x− ψ (10)Persamaan (10) disebut persamaan wavelet untuk wavelet Haar (McAndrew 2004).

Proses dekomposisi Haar menerapkan

bank filter dengan h0 = h1= 1/√2 sebagai koefisien low-pass yang menghasilkan citra pendekatan, dan g0 = 1/√2 , g1 = −1/√2 sebagai koefisien high-pass yang menghasilkan citra detil. Bank filter Haar dapat dilihat pada Gambar 3.

M M M M K K K K 1 0 0 0 0 1 0 0 0 0 1 0 0 0 1 0 g g h h g g h h

Gambar 3 Bank filter Haar.

Hasil dekomposisi Haar dapat dihitung menggunakan rumus: 2 1 + + = i i i s s a , (11) dan ci = si - ai. (12) Variabel ai merupakan koefisien pendekatan, ci merupakan koefisien detil, dan si adalah himpunan bilangan yang akan didekomposisi. Citra hasil dekomposisi akan berukuran setengah dari ukuran citra sebenarnya. Jika diberikan citra berdimensi 4×4 piksel, maka hasil dekomposisi wavelet level 1 akan menghasilkan citra berdimensi 2×2 piksel. Ilustrasi transformasi Haar-wavelet pada citra selengkapnya dapat dilihat pada Lampiran 2.

METODE PENELITIAN

Data

Penelitian ini menggunakan data berupa citra sidik jari yang diambil dari sebuah situs di internet dengan alamat http://www.bias.csr.unibo.it/fvc2000/database s.asp. Jumlah seluruh data adalah 80 sidik jari, namun tidak semua data digunakan pada proses pengenalan karena beberapa data dianggap tidak memiliki keseragaman posisi dengan data lainnya.

Data yang digunakan pada penelitian ini berjumlah 70 buah, berasal dari sidik jari 10 individu yang masing-masing diambil sidik jarinya sebanyak 7 buah dengan posisi pengambilan yang serupa. Data selengkapnya dapat dilihat pada Lampiran 3. Tiap citra berdimensi 300×300 piksel dengan format .tif skala keabuan 8 bit dan resolusi 500dpi.

Citra sidik jari kemudian dibagi menjadi dua bagian. Penelitian Cahyaningtias (2007) menggunakan perbandingan 1:1 dalam pembagian data untuk data latih dan data ujinya. Dalam penelitian ini, data dibagi sedemikian sehingga jaringan syaraf tiruan memiliki data latih yang cukup untuk

melakukan pengenalan namun data uji yang digunakan juga tidak terlalu sedikit. Dilakukan pembagian sebanyak 40 buah untuk data latih dan 30 buah untuk data uji. Transformasi Wavelet

Citra asli berdimensi cukup besar yaitu 300×300 piksel. Pertama-tama, citra akan mengalami transformasi wavelet level 1 sehingga dimensinya akan menjadi setengah dari dimensi aslinya yaitu 150×150 piksel. Tranformasi wavelet level 2 akan menghasilkan citra berdimensi setengah dari dimensi citra dekomposisi wavelet level 1 yaitu sebesar 75×75 piksel. Seterusnya dilakukan reduksi dimensi citra menggunakan transformasi wavelet hingga level 6 dimana dimensi citra adalah 5×5 piksel.

Proses Pengenalan Sidik Jari

Citra sidik jari yang telah mengalami transformasi wavelet tiap level akan menjadi input untuk jaringan syaraf tiruan propagasi balik. Parameter percobaan yang digunakan selengkapnya dapat dilihat pada Tabel 1. Tabel 1 Parameter percobaan

Karakteristik Spesifikasi Arsitektur 1 hidden layer

Jumlah neuron input Sesuai dengan dimensi citra sidik jari Jumlah neuron output Sesuai banyaknya individu yaitu 10 Jumlah neuron hidden layer 10, 20, 30, 40, 50, 60, 70, 80, 90, 100 Fungsi aktivasi Sigmoid biner Laju pembelajaran 0.001

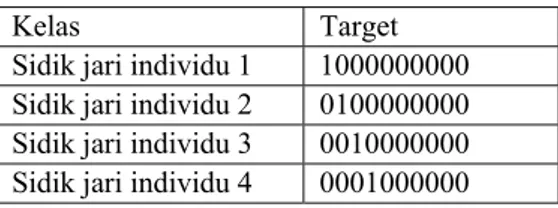

Toleransi kesalahan 0.01, 0.001, 0.0001 Banyaknya kelas target pada jaringan syaraf tiruan yang digunakan pada penelitian ini sesuai dengan jumlah individu pada data sidik jari yang diperoleh yaitu 10 buah. Tiap target akan mewakili satu individu yang direpresentasikan oleh nilai 0 dan 1. Definisi target selengkapnya dapat dilihat pada Tabel 2.

Tabel 2 Definisi kelas target

Kelas Target Sidik jari individu 1 1000000000

Sidik jari individu 2 0100000000 Sidik jari individu 3 0010000000 Sidik jari individu 4 0001000000

Kelas Target Sidik jari individu 5 0000100000

Sidik jari individu 6 0000010000 Sidik jari individu 7 0000001000 Sidik jari individu 8 0000000100 Sidik jari individu 9 0000000010 Sidik jari individu 10 0000000001

Penelitian ini dilakukan percobaan dengan mengkombinasikan hidden neuron, toleransi kesalahan, dan dimensi citra input. Tiap percobaan diulang sebanyak lima kali. Total seluruh percobaan yang dilakukan adalah sebanyak 5 kali ulangan × 6 level dekomposisi wavelet × 10 variasi jumlah hidden neuron × 3 variasi toleransi kesalahan yaitu 900 kali percobaan. Tabel hasil generalisasi setiap percobaan dapat dilihat pada Lampiran 4, 5, dan 6.

Tahapan Pengenalan Sidik Jari

Pada penelitian ini, data akan mengalami enam level transformasi wavelet. Hasil transformasi pada tiap level akan diolah menggunakan jaringan syaraf tiruan. Tahapan pengenalan sidik jari secara lengkap dapat dilihat pada Gambar 4.

Gambar 4 Tahapan pengenalan sidik jari.

Generalisasi

Hasil penelitian ini diukur menggunakan nilai konvergensi dan generalisasinya. Nilai konvergensi adalah tingkat kecepatan jaringan untuk mempelajari pola input yang dinyatakan dalam satuan epoch atau waktu komputasi (Cahyaningtias 2007). Nilai generalisasi berhubungan dengan seberapa baik kinerja jaringan untuk menyelesaikan permasalahan (Fu 1994). Dalam penelitian ini, nilai generalisasi digunakan untuk menghitung kinerja jaringan syaraf tiruan propagasi balik untuk melakukan pengenalan pola sidik jari. Nilai generalisasi dapat dihitung dengan persamaan (Cahyaningtias 2007): % 100 × = seluruhnya pola Jumlah dikenali yang pola Jumlah si Generalisa

Lingkup Pengembangan Sistem

Perangkat keras yang digunakan dalam penelitian ini berupa notebook dengan spesifikasi:

• processor: Intel Pentium M 1.86 Ghz, • memori : 1536 Gb, dan

• hard disk: 80 Gb.

Perangkat lunak yang digunakan yaitu: • sistem operasi: Microsoft Windows XP, • aplikasi pemrograman : Matlab 7.0.1.

HASIL DAN PEMBAHASAN

Data sidik jari pada penelitian ini akan mengalami praproses transformasi wavelet dengan induk wavelet Haar. Data akan didekomposisi sampai level enam. Detil dimensi citra hasil dekomposisi tiap level wavelet dapat dilihat pada Tabel 3. Contoh citra hasil dekomposisi wavelet tiap level dapat dilihat pada Gambar 5.

Tabel 3 Detil dimensi citra tiap dekomposisi level wavelet

Level Dekomposisi Dimensi Citra Level 0 (citra asli) 300×300 piksel

Level 1 150×150 piksel Level 2 75×75 piksel Level 3 38×38 piksel Level 4 19×19 piksel Level 5 10×10 piksel Level 6 5×5 piksel

Gambar 5 Contoh hasil dekomposisi wavelet tiap level.

Percobaan 1: Dekomposisi Wavelet Level 1 Percobaan pertama mengkombinasikan input yang diperoleh dari hasil dekomposisi wavelet Haar level 1 dengan toleransi kesalahan 0.01 pada jaringan syaraf tiruannya. Hasil percobaan pertama ini dapat dilihat pada Gambar 6.

Gambar 6 Grafik perbandingan generalisasi

wavelet level 1 toleransi kesalahan 0.01. Nilai generalisasi pada Gambar 6 mengalami penurunan sekaligus menjadi generalisasi paling rendah pada jumlah hidden

neuron 20. Kemudian nilai generalisasi

meningkat drastis dan menjadi generalisasi terbaik pada jumlah hidden neuron 40. Nilai generalisasi tetap pada jumlah hidden neuron 50, 60, dan 70 dan meningkat pada jumlah

hidden neuron selanjutnya.

Setelah itu dilakukan kombinasi berbeda dengan menurunkan nilai toleransi kesalahannya menjadi 0.001. Hasil percobaan dengan kombinasi ini dapat dilihat pada Gambar 7.

Gambar 7 Grafik perbandingan generalisasi

wavelet level 1 toleransi kesalahan 0.001. Nilai generalisasi pada Gambar 7 mengalami peningkatan sampai jumlah hidden

neuron 50. Generalisasi pada jumlah hidden neuron tersebut juga menjadi nilai generalisasi

tertinggi yang dicapai pada percobaan dengan kombinasi ini. Nilai generalisasi pada jumlah

hidden neuron selanjutnya mengalami

penurunan walaupun sempat bernilai konstan pada jumlah hidden neuron 60, 70, dan 80.

Toleransi kesalahan kemudian diturunkan lagi menjadi 0.0001. Grafik nilai generalisasi yang dihasilkan dapat dilihat pada Gambar 8.

Gambar 8 Grafik perbandingan generalisasi

wavelet level 1 toleransi kesalahan 0.0001. Dari Gambar 8 dapat dilihat generalisasi jumlah hidden neuron 10 meningkat sekitar 30% pada jumlah hidden neuron 20. Nilai generalisasi terbaik pada kombinasi ini diperoleh dua kali yaitu pada jumlah hidden

neuron 60 dan 80. Setelah mengalami

penurunan, generalisasi bernilai tetap pada jumlah hidden neuron 90 dan 100.

Dari ketiga percobaan dapat disimpulkan bahwa nilai generalisasi wavelet level 1 mencapai nilai optimum pada toleransi kesalahan 0.01 dengan titik keseimbangan pada jumlah hidden neuron 40. Grafik perbandingan generalisasi wavelet level 1

dapat dilihat pada Gambar 9. Data selengkapnya dapat dilihat pada Tabel 4.

Gambar 9 Grafik perbandingan generalisasi

wavelet level 1 keseluruhan. Tabel 4 Generalisasi terbaik wavelet level 1

Toleransi

kesalahan Generalisasi terbaik Hidden neuron

0.01 80% 40

0.001 76.67% 50

0.0001 76.67% 60,80 Percobaan 2: Dekomposisi Wavelet Level 2

Percobaan ini menggunakan citra hasil dekomposisi wavelet level 2 sebagai input jaringan syaraf tiruan. Grafik generalisasi yang dihasilkan pada toleransi kesalahan 0.01 dapat dilihat pada Gambar 10.

Gambar 10 Grafik perbandingan generalisasi

wavelet level 2 toleransi kesalahan 0.01. Pada Gambar 10, nilai generalisasi mengalami nilai minimum pada jumlah

hidden neuron 10. Pada jumlah hidden neuron

selanjutnya, generalisasi meningkat hingga mencapai generalisasi terbaiknya yaitu 80% pada jumlah hidden neuron 40. Nilai generalisasi menurun pada jumlah hidden

neuron selanjutnya dan mengulangi pola yang

sama seperti pola sebelumnya, meningkat kemudian menurun pada jumlah hidden

neuron 90.

Selanjutnya toleransi kesalahan diturunkan menjadi 0.001. Grafik generalisasi yang dihasilkan dapat dilihat pada Gambar 11.

Gambar 11 Grafik perbandingan generalisasi

wavelet level 2 toleransi kesalahan 0.001. Secara umum, nilai generalisasi dengan kombinasi ini dapat dikatakan meningkat. Nilai generalisasi minimum terjadi pada jumlah hidden neuron 10 sedangkan generalisasi maksimum dicapai dua kali yaitu pada jumlah hidden neuron 60 dan 70. Terdapat kecenderungan yang serupa tiap tiga peningkatan jumlah hidden neuron. Generalisasi pada jumlah hidden neuron 20 mengalami peningkatan dari generalisasi pada jumlah hidden neuron 10 dan meningkat lagi pada jumlah hidden neuron 30. Generalisasi menurun pada jumlah hidden neuron selanjutnya dan mengikuti pola yang sama sampai jumlah hidden neuron 60.

Toleransi kesalahan diturunkan lagi menjadi 0.0001. Grafik generalisasi yang dihasilkan dapat dilihat pada Gambar 12.

Gambar 12 Grafik perbandingan generalisasi

wavelet level 2 toleransi kesalahan 0.0001. Generalisasi pada kombinasi ini mengalami peningkatan secara umum. Nilai generalisasi maksimum dicapai pada jumlah

hidden neuron 90 yaitu sebesar 86.67% dan

mencapai minimum pada jumlah hidden

Setelah mencapai generalisasi maksimum, generalisasi menurun pada jumlah hidden

neuron 100 hingga mencapai 73.33%.

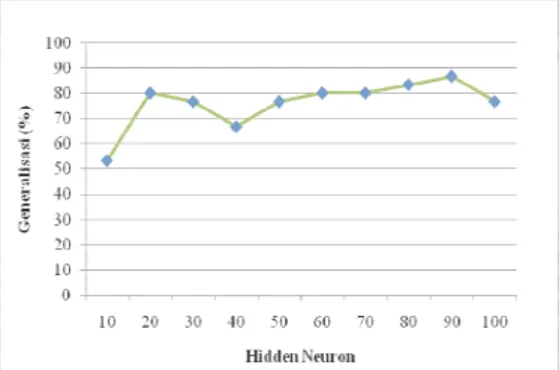

Grafik perbandingan nilai generalisasi wavelet level 2 pada keseluruhan percobaan dapat dilihat pada Gambar 13.

Gambar 13 Grafik perbandingan generalisasi

wavelet level 2 keseluruhan.

Dari grafik dapat dilihat bahwa pada ketiga kombinasi, generalisasi maksimum dicapai pada toleransi kesalahan bernilai 0.0001 dengan titik keseimbangan pada jumlah hidden neuron 90. Perbandingan nilai generalisasi tertinggi untuk ketiga toleransi kesalahan dapat dilihat pada Tabel 5.

Tabel 5 Generalisasi terbaik wavelet level 2 Toleransi

kesalahan Generalisasi terbaik Hidden neuron

0.01 80% 40

0.001 80% 100

0.0001 86.67% 90

Percobaan 3: Dekomposisi Wavelet Level 3 Seperti percobaan sebelumnya, citra pendekatan wavelet level 3 akan dikombinasikan dengan nilai toleransi kesalahan 0.01 terlebih dahulu. Grafik generalisasinya dapat dilihat pada Gambar 14.

Gambar 14 Grafik perbandingan generalisasi

wavelet level 3 toleransi kesalahan 0.01. Pada kombinasi ini, nilai maksimum generalisasi yaitu 80% dicapai pada jumlah

hidden neuron 20, 60, dan 70 sedangkan nilai

generalisasi minimum yaitu sebesar 63.33% dicapai pada jumlah hidden neuron 10. Pada Gambar 8, terdapat kecenderungan generalisasi yang naik dan turun secara bergantian. Contohnya generalisasi jumlah

hidden neuron meningkat dari jumlah hidden neuron 30 ke 40 dan turun pada jumlah hidden neuron 50. Nilai generalisasi menurun

pada jumlah hidden neuron 70 ke 80, bernilai tetap sampai jumlah hidden neuron 90 dan naik pada jumlah hidden neuron 100.

Toleransi kesalahan kemudian diturunkan menjadi 0.001. Grafik yang dihasilkan dapat dilihat pada Gambar 15.

Gambar 15 Grafik perbandingan generalisasi

wavelet level 3 toleransi kesalahan 0.001. Seperti dapat dilihat pada Gambar 15, pola yang sama terjadi pada kombinasi toleransi kesalahan ini. Nilai generalisasi meningkat pada jumlah hidden neuron 60 ke 70, bernilai tetap dan turun pada jumlah

hidden neuron 80 dan 90, dan meningkat

sekaligus menjadi nilai generalisasi terbaik pada jumlah hidden neuron 100 yaitu sebesar 83.33%.

Percobaan selanjutnya dilakukan dengan menurunkan toleransi kesalahan menjadi 0.0001. Grafik hasil generalisasi dapat dilihat pada Gambar 16.

Gambar 16 Grafik perbandingan generalisasi

Seperti dapat disimpulkan dari Gambar 16, pola yang hampir sama juga terjadi pada kombinasi ini. Bedanya, pada jumlah hidden

neuron 100 nilai generalisasi menurun,

sedangkan pola sebelumnya pada jumlah

hidden neuron yang sama generalisasi

mengalami kenaikan. Nilai generalisasi maksimum dicapai pada jumlah hidden

neuron 90 yaitu sebesar 86.67% dan

generalisasi minimum dicapai pada jumlah

hidden neuron 10 yaitu sebesar 53.33%.

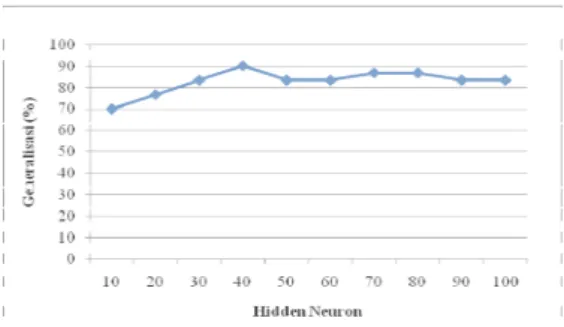

Nilai generalisasi citra dekomposisi wavelet level 3 mencapai maksimum pada toleransi kesalahan 0.0001 yaitu sebesar 86.67% dengan titik keseimbangan 90. Grafik perbandingan generalisasinya pada seluruh kombinasi percobaan dapat dilihat pada Gambar 17 dan data selengkapnya dapat dilihat pada Tabel 6.

Tabel 6 Generalisasi terbaik wavelet level 3 Toleransi

kesalahan Generalisasi terbaik Hidden neuron

0.01 80% 20,60,70

0.001 83.33% 100

0.0001 86.67% 90

Gambar 17 Grafik perbandingan generalisasi

wavelet level 3 keseluruhan. Percobaan 4: Dekomposisi Wavelet Level 4

Percobaan dilanjutkan dengan menggunakan citra hasil dekomposisi wavelet level 4. Dengan nilai toleransi kesalahan 0.01, grafik generalisasi yang dihasilkan dapat dilihat pada Gambar 18.

Berdasarkan Gambar 18, secara umum nilai generalisasi meningkat seiring dengan pertambahan jumlah hidden neuron. Nilai generalisasi maksimum dicapai pada jumlah

hidden neuron 40 yaitu sebesar 90%.

Perubahan nilai generalisasi pada jumlah

hidden neuron selanjutnya dapat dikatakan

cukup stabil karena besar perubahannya yang cukup kecil.

Gambar 18 Grafik perbandingan generalisasi

wavelet level 4 toleransi kesalahan 0.01. Nilai toleransi kesalahan diturunkan menjadi 0.001. Grafik hasil generalisasinya dapat dilihat pada Gambar 19.

Gambar 19 Grafik perbandingan generalisasi

wavelet level 4 toleransi kesalahan 0.001. Dapat dilihat pada Gambar 19, generalisasi maksimum sebesar 90% dicapai pada empat jumlah hidden neuron, yaitu jumlah hidden

neuron 30, 40, 50, dan 100. Nilai generalisasi

pada jumlah hidden neuron 60 turun dari jumlah hidden neuron 50 dan tidak mengalami perubahan sampai jumlah hidden

neuron 80.

Percobaan menggunakan citra dekomposisi level 4 diakhiri dengan menurunkan nilai toleransi kesalahan menjadi 0.0001. Grafik hasil generalisasinya dapat dilihat pada Gambar 20.

Gambar 20 Grafik perbandingan generalisasi

wavelet level 4 toleransi kesalahan 0.0001. Nilai generalisasi meningkat sebanyak sekitar 20% dari jumlah hidden neuron 10 ke

jumlah hidden neuron 20. Pada jumlah hidden

neuron selanjutnya, tidak terdapat adanya

perubahan nilai generalisasi yang cukup jauh tiap perubahan jumlah hidden neuron sehingga hasil percobaan ini juga dapat dikatakan cukup stabil.

Grafik perbandingan generalisasi maksimum keseluruhan percobaan untuk dekomposisi wavelet level 4 dapat dilihat pada Gambar 21. Dari gambar dapat disimpulkan bahwa nilai generalisasi menggunakan citra hasil dekomposisi wavelet level 4 mencapai nilai maksimum pada toleransi kesalahan 0.001. Data selengkapnya dapat dilihat pada Tabel 7.

Gambar 21 Grafik perbandingan generalisasi

wavelet level 4 keseluruhan. Tabel 7 Generalisasi terbaik wavelet level 4

Toleransi

kesalahan Generalisasi terbaik Hidden neuron

0.01 90% 40

0.001 90% 30,40,50

0.0001 86.67% 70,80,90

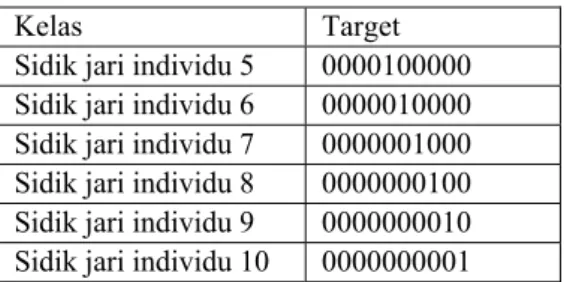

Percobaan 5: Dekomposisi Wavelet Level 5 Percobaan pertama dengan citra dekomposisi wavelet level 5 dimulai dengan kombinasi toleransi kesalahan 0.01. Grafik generalisasi yang dihasilkan dapat dilihat pada Gambar 22.

Gambar 22 Grafik perbandingan generalisasi

wavelet level 5 toleransi kesalahan 0.01.

Grafik generalisasi pada Gambar 22 cukup stabil yang ditandai dengan kecilnya nilai perubahan generalisasi dari jumlah hidden

neuron 10 sampai hidden neuron 100. Bahkan

nilai generalisasi cenderung konstan pada beberapa jumlah hidden neuron. Sebagai contoh, generalisasi bernilai tetap yaitu 80% pada jumlah hidden neuron 10 sampai 40. Begitu juga pada jumlah hidden neuron 50 dan 60 yang memiliki nilai generalisasi tetap yaitu 86.67%.

Percobaan kedua dilakukan dengan menurunkan toleransi kesalahan menjadi 0.001. Grafik yang dihasilkan dapat dilihat pada Gambar 23.

Gambar 23 Grafik perbandingan generalisasi

wavelet level 5 toleransi kesalahan 0.001. Generalisasi cenderung mengalami penurunan dan bernilai tetap setelah mencapai generalisasi maksimum pada jumlah hidden

neuron 60. Generalisasi maksimum yang

dicapai adalah sebesar 93.33%. Pada jumlah

hidden neuron selanjutnya sampai jumlah hidden neuron 100, generalisasi bernilai tetap

yaitu 90%.

Terakhir, nilai toleransi kesalahan diturunkan menjadi 0.0001. Grafik generalisasi yang dihasilkan dapat dilihat pada Gambar 24.

Gambar 24 Grafik perbandingan generalisasi

Dengan kombinasi ini, grafik generalisasi terlihat lebih stabil. Nilai generalisasi maksimum dicapai pada jumlah hidden

neuron 80 dan 100 yaitu sebesar 93.33%.

Besar perubahan nilai generalisasi cukup kecil yaitu hanya sekitar 3-5%, kecuali pada jumlah

hidden neuron 20 yang generalisasinya

meningkat dari jumlah hidden neuron 10 sebanyak 16.67%.

Grafik perbandingan generalisasi wavelet level 5 dapat dilihat pada Gambar 25. Berdasarkan gambar, nilai generalisasi maksimum dicapai pada toleransi kesalahan 0.0001 yaitu sebesar 93.33%. Perbandingan selengkapnya dapat dilihat pada Tabel 8.

Gambar 25 Grafik perbandingan generalisasi

wavelet level 5 keseluruhan. Tabel 8 Generalisasi terbaik wavelet level 5

Toleransi

kesalahan Generalisasi terbaik Hidden neuron

0.01 86.67% 50,60,80,90

0.001 93.33% 60

0.0001 93.33% 80,100 Percobaan 6: Dekomposisi Wavelet Level 6

Tiga percobaan terakhir pada penelitian ini menggunakan citra hasil dekomposisi wavelet level 6 sebagai input jaringan syaraf tiruannya. Grafik generalisasi yang dihasilkan pada toleransi kesalahan 0.01 dapat dilihat pada Gambar 26.

Gambar 26 Grafik perbandingan generalisasi

wavelet level 6 toleransi kesalahan 0.01.

Pada Gambar 26, terdapat pola nilai generalisasi yang naik dan turun secara bergantian sebelum akhirnya mencapai nilai generalisasi maksimum 93.33% pada jumlah

hidden neuron 60. Nilai generalisasi tetap

berada pada titik maksimum pada jumlah

hidden neuron selanjutnya.

Percobaan kedua menggunakan dekomposisi wavelet level 6 dilakukan dengan menurunkan nilai toleransi kesalahan menjadi 0.001. Grafik generalisasi yang dihasilkan dapat dilihat pada Gambar 27.

Gambar 27 Grafik perbandingan generalisasi

wavelet level 6 toleransi kesalahan 0.001. Berdasarkan grafik pada Gambar 27, nilai generalisasi hampir stabil karena nilai generalisasi tidak jauh berbeda antara tiap jumlah hidden neuron-nya. Terdapat kecenderungan yang hampir sama dengan kombinasi sebelumnya, yaitu nilai generalisasi yang naik dan turun secara bergantian, tetapi dengan selisih nilai generalisasi yang lebih kecil dari pola sebelumnya.

Pada percobaan terakhir, nilai toleransi kesalahan diturunkan lagi menjadi 0.0001. Grafik generalisasi yang dihasilkan dapat dilihat pada Gambar 28.

Gambar 28 Grafik perbandingan generalisasi

wavelet level 6 toleransi kesalahan 0.0001. Kombinasi ini menghasilkan nilai generalisasi yang hampir konstan karena nilai generalisasi yang dicapai pada suatu jumlah

generalisasi pada jumlah hidden neuron sebelum dan sesudahnya. Nilai generalisasi minimum adalah 76.67% pada jumlah hidden

neuron 10 yang langsung naik sebesar 13 poin

pada jumlah hidden neuron 20. Nilai generalisasi maksimum sebesar 93.33% dicapai tiga kali yaitu pada jumlah hidden

neuron 30, 70, dan 100.

Perbandingan nilai generalisasi maksimum pada tiap toleransi kesalahan untuk citra dekomposisi wavelet level 6 dapat dilihat pada Tabel 9. Grafik perbandingan nilia generalisasinya pada tiap kombinasi percobaan dapat dilihat pada Gambar 29. Dari grafik dapat disimpulkan bahwa nilai generalisasi maksimum dicapai pada toleransi kesalahan 0.01.

Tabel 9 Generalisasi terbaik wavelet level 6 Toleransi

kesalahan Generalisasi terbaik Hidden neuron 0.01 93.33% 60,70,80,90,100 0.001 93.33% 50,70, 80, 100

0.0001 93.33% 30,70, 100

Gambar 29 Grafik perbandingan generalisasi

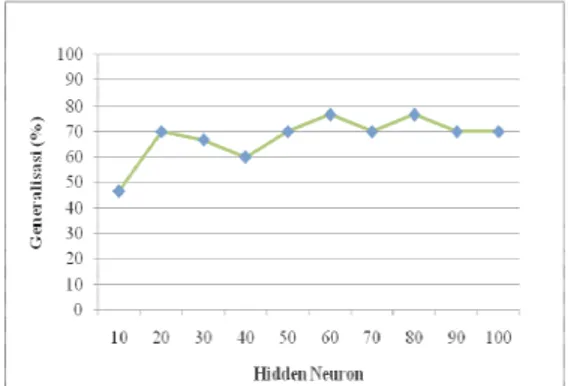

wavelet level 6 keseluruhan. Perbandingan Generalisasi

Perbandingan nilai generalisasi maksimum dari seluruh percobaan dapat dilihat pada Gambar 30.

Gambar 30 Grafik perbandingan generalisasi

maksimum.

Berdasarkan Gambar 30, nilai generalisasi makin tinggi bila level dekomposisi wavelet yang digunakan juga bertambah. Namun nilai generalisasi dekomposisi wavelet level 6 tidak mengalami peningkatan dari level 5. Hal ini berarti dengan menggunakan citra dekomposisi wavelet level 5, telah diperoleh hasil pengenalan yang maksimum dari jaringan syaraf tiruan.

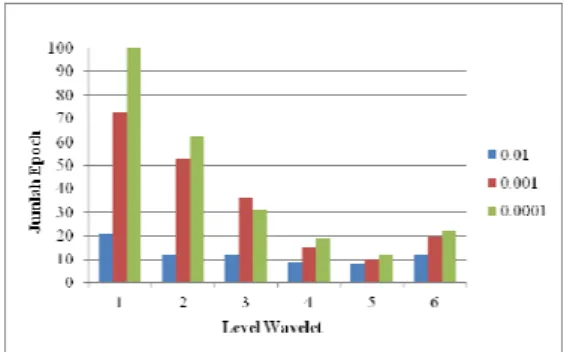

Perbandingan Konvergensi Jaringan Syaraf Tiruan yang Digunakan

Konvergensi jaringan syaraf tiruan diukur dengan satuan epoch dan atau waktu komputasi. Grafik perbandingan jumlah epoch jaringan syaraf tiruan pada penelitian ini dapat dilihat pada Gambar 31.

Gambar 31 Grafik perbandingan jumlah

epoch.

Pada Gambar 31, terdapat kecenderungan jumlah epoch yang rata-rata meningkat seiring dengan penurunan toleransi kesalahan. Kecenderungan lainnya adalah jumlah epoch yang menurun seiring dengan pertambahan level dekomposisi wavelet pada data input, kecuali pada level 6. Jumlah epoch pada level 6 mengalami peningkatan dari jumlah epoch level 5 pada semua nilai toleransi kesalahan.

Wavelet juga terbukti mempengaruhi waktu komputasi. Grafik perbandingan waktu komputasi pada penelitian ini dapat dilihat pada Gambar 32.

Gambar 32 Grafik perbandingan waktu

komputasi.

Pada Gambar 32 dapat ditunjukkan bahwa waktu komputasi berbanding terbalik dengan jumlah level dekomposisi wavelet. Semakin tinggi level dekomposisi wavelet akan semakin kecil waktu komputasinya. Hal ini disebabkan makin tinggi level dekomposisi wavelet yang digunakan, maka akan semakin kecil dimensi citra hasil dekomposisi yang menjadi input jaringan syaraf tiruannya, sehingga mempercepat waktu komputasi.

KESIMPULAN DAN SARAN

Kesimpulan

Dari berbagai percobaan yang dilakukan pada penelitian diperoleh kesimpulan sebagai berikut:

1 Generalisasi meningkat seiring dengan pertambahan level dekomposisi wavelet. Generalisasi maksimum yang dicapai adalah sebesar 93.33% pada saat dekomposisi wavelet level 5 dan 6. Generalisasi minimum rata-rata terjadi pada jumlah hidden neuron 10.

2 Jaringan syaraf tiruan mencapai hasil maksimum pada kombinasi dekomposisi wavelet level 5 dan toleransi kesalahan 0.001 karena kombinasi dan percobaan setelahnya tidak meningkatkan generalisasi.

Saran

Penelitian ini masih dapat dikembangkan lagi pada penelitian berikutnya. Data yang digunakan pada penelitian ini adalah data sidik jari yang seragam posisi pengambilannya. Pada penelitian berikutnya, dapat digunakan data sidik jari yang diambil pada beragam posisi pengambilan. Selain itu dapat digunakan kombinasi citra pendekatan dua level dekomposisi wavelet sebagai citra latih jaringan syaraf tiruan.

Pada penelitian berikutnya juga dapat digunakan induk wavelet selain Haar misalnya Daubechies, dan dibandingkan hasil pengenalannya dengan hasil penelitian ini.

DAFTAR PUSTAKA

Burrus C.S, Gopinath R.A, Guo H. 1998.

Introduction to Wavelets and Wavelet Transforms A Primer. New Jersey :

Prentice Hall.

Cahyaningtias T. 2007. Pengenalan Wajah

dengan Praproses Transformasi Wavelet

[Skripsi]. Bogor: Departemen Ilmu Komputer, FMIPA, Institut Pertanian Bogor.

Fausett L. 1994. Fundamentals of Neural

Networks Architectures, Algorithms, and Aplications. New Jersey : Prentice Hall.

Fu L. 1994. Neural Networks in Computer

Intelligence. Singapore: McGraw-Hill.

Maltoni et al. 2003. Handbook of Fingerprint

Recognition. New York: Springer.

McAndrew A. 2004. An Introduction to

Digital Image Processing with MATLAB.

USA:Thomson Course Technology. Minarni. 2004. Klasifikasi Sidik Jari dengan

Pemrosesan Awal Wavelet. Transmisi

8(2): 37-41.

Nugroho D. 2007. Pengenalan Karakter

Tulisan Tangan Menggunakan Jaringan Syaraf Tiruan Resilient [Skripsi]. Bogor:

Departemen Ilmu Komputer, FMIPA, Institut Pertanian Bogor.

Puspitaningrum. 2006. Pengantar Jaringan

Lampiran 1 Algoritme Jaringan Syaraf Tiruan Resilient (RPROP)

Langkah 0. Inisialisasi bobot.

Langkah 1. Selama syarat berhenti salah, lakukan langkah 2-9.

Langkah 2. Untuk setiap pasangan pelatihan (data masukan dan target), lakukan langkah 3-8. Langkah 3. Setiap unit masukan (Xi,i=1,2,3,…,n) menerima sinyal masukan xi dan meneruskannya

ke seluruh unit pada lapisan di atasnya (hidden unit).

Langkah 4. Setiap hidden unit (Zj, j=1,2,3,…,p) menghitung total sinyal masukan terbobot,

∑ = + = n i xivij j v j in z 1 0 _ ,

lalu menghitung sinyal keluarannya dengan fungsi aktivasi,

) _ (z inj f j z =

Langkah 5. Setiap unit output (Yk, k = 1,2,3,…,m) menghitung total sinyal terbobot,

∑ = + = p j xjvjk k w k in y 1 0 _ .

lalu menghitung sinyal keluaran dengan fungsi aktivasi, ) _ (y ink f k y = .

Langkah 6. Setiap unit output (Yk, k=1,2,3,…,m) menerima sebuah pola target yang sesuai dengan

pola masukan pelatihannya. Unit tersebut menghitung informasi error,

) ( 2 2 2 ) ( 2 2 2 2 2 ) _ ( ' ) ( old k k k old jk jk jk k k j z k jk k in y f k y k t k β β ββ ϕ ϕ ϕϕ δ β ϕ ϕ δ ∗ = ∗ = = = − =

kemudian menghitung koreksi bobot (digunakan untuk mengubah wjk nanti),

⎪

⎩

⎪

⎨

⎧

= Δ < > = Δ 0 2 ); ( 0 2 ; 0 2 ; jk old jk w jk FT jk FN jk w ϕϕ ϕϕ ϕϕ max) , min( wjk delta jk w = Δ Δ⎪

⎪

⎩

⎪⎪

⎨

⎧

= < Δ > Δ − = Δ 0 2 ; 0 0 2 ; 0 2 ; jk jk jk w jk jk w jk w ϕ ϕ ϕhitung juga koreksi bias (yang nantinya akan digunakan untuk memperbaiki nilai b2k)

⎪⎩

⎪

⎨

⎧

= Δ < > = Δ 0 2 ); ( 2 0 2 ; 0 2 ; 2 k old k b k FT k FN k b ββ ββ ββ max) , min( b2k delta k 2 b = Δ ΔLanjutan

⎪

⎩

⎪

⎨

⎧

= < Δ > Δ = Δ 0 2 ; 0 0 2 ; 2 0 2 ; 2 2 k k k b k k b k b β β βLangkah 7. Setiap hidden unit (Zj, j=1,2,3,…p) menghitung selisih input (dari unit-unit pada layer

di atasnya) , 1 _ ∑ = = m k kwjk j in δ δ

lalu mengalikannya dengan turunan fungsi aktivasi untuk menghitung informasi error

) ( 1 1 1 ) ( 1 1 1 1 1 1 1 ) _ ( ' _ 1 old j k j old ij ij ij j j j x j ij j in z f j in j β β ββ ϕ ϕ ϕϕ δ β δ ϕ δ δ ∗ = ∗ = = = =

kemudian hitung koreksi bobot (yang nantinya akan digunakan untuk memperbaiki nilai vij)

⎪

⎩

⎪

⎨

⎧

= Δ < > = Δ 0 1 ); ( 0 1 ; 0 1 ; ij old ij v ij FT ij FN ij v ϕϕ ϕϕ ϕϕ max) , min( vij delta ij v = Δ Δ⎪

⎪

⎩

⎪⎪

⎨

⎧

= < Δ > Δ − = Δ 0 1 ; 0 0 1 ; 0 1 ; ij ij ij v ij ij v ij v ϕ ϕ ϕhitung juga koreksi bias (yang nantinya akan digunakan untuk memperbaiki nilai b1j).

⎪

⎩

⎪

⎨

⎧

= Δ < > = Δ 0 1 ); ( 1 0 1 ; 0 1 ; 1 j old j b j FN j FT j b ββ ββ ββ max) , 1 min( 1 b delta b j= Δ j Δ ⎪ ⎪ ⎩ ⎪⎪ ⎨ ⎧ = < Δ > Δ = Δ 0 1 ; 0 0 1 ; 1 0 1 ; 1 1 j j j b j j b j b β β βLangkah 8. Setiap unit output (Yk, k=1,2,3,…m) mengubah bias dan bobot-bobotnya (j=0,…,p)

k b old k b new k b jk w old jk w new jk w 2 ) ( 2 ) ( 2 ) ( ) ( Δ + = Δ + =

Lanjutan

Setiap hidden unit (Zj, j=1,2,3,….,p) mengubah bias dan bobot-bobotnya (i=1,..,n)

j b old j b new j b v old v new vij ij ij 1 ) ( 1 ) ( 1 ) ( ) ( Δ + = Δ + =

Langkah 9. Uji syarat henti:

Jika besar mean square error ∑

= − n k tk yk n 1 2 ) ( 1

lebih kecil dari toleransi yang telah ditentukan atau jumlah epoch pelatihan sudah mencapai epoch maksimum, maka selesai, jika tidak kembali ke langkah 1.

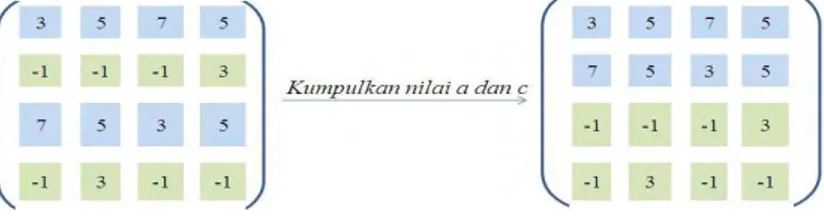

Lampiran 2 Ilustrasi transformasi wavelet pada citra

Misal diberikan sebuah citra dalam bentuk matriks A sebagai berikut:

⎟ ⎟ ⎟ ⎟ ⎠ ⎞ ⎜ ⎜ ⎜ ⎜ ⎝ ⎛ = 6 4 2 8 4 2 8 6 2 8 6 4 8 6 4 2 A .

Untuk melakukan transformasi wavelet level 1, pertama-tama dilakukan proses transformasi pada tiap kolom terlebih dahulu. Sebagai contoh diambil nilai piksel kolom pertama matriks A yaitu 2 4 6 8. a = (2+4)/2 = 3 [2 4] c = 2 − 3 = -1 a = (6+8)/2 = 7 [6 8] c = 6 − 7 = -1

Proses perhitungan dilanjutkan sampai kolom terakhir. Proses perhitungan selanjutnya dapat dilihat pada Gambar 33. Pada Gambar 33, kumpulan nilai a pada kolom diarsir dengan warna biru, sedangkan kumpulan nilai c diarsir dengan warna hijau.

Gambar 33 Transformasi wavelet pada kolom.

Selanjutnya dilakukan proses transformasi pada baris matriks hasil pengumpulan nilai a dan c di atas. Sebagai contoh diambil nilai pada baris pertama matriks yaitu 3 5 7 5.

a = (3+5)/2 = 4 [3 5] c = 3 − 4 = -1 a = (7+5)/2 = 6 [ 7 5] c = 7 - 6 = 1

Proses perhitungan dilanjutkan sampai baris terakhir. Proses selengkapnya dapat dilihat pada Gambar 34. Seperti sebelumnya, nilai a diberi warna biru dan c diberi warna hijau pada gambar. Nilai a dan c kemudian dikumpulkan sehingga didapatkan matriks akhir hasil transformasi wavelet level 1.

Gambar 34 Transformasi wavelet pada baris.

Matriks hasil pengumpulan nilai a dan c di atas adalah matriks akhir hasil transformasi wavelet level 1. Transformasi wavelet menghasilkan empat citra, yaitu citra pendekatan, citra detil horisontal, citra detil vertikal, dan citra detil diagonal. Hasil transformasi wavelet level 1 selengkapnya dapat dilihat pada Gambar 35. Transformasi wavelet level 2 dilakukan dari nilai matriks citra pendekatan level 1, demikian seterusnya jika ingin melakukan transformasi wavelet ke level selanjutnya.

Gambar 35 Hasil transformasi wavelet level 1.

Lampiran 3 Data Sidik Jari Data Latih : Orang 1 : Orang 2: Orang 3: Orang 4: Orang 5: Orang 6 :

Lanjutan Orang 7: Orang 8: Orang 9: Orang 10: Data Uji Orang 1: Orang 2:

Lanjutan Orang 3: Orang 4: Orang 5: Orang 6: Orang 7: Orang 8:

Lanjutan Orang 9:

Orang 10:

Lampiran 4 Tabel generalisasi toleransi kesalahan 0.01 Hidden Neuron Level Dekomposisi Wavelet

Ulangan Epoch Waktu Generalisasi

Rata-rata Generalisasi

Waktu Epoch Min Max

10 1 1 93 20.01 40 14.14 66 40 60 2 89 18.36 40 3 65 14.76 50 4 54 11.59 60 5 29 5.96 56.67 2 1 33 1.21 43.33 1.27 33 36.67 53.33 2 34 1.29 53.33 3 34 1.28 46.67 4 41 1.65 36.67 5 23 0.92 46.67 3 1 48 0.64 40 0.652 47 40 63.33 2 30 0.45 50 3 67 0.92 56.67 4 45 0.61 63.33 5 47 0.64 50 4 1 22 0.23 70 0.216 19 50 70 2 23 0.25 50 3 19 0.21 63.33 4 15 0.18 66.67 5 18 0.21 53.33 5 1 18 0.43 73.33 0.232 21 63.33 80 2 18 0.21 66.67 3 24 0.17 80 4 31 0.21 70 5 13 0.14 63.33 6 1 30 0.25 73.33 0.19 25 60 83.33 2 17 0.18 76.67 3 22 0.17 76.67 4 30 0.17 60 5 26 0.18 83.33 20 1 1 45 8.93 46.67 13.77 70 40 46.67 2 51 10.04 46.67 3 73 14.33 43.33 4 93 18.13 40 5 89 17.45 40 2 1 17 1.57 63.33 1.22 18 46.67 63.33 2 21 1.87 50 3 12 0.21 53.33 4 17 0.53 46.67 5 22 1.95 56.67 3 1 21 0.53 46.67 0.43 15 46.67 80 2 15 0.45 63.33 3 14 0.4 73.33 4 11 0.37 60 5 15 0.43 80 4 1 12 0.2 56.67 0.19 10 56.67 76.67 2 8 0.18 76.67 3 9 0.18 73.33 4 9 0.18 60 5 13 0.21 66.67 5 1 10 0.15 76.67 0.154 10 70 80 2 11 0.15 80 3 8 0.17 76.67 4 11 0.15 70 5 10 0.15 73.33 6 1 18 0.21 76.67 0.172 17 76.67 90 2 16 0.15 80 3 17 0.17 86.67 4 17 0.18 90 5 15 0.15 76.67

Lanjutan

Hidden Neuron

Level Dekomposisi

Wavelet Ulangan Epoch Waktu Generalisasi

Rata-rata Generalisasi

Waktu Epoch Min Max

30 1 1 16 10.45 43.33 10.12 14 43.33 63.33 2 11 7.03 63.33 3 13 10.17 63.33 4 19 13.48 53.33 5 13 9.51 46.67 2 1 14 2 63.33 1.30 12 53.33 70 2 11 1.53 70 3 9 1.29 70 4 11 1.5 56.67 5 16 0.21 53.33 3 1 11 0.42 56.67 0.47 11 50 66.67 2 10 0.42 63.33 3 12 0.46 66.67 4 10 0.53 66.67 5 11 0.53 50 4 1 82 0.21 60 0.20 23 60 83.33 2 7 0.2 80 3 8 0.18 66.67 4 7 0.21 83.33 5 9 0.21 70 5 1 7 0.23 70 0.19 7 70 80 2 8 0.17 76.67 3 7 0.18 80 4 6 0.15 76.67 5 8 0.23 70 6 1 11 0.23 80 0.41 13 80 83.33 2 12 0.15 83.33 3 13 0.81 83.33 4 12 0.15 80 5 15 0.71 80 40 1 1 13 15.79 66.67 10.34 11 53.33 80 2 7 5.95 80 3 12 10.32 60 4 12 10.39 53.33 5 11 9.29 66.67 2 1 9 1.65 50 1.70 9 50 80 2 11 1.98 76.67 3 11 2.01 53.33 4 7 1.37 66.67 5 8 1.53 80 3 1 8 0.42 63.33 0.46 9 63.33 76.67 2 13 0.62 70 3 10 0.48 63.33 4 8 0.39 70 5 7 0.39 76.67 4 1 8 0.23 76.67 0.75 7 70 90 2 8 0.2 90 3 6 0.2 70 4 8 0.23 70 5 7 2.9 76.67 5 1 7 0.28 76.67 0.20 7 76.67 80 2 7 0.15 80 3 7 0.18 76.67 4 7 0.15 76.67 5 7 0.26 80 6 1 13 0.21 90 0.32 12 80 90 2 11 0.89 83.33 3 11 0.17 86.67 4 14 0.17 83.33 5 11 0.17 80

Lanjutan

Hidden Neuron

Level Dekomposisi

Wavelet Ulangan Epoch Waktu Generalisasi

Rata-rata Generalisasi

Waktu Epoch Min Max

50 1 1 11 11.67 56.67 11.25 10 53.33 66.67 2 9 9.78 56.67 3 8 8.43 66.67 4 11 11.07 63.33 5 14 15.34 53.33 2 1 9 4.46 56.67 2.96 10 56.67 66.67 2 9 3.21 63.33 3 11 2.46 56.67 4 12 2.65 60 5 9 2.04 66.67 3 1 8 0.5 63.33 0.50 8 63.33 73.33 2 7 0.46 73.33 3 9 0.53 73.33 4 7 0.46 70 5 9 0.56 73.33 4 1 6 0.37 83.33 0.26 6 63.33 83.33 2 6 0.26 80 3 6 0.23 76.67 4 7 0.25 76.67 5 6 0.21 63.33 5 1 6 0.37 73.33 0.22 6 73.33 86.67 2 5 0.23 73.33 3 6 0.17 73.33 4 7 0.17 76.67 5 7 0.17 86.67 6 1 11 0.26 80 0.20 11 80 86.67 2 11 0.2 86.67 3 12 0.2 80 4 11 0.17 86.67 5 11 0.21 80 60 1 1 9 11.27 56.67 13.08 9 53.33 66.67 2 11 11.57 63.33 3 10 18.56 53.33 4 9 13.34 60 5 8 10.67 66.67 2 1 8 2.9 66.67 2.98 9 60 73.33 2 10 4.42 60 3 8 2.18 73.33 4 10 2.64 63.33 5 10 2.76 63.33 3 1 7 0.53 80 0.534 7 66.67 80 2 8 0.57 70 3 7 0.51 73.33 4 7 0.53 70 5 7 0.53 66.67 4 1 6 0.23 73.33 0.246 6 66.67 83.33 2 6 0.26 83.33 3 7 0.23 66.67 4 6 0.2 80 5 6 0.31 83.33 5 1 6 0.23 83.33 0.16 6 70 86.67 2 6 0.14 70 3 6 0.15 86.67 4 5 0.15 70 5 6 0.17 80 6 1 10 0.23 86.67 0.19 11 80 93.33 2 11 0.18 93.33 3 10 0.18 86.67 4 12 0.17 80 5 11 0.21 80

Lanjutan

Hidden Neuron

Level Dekomposisi

Wavelet Ulangan Epoch Waktu Generalisasi

Rata-rata Generalisasi

Waktu Epoch Min Max

70 1 1 8 14.69 66.67 16.24 9 46.67 66.67 2 9 14.23 60 3 9 22.09 53.33 4 9 16.52 46.67 5 9 13.71 53.33 2 1 11 3.29 73.33 2.678 8 60 76.67 2 8 2.62 70 3 7 2.5 76.67 4 7 2.34 60 5 9 2.64 66.67 3 1 7 0.68 80 0.65 6 56.67 80 2 5 0.67 66.67 3 7 0.64 56.67 4 6 0.59 66.67 5 7 0.68 63.33 4 1 7 0.25 76.67 0.24 6 66.67 86.67 2 6 0.25 86.67 3 6 0.23 73.33 4 6 0.25 66.67 5 6 0.25 83.33 5 1 6 0.25 83.33 0.19 6 60 83.33 2 6 0.17 73.33 3 8 0.18 80 4 6 0.2 60 5 5 0.17 83.33 6 1 10 0.31 90 0.22 10 80 93.33 2 10 0.2 80 3 9 0.18 93.33 4 10 0.18 93.33 5 10 0.26 93.33 80 1 1 8 13.28 56.67 19.04 8 53.33 63.33 2 7 11.26 60 3 8 45.43 63.33 4 8 13.21 60 5 7 11.89 53.33 2 1 7 2.53 63.33 3.22 8 60 76.67 2 10 4.5 76.67 3 9 3.28 60 4 8 2.93 60 5 8 2.9 73.33 3 1 7 0.75 73.33 0.75 7 63.33 73.33 2 7 0.68 66.67 3 6 0.64 63.33 4 6 0.64 73.33 5 7 1.06 70 4 1 7 0.28 80 0.23 6 66.67 86.67 2 6 0.23 73.33 3 6 0.25 86.67 4 6 0.21 83.33 5 5 0.21 66.67 5 1 6 0.18 76.67 0.19 6 66.67 86.67 2 6 0.18 66.67 3 6 0.17 76.67 4 5 0.15 80 5 6 0.29 86.67 6 1 9 0.21 93.33 0.18 10 83.33 93.33 2 10 0.17 90 3 10 0.17 90 4 11 0.2 83.33 5 10 0.17 93.33

Lanjutan

Hidden Neuron

Level Dekomposisi

Wavelet Ulangan Epoch Waktu Generalisasi

Rata-rata Generalisasi

Waktu Epoch Min Max

90 1 1 11 22.31 63.33 17.08 9 60 66.67 2 9 16.67 66.67 3 8 15.25 60 4 9 16.25 63.33 5 8 15.01 66.67 2 1 9 3.56 63.33 3.23 8 60 66.67 2 8 3.2 60 3 7 2.93 63.33 4 8 3.2 60 5 8 3.29 66.67 3 1 7 0.78 63.33 0.73 6 53.33 73.33 2 6 0.71 73.33 3 6 0.7 66.67 4 7 0.79 53.33 5 6 0.71 70 4 1 6 0.23 83.33 0.24 6 63.33 83.33 2 6 0.25 73.33 3 7 0.26 73.33 4 6 0.25 73.33 5 5 0.21 63.33 5 1 7 0.25 80 0.21 6 70 86.67 2 6 0.25 70 3 6 0.18 80 4 6 0.18 80 5 7 0.2 86.67 6 1 10 0.23 86.67 0.22 10 83.33 93.33 2 11 0.28 90 3 9 0.21 90 4 11 0.17 83.33 5 10 0.21 93.33 100 1 1 9 18.37 50 21.11 8 50 76.67 2 9 30.01 70 3 8 16.5 76.67 4 7 14.57 53.33 5 8 26.14 66.67 2 1 7 3.15 66.67 3.47 8 66.67 70 2 10 4.43 66.7 3 6 2.75 66.67 4 8 3.54 70 5 8 3.5 70 3 1 6 0.28 70 0.76 6 63.33 76.67 2 7 0.89 63.33 3 5 0.68 76.67 4 8 0.98 63.33 5 6 0.98 70 4 1 7 0.29 63.33 0.26 6 63.33 83.33 2 7 0.28 83.33 3 5 0.21 73.33 4 6 0.28 76.67 5 6 0.26 63.33 5 1 7 0.25 83.33 0.22 7 73.33 83.33 2 6 0.18 76.67 3 7 0.2 73.33 4 6 0.28 80 5 7 0.23 80 6 1 9 0.25 83.33 0.19 10 83.33 93.33 2 10 0.17 93.33 3 9 0.17 86.67 4 10 0.2 90 5 10 0.18 86.67

Lampiran 5 Tabel generalisasi toleransi kesalahan 0.001

Hidden Neuron

Level Dekomposisi

Wavelet Ulangan Epoch Waktu Generalisasi

Rata-rata Generalisasi

Waktu Epoch Min Max

10 1 1 216 28.25 53.33 134.07 509 40 56.67 2 1000 250 40 3 1000 291 56.67 4 197 46.02 53.33 5 130 55.09 53.33 2 1 284 12.2 60 20.32 490 43.33 60 2 961 41.9 53.33 3 601 21.51 50 4 186 7.81 53.33 5 418 18.18 43.33 3 1 44 0.68 56.67 2.42 212 40 56.67 2 163 2.04 56.67 3 193 2.04 46.67 4 387 3.87 43.33 5 273 3.46 40 4 1 48 0.39 56.67 0.43 56 50 70 2 70 0.46 50 3 61 0.43 63.33 4 64 0.56 63.33 5 36 0.32 70 5 1 23 0.2 76.67 0.29 48 50 76.67 2 53 0.32 63.33 3 62 0.37 66.67 4 52 0.29 73.33 5 51 0.28 50 6 1 87 0.62 66.67 0.32 57 66.67 83.33 2 41 0.2 83.33 3 64 0.42 66.67 4 57 0.2 70 5 36 0.17 80 20 1 1 47 20.46 46.67 38.81 72 46.67 60 2 96 64.82 50 3 137 73.09 60 4 36 15.12 60 5 46 20.57 56.67 2 1 53 4.65 50 4.29 49 40 66.67 2 55 4.82 40 3 44 3.98 50 4 52 4.53 50 5 40 3.45 66.67 3 1 21 0.48 63.33 0.69 31 56.67 70 2 33 0.7 56.67 3 39 0.89 70 4 33 0.75 66.67 5 28 0.64 63.33 4 1 13 0.25 66.67 0.32 18 53.33 76.67 2 15 0.43 76.67 3 24 0.31 63.33 4 22 0.32 53.33 5 17 0.28 63.33 5 1 13 0.15 90 0.17 15 66.67 90 2 16 0.18 73.33 3 18 0.15 80 4 15 0.18 66.67 5 14 0.17 80 6 1 26 0.2 86.67 0.17 25 76.67 90 2 26 0.15 76.67 3 27 0.15 90 4 21 0.25 90 5 27 0.12 86.67